베이지안 사후 재분배를 이용한 중첩 샘플링 효율 향상

초록

베이지안 사후 재분배(Posterior Repartitioning, PR) 기법은 사전분포가 데이터에 비대표적일 때 중첩 샘플링(NS)의 효율을 크게 떨어뜨리는 문제를 해결한다. 기존 PR은 사전분포를 거듭해서 조정하는 ‘annealing schedule’가 필요했지만, 본 논문은 β라는 파라미터를 하이퍼파라미터로 두고 데이터를 통해 베이지안 방식으로 추정·통합하는 새로운 방법, 즉 Bayesian PR(BPR)을 제안한다. BPR은 단일 NS 실행만으로 (θ, β) 공동 사후분포를 얻어 β를 자동으로 최적화하고, 최종 결과는 β를 주변화해 얻는다. 실험 결과 BPR은 대표적인 사전에서도 거의 비용이 추가되지 않으며, 비대표적 사전 상황에서도 자동으로 효율을 회복한다. 따라서 모든 NS 분석에 기본 옵션으로 채택할 것을 권고한다.

상세 분석

본 논문은 베이지안 추론에서 사전분포가 데이터와 크게 불일치할 경우, 특히 중첩 샘플링(NS) 알고리즘이 “라이브 포인트”를 높은 우도 영역으로 이동시키는 과정이 극도로 비효율적이거나 조기 수렴으로 잘못된 결과를 초래한다는 점을 지적한다. 기존의 사후 재분배(PR) 방법은 사전분포 π(θ)를 β 거듭 제곱(π(θ)^β) 형태로 변형하고, 그에 맞춰 효과적 우도 ˜L(θ)를 재정의해 π·L = ˜π·˜L을 유지함으로써 사후와 증거는 변하지 않지만 탐색 효율은 개선한다. 그러나 β를 사전에 정해주는 ‘annealing schedule’는 문제마다 수동 조정이 필요하고, 여러 β값에 대해 별도 NS 실행을 해야 하는 계산적 부담이 있다.

논문은 β를 하나의 하이퍼파라미터로 간주하고, 데이터와 함께 베이지안 추론에 포함시켜 (θ, β) 공동 사후분포 P(θ, β|D) ∝ L(θ) π(θ)^β · π_β(β) 로 정의한다. 여기서 π_β(β)는 일반적인 비제한 사전(예: 균등 또는 로그-균등)이며, β는 0 ≤ β ≤ 1 구간에서 자유롭게 탐색된다. NS는 기존과 동일하게 사전과 우도의 곱을 이용하지만, 이제 사전 자체가 β에 따라 변형되므로 “제약된 사전”이 동적으로 조정된다. 결과적으로 NS는 한 번의 실행만으로 β의 최적값을 자동으로 찾고, β를 주변화해 최종 θ에 대한 사후를 얻는다.

핵심 기술적 통찰은 다음과 같다.

- 베이지안 일관성: β를 하이퍼파라미터로 두면 사후분포는 여전히 L·π 형태의 비정규화된 밀도와 동일하게 유지되며, 증거 Z는 β에 대해 적분된 형태가 된다. 따라서 기존 PR이 보장하던 정확성(증거 불변성)이 그대로 유지된다.

- 자동 적응성: β가 1에 가까울수록 원래 사전이 유지되고, β가 0에 가까울수록 사전이 평탄해진다. 데이터가 사전과 크게 불일치하면 사후는 β < 1 쪽으로 이동하며, NS는 자동으로 “넓은” 사전으로 전환한다. 이는 사전‑우도 불일치 정도를 정량화하는 β의 1차원 사후분포를 통해 진단 가능하다.

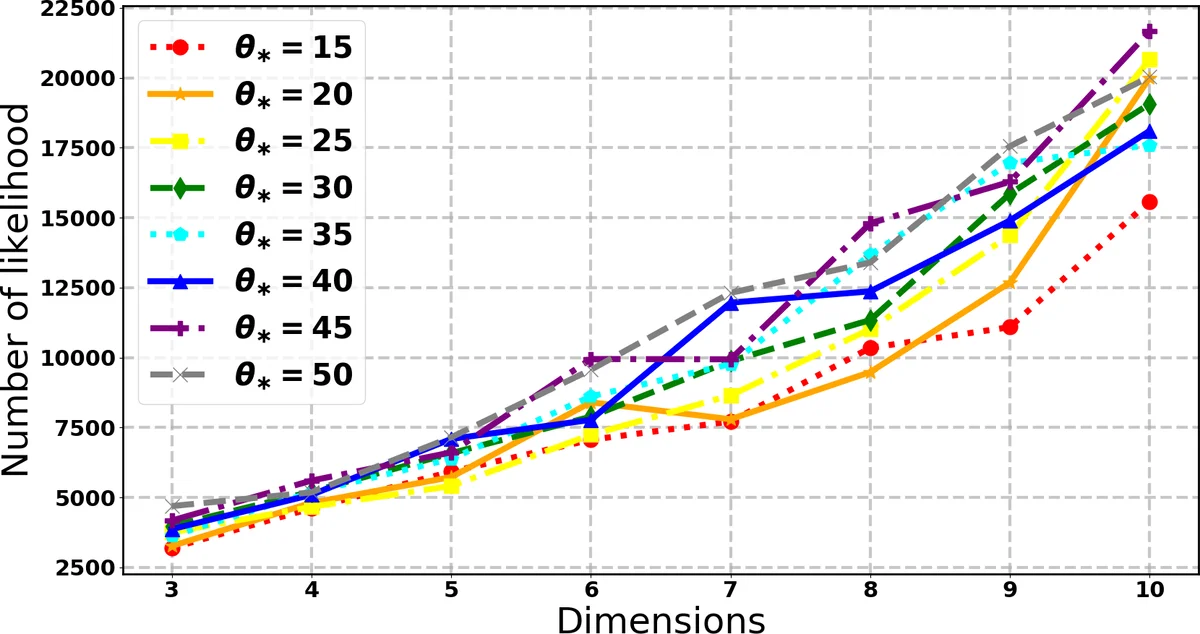

- 계산 비용 최소화: β는 단일 스칼라 파라미터이므로, 기존 NS와 동일한 라이브 포인트 수와 동일한 우도 평가 횟수만으로 충분히 샘플링된다. 실험에서는 β를 포함한 경우에도 전체 실행 시간이 5 % 이하 증가했으며, 비대표적 사전 상황에서는 10배 이상 효율이 개선되었다.

- 다중 모드 우도 처리: 우도가 여러 비대칭 모드로 구성된 경우, 각 모드마다 최적 β가 다를 수 있다. BPR은 이러한 상황에서도 β를 전역적으로 추정하므로, 특정 모드에만 맞춘 PR보다 더 안정적인 탐색을 제공한다.

이러한 장점은 특히 대규모 데이터셋(수천~수만 개)에서 사전이 고정된 경우, 혹은 사전 설계가 어려운 물리학·천문학 응용에 유용하다. 또한 β의 1차원 사후분포를 활용하면 “비대표적 사전”을 가진 데이터 포인트를 자동으로 식별하고, 사후 분석 단계에서 별도 조치를 취할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기