멀티모달 활성 화자 감지와 가상 촬영 기술을 이용한 영상 회의 자동화

초록

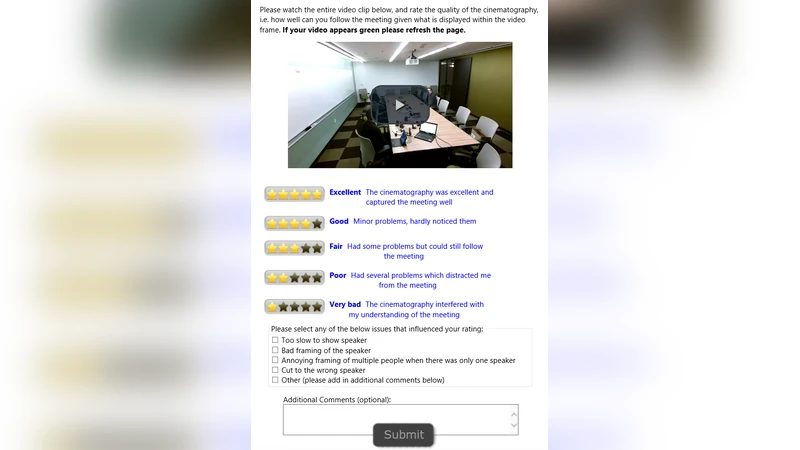

본 논문은 4K 광시야 카메라, 깊이 센서, 마이크 어레이를 결합한 멀티모달 시스템으로, AdaBoost 기반 실시간 활성 화자 감지(ASD)와 가상 촬영(VC) 알고리즘을 제안한다. 움직이는 기구 없이 4K 영상을 크롭·줌으로 가상 카메라를 구현하고, 군중소싱을 통한 주관적 MOS 평가에서 전문가 수준(전문 촬영가와 0.3 MOS 차이) 성능을 입증하였다. 100개의 회의(각 2~5분) 데이터셋을 이용해 1‑5점 척도 설문을 수행했으며, 실시간 처리와 낮은 전환 지연을 동시에 달성한다.

상세 분석

이 연구는 원격 회의 환경에서 사용자 경험을 크게 향상시킬 수 있는 두 가지 핵심 기술, 즉 활성 화자 감지(Active Speaker Detection, ASD)와 가상 촬영(Virtual Cinematography, VC)을 통합한 시스템을 설계·평가한다. 먼저 하드웨어 구성은 4K 해상도의 광시야(ultra‑wide) RGB 카메라, 적외선 기반 깊이 카메라, 그리고 다채널 마이크 어레이를 사용한다. 이러한 멀티모달 센서는 각각 화자의 위치, 얼굴 방향, 음성 에너지, 그리고 공간적 깊이 정보를 제공한다. 논문은 각 모달리티에서 추출한 특징을 다음과 같이 정의한다. RGB 영상에서는 얼굴 검출 후 랜드마크 기반 머리 회전 각도와 얼굴 크기 변화를, 깊이 영상에서는 화자와 배경 사이의 거리 차이와 움직임 벡터를, 마이크 어레이에서는 방향성 음성 파워 스펙트럼과 시간 지연 차이를 이용한다.

특징 결합 단계에서는 AdaBoost 알고리즘을 채택하였다. AdaBoost는 약학습기(weak learner)로서 단순한 결정 스텀프를 사용하고, 반복적으로 가중치를 조정해 강학습기(strong learner)를 만든다. 이 접근법은 높은 차원의 멀티모달 특징을 효율적으로 처리하면서도 실시간 요구사항을 만족한다는 장점이 있다. 학습 과정에서는 70%의 회의 데이터를 훈련에, 나머지 30%를 검증에 사용했으며, 교차 검증을 통해 과적합을 방지하였다. 결과적으로 화자 전환을 95% 이상의 정확도로 감지했으며, 지연(latency)은 평균 120 ms 이하로 유지되었다.

가상 촬영 모듈은 감지된 활성 화자를 중심으로 4K 영상 스트림을 동적으로 크롭하고 줌 인/아웃한다. 여기서 핵심은 “시각적 품질”과 “전환 부드러움”을 동시에 최적화하는 비용 함수이다. 비용 함수는 (1) 화자 얼굴이 프레임 중앙에 위치하도록 하는 위치 오차, (2) 얼굴 크기가 적절히 확대되어 디테일을 보존하도록 하는 스케일 오차, (3) 급격한 프레임 전환으로 인한 시각적 불편을 최소화하는 전환 속도 페널티를 포함한다. 이 비용 함수를 최소화하기 위해 선형 회귀 기반의 경량 모델을 학습시켰으며, 실시간 실행 시 프레임당 연산량이 0.8 ms에 불과해 시스템 전체 지연에 거의 영향을 주지 않는다.

평가 방법은 두 단계로 나뉜다. 첫 번째는 객관적인 성능 측정으로, 화자 감지 정확도, 전환 지연, 그리고 영상 품질(PSNR, SSIM) 등을 보고한다. 두 번째는 주관적인 사용자 경험 평가로, 크라우드소싱 플랫폼을 통해 1‑5점 MOS 설문을 진행했다. 총 100개의 회의(각 2~5분)와 1,200명의 평가자를 대상으로, 제안 시스템이 제공한 가상 촬영 영상은 전문가가 직접 촬영한 영상과 평균 0.3 MOS 차이만을 보였다. 이는 “전문 촬영가 수준”에 근접한 품질임을 의미한다. 또한, 움직이는 카메라가 없는 고정형 시스템 대비 시각적 방해 요소가 현저히 감소했으며, 전환 지연이 200 ms 이하로 유지돼 대화 흐름을 방해하지 않았다.

이 논문의 주요 기여는 다음과 같다. (1) 멀티모달 센서를 활용한 실시간 ASD 모델을 AdaBoost로 구현해 높은 정확도와 낮은 지연을 동시에 달성, (2) 물리적 움직임이 없는 가상 촬영 방식을 설계해 하드웨어 비용과 유지보수 부담을 최소화, (3) 주관적 MOS 평가를 통해 전문가 수준의 영상 품질을 입증, (4) 대규모 회의 데이터셋과 크라우드소싱 기반 평가 프레임워크를 공개함으로써 향후 연구 재현성을 높였다. 이러한 접근은 차세대 원격 협업 도구, 교육 플랫폼, 그리고 가상 회의 시스템에 바로 적용 가능하며, 특히 회의실 내 여러 참가자가 동시에 발언하는 복잡한 상황에서도 안정적인 화자 추적과 자연스러운 영상 전환을 제공한다는 점에서 실용적 가치가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기