신경함수의 부드러움을 위한 리프시츠 정규화

초록

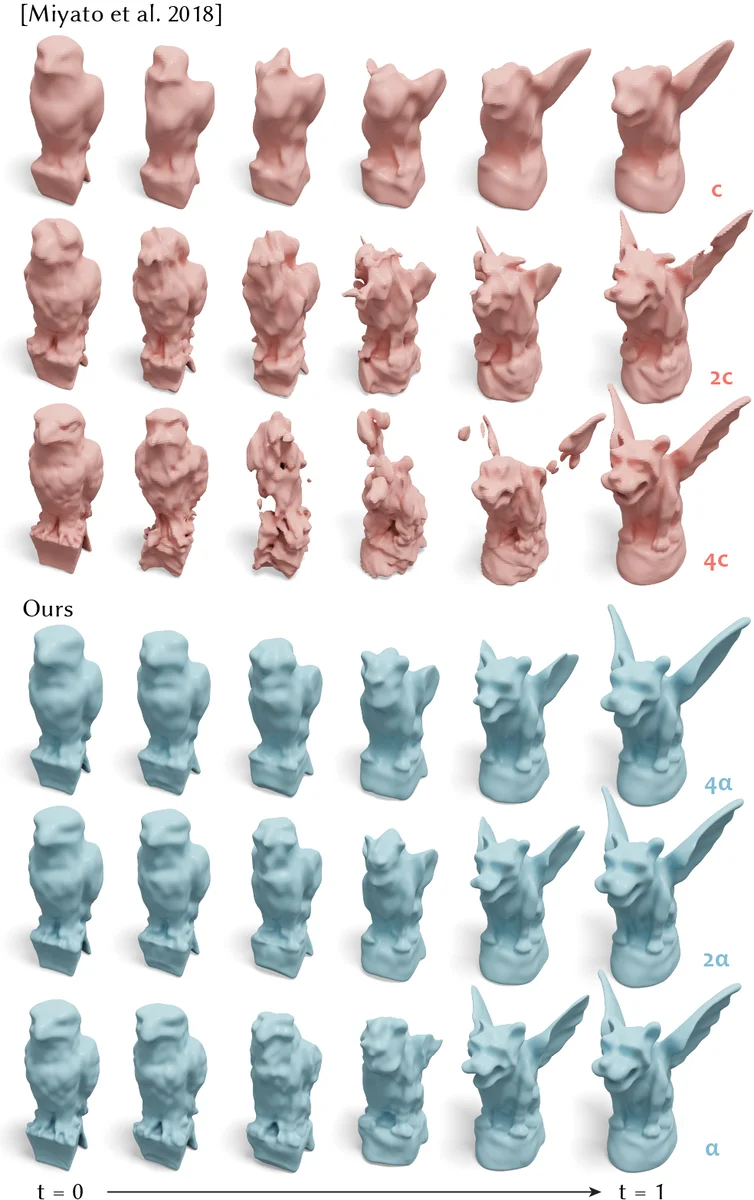

본 논문은 3D 형태를 표현하는 신경 임시장(Neural Implicit Field)에서 잠재 코드에 대한 매끄러운 변화를 보장하기 위해, 네트워크의 리프시츠 상수를 직접 학습 가능한 변수로 두고 이를 최소화하는 정규화 기법을 제안한다. 가중치 정규화와 간단한 손실 항만 추가하면 되며, 기존 방법보다 하이퍼파라미터 튜닝이 적고 연산 비용도 낮다. 실험은 형태 보간·외삽, 부분 점군 복원, 적대적 입력에 대한 강인성을 보여주며, 정량·정성 모두에서 기존 최첨단 및 비정규화 베이스라인을 능가한다.

상세 분석

이 연구는 신경 임시장이 잠재 변수 t 와 3차원 좌표 x 를 입력받아 스칼라 값을 출력하는 구조임을 전제로, 형태 편집 시 t 의 작은 변동이 출력에 부드럽게 반영되는 것이 필수적이라고 강조한다. 기존의 디리클레 에너지 기반 정규화는 샘플링된 t 값에만 매끄러움을 강제해 전체 잠재 공간에서 비균일한 변화를 초래한다는 한계를 지적한다. 논문은 이러한 문제를 해결하기 위해 네트워크 자체의 리프시츠 상수 c = ∏₁ᴸ‖W_i‖_∞ 를 직접 최소화하는 방식을 제안한다. 핵심은 각 층에 “Lipschitz Weight Normalization” 레이어를 삽입하고, c_i 를 소프트플러스 함수를 통해 양수화한 뒤 학습 가능한 파라미터로 두는 것이다. 손실 함수 J(θ)=L(θ)+α·∑c_i 에서 α 는 정규화 강도를 조절한다. 이 접근법은 (1) Lipschitz 상수를 입력에 독립적으로 정의하므로 훈련 샘플 외부에서도 매끄러움을 보장하고, (2) ∞‑norm 정규화가 행렬 최대 절댓값 합을 이용해 계산 비용이 매우 낮으며, (3) softplus 를 사용해 c_i 가 음수가 되는 것을 방지한다는 장점을 가진다. 실험에서는 2‑D SDF 보간, 3‑D torus 와 double‑torus 전환, 점군 기반 형태 복원 등 다양한 시나리오에서 기존 Spectral Normalization, Orthogonalization, 그리고 단순 L2 정규화 대비 더 일관된 결과를 얻었다. 특히, 잠재 공간이 2차원 이하일 때도 적은 학습 데이터(두 개의 형태)만으로도 부드러운 변형을 구현했으며, 적대적 입력에 대한 강인성 테스트에서도 손실이 크게 증가하지 않아 일반화 능력이 향상된 것을 확인했다. 전체적으로, 리프시츠 정규화를 파라미터화하고 손실에 직접 포함시키는 설계는 기존 방법이 요구하던 사전 c 값 설정이나 복잡한 층별 조정 없이도 깊이와 구조에 관계없이 일관된 매끄러움을 제공한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기