KG 임베딩과 리터럴을 활용한 저자 이름 자동 구분 프레임워크 LAND

초록

본 논문은 학술 지식 그래프(KG)에서 저자 이름 구분(AND) 문제를 해결하기 위해, 구조적 관계와 텍스트·숫자 리터럴을 동시에 학습하는 멀티모달 KG 임베딩 모델(LiteralE)을 적용하고, 차단(blocking)과 계층적 군집화(HAC)를 결합한 LAND 프레임워크를 제안한다. 두 개의 신규 KG(OC‑782K, AMiner‑534K)에서 실험한 결과, 기존 베이스라인 대비 F1 점수가 8~14% 향상되었음을 보고한다.

상세 분석

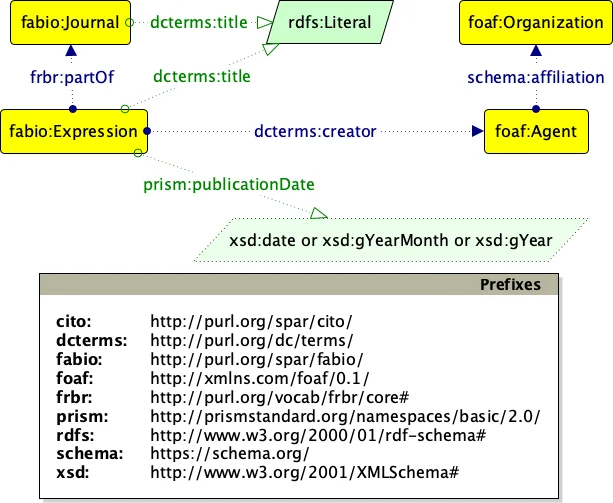

LAND는 세 단계로 구성된다. 첫 번째 단계에서는 기존 KG 임베딩 기법에 리터럴 정보를 통합하는 LiteralE 모델을 사용한다. LiteralE는 엔터티와 관계뿐 아니라, 저자명, 논문제목, 연도, 소속기관 등 텍스트·숫자형 리터럴을 벡터화하여, 구조적 인접성뿐 아니라 의미적 유사성을 동시에 포착한다. 두 번째 단계인 차단(blocking)에서는 동일 성(姓)·이니셜을 기준으로 초기 후보군을 형성함으로써 전체 쌍 비교 비용을 크게 감소시킨다. 마지막 단계에서는 차단된 후보군 내에서 학습된 임베딩을 거리 기반으로 측정하고, 계층적 병합 군집화(HAC)를 적용해 최종 저자 클러스터를 생성한다. 이 과정은 라벨이 없는 비지도 학습 형태이므로, 대규모 라벨링 비용이 소요되는 기존 지도 학습 방식보다 확장성이 높다. 실험에서는 OpenCitations 기반의 OC‑782K와 AMiner 기반의 AMiner‑534K 두 KG에 대해, 기존 메타데이터 중심 방법(공동저자, 키워드, TF‑IDF 등)과 비교했을 때 F1 점수가 각각 평균 10% 이상 상승하였다. 특히, 리터럴을 활용한 멀티모달 임베딩이 메타데이터가 희소한 경우에도 충분한 구분력을 제공한다는 점이 주목할 만하다. 한편, LAND는 리터럴 품질에 민감하게 반응한다는 한계가 있다. 저자명 표기 오류, 누락된 초록 등 노이즈가 많은 KG에서는 임베딩 품질이 저하될 수 있다. 또한, 차단 단계에서 LN‑FI(성·이니셜)만을 사용하기 때문에, 동일 이니셜·성 조합이 매우 빈번한 분야에서는 여전히 높은 후보군 크기가 발생한다. 향후 연구에서는 보다 정교한 차단 전략과, 그래프 신경망 기반의 동적 임베딩을 결합해 이러한 문제를 완화할 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기