전역 초선형 수렴을 달성한 분산 적응 뉴턴 방법

초록

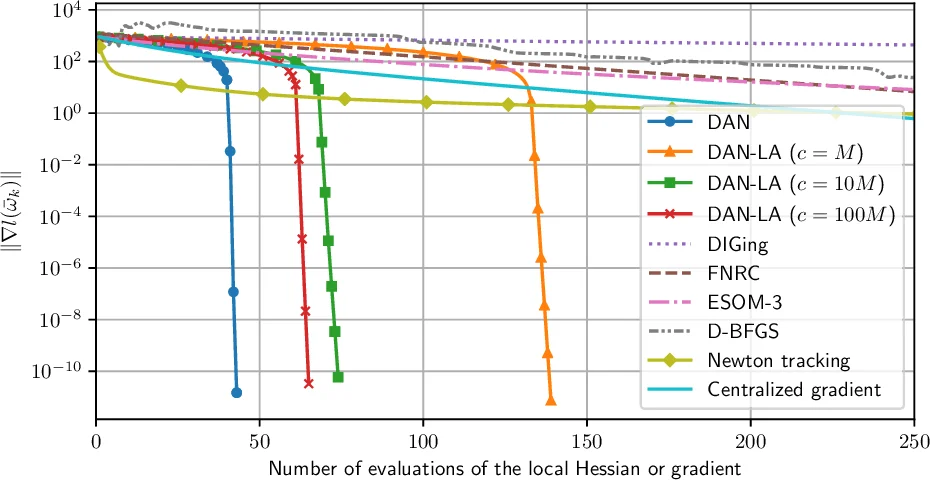

본 논문은 피어‑투‑피어 네트워크에서 각 노드가 로컬 목적함수의 합을 최소화하도록 설계된 분산 적응 뉴턴(DAN) 알고리즘을 제안한다. 제한된 통신 라운드 내에 정확한 집합 합의를 달성하는 유한시간 셋‑컨센서스(DSF)와 Polyak의 적응 스텝사이즈를 결합해 전역 2차 수렴을 보장한다. 또한 Hessian 혁신을 저차원으로 압축하는 저‑랭크 근사(LA)를 적용한 DAN‑LA는 통신량을 O(p)로 유지하면서 전역 초선형 수렴을 달성한다. 이론적 수렴 분석과 로지스틱 회귀 실험을 통해 기존 1차 및 2차 분산 방법보다 우수함을 입증한다.

상세 분석

본 연구는 분산 최적화에서 2차 정보를 활용하면서도 통신 비용을 1차 방법 수준으로 낮추는 두 가지 핵심 기술을 제시한다. 첫 번째는 ‘분산 유한시간 셋‑컨센서스(DSF)’이다. 기존의 평균‑컨센서스는 무한히 반복되는 라운드에 의존해 선형 수렴률만 제공하지만, DSF는 각 노드가 자신이 보유한 메시지를 한 번만 전송하도록 설계돼 트리 구조에서는 n‑1 라운드, 일반적인 강하게 연결된 그래프에서는 n+d_G‑1 라운드 내에 모든 노드가 전체 메시지 집합을 획득한다. 이는 메시지 중복 전송을 방지하고, 각 라운드마다 고유 식별자를 이용해 전송 여부를 판단함으로써 구현된다. 두 번째는 Polyak‑Tremba(2019)의 적응 스텝사이즈를 분산 환경에 적용한 ‘Distributed Adaptive Newton(DAN)’이다. 각 노드가 로컬 그라디언트와 Hessian을 계산하고 DSF를 통해 정확한 뉴턴 방향을 공유한 뒤, 전역 목표 함수값 감소를 보장하는 적응 스텝사이즈 α_k = (∥∇f(x_k)∥²)/(∥∇f(x_k)∥² + ∥H_k d_k∥²) 를 사용한다. 이 스텝사이즈는 라인서치를 필요로 하지 않으며, 초기점과 무관하게 Q‑quadratic 수렴을 증명한다. 그러나 Hessian 자체를 전송하면 O(p²) 비트가 소모되므로, 저‑랭크 근사(LA)를 도입한다. Hessian 혁신 ΔH_k = H_k – Ĥ_k 를 스펙트럴 노름 기준으로 1‑랭크 근사 s·wwᵀ 형태로 압축하고, 각 노드가 w∈ℝ^p와 부호 s만 전송하도록 설계해 통신량을 O(p)로 제한한다. 압축 오차는 적응 스텝사이즈와 연계해 상한을 설정함으로써 전역 초선형 수렴(Q‑superlinear)을 유지한다. 이론적 분석에서는 μ‑강한 볼록성, L‑리프시츠 Hessian, 그리고 강하게 연결된 그래프 가정을 바탕으로, DSF가 정확한 합의를 제공함을 보이고, 적응 스텝사이즈와 저‑랭크 근사의 결합이 수렴 속도를 제한 없이 가속한다는 정리를 제시한다. 실험에서는 Covtype 데이터셋에 대한 로지스틱 회귀 문제를 풀어, 기존 분산 1차 방법(Nedic, Scaman 등)과 기존 2차 방법(Mokhtari 등) 대비 수렴 속도와 통신 효율에서 현저히 우수함을 확인한다. 전체적으로, 이 논문은 분산 2차 최적화에서 전역 초선형 수렴을 달성하기 위한 알고리즘 설계, 통신 압축, 그리고 수렴 이론을 일관되게 연결한 최초의 연구라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기