완전 무감독 교차언어 임베딩 매핑을 위한 견고한 자기학습 방법

초록

본 논문은 기존의 적대적 학습 기반 무감독 교차언어 임베딩 매핑이 비슷한 언어·코퍼스에만 잘 작동한다는 한계를 지적하고, 단어 간 유사도 분포의 구조적 유사성을 활용한 초기화와 여러 안정화 기법을 결합한 자기학습 프레임워크를 제안한다. 제안 방법은 모든 실험 설정에서 성공적으로 수렴하며, 기존 최고 성능을 넘어서는 결과를 달성한다.

상세 분석

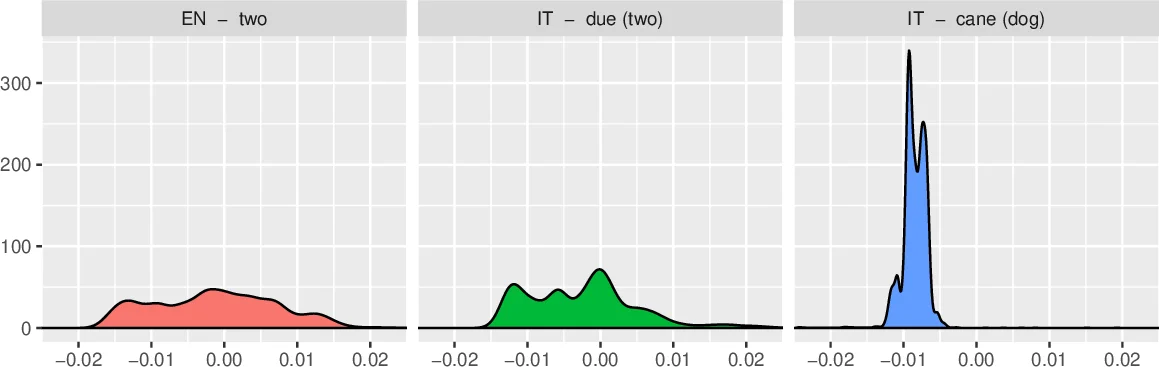

이 연구는 두 단계로 구성된 새로운 무감독 매핑 파이프라인을 제시한다. 첫 번째 단계는 “구조적 유사성 기반 초기화”로, 각 언어의 임베딩 행렬 X와 Z에 대해 유사도 행렬 M_X = X Xᵀ, M_Z = Z Zᵀ를 계산하고, 이들의 제곱근을 취한 뒤 행별로 값을 정렬한다. 정렬된 행은 동일 의미를 가진 단어들이 서로 비슷한 확률 분포를 갖는다는 가정 하에, 최근접 이웃 탐색을 통해 초기 사전 D₀를 만든다. 이 초기 사전은 정확도가 0.5% 수준으로 낮지만, 완전 무감독 상황에서 완전한 무작위보다 훨씬 유의미한 신호를 제공한다.

두 번째 단계는 “견고한 자기학습”이다. 기존 자기학습은 초기 사전이 충분히 좋은 경우에만 수렴하지만, 여기서는 몇 가지 핵심 개선을 도입한다. 첫째, 사전 유도 과정에 확률적 제로화(p) 를 적용해 유사도 행렬의 일부 값을 무작위로 0으로 만들고, p 값을 점진적으로 증가시키는 시뮬레이티드 어닐링 방식을 사용한다. 이는 초기 단계에서 탐색 폭을 넓혀 지역 최적에 빠지는 위험을 감소시킨다. 둘째, 빈도 기반 어휘 제한을 도입해 가장 빈번한 20 000개 단어만을 대상으로 사전 유도를 수행함으로써 계산 복잡도를 낮추고 잡음을 억제한다. 셋째, CSLS(Cross-domain Similarity Local Scaling) 를 적용해 허브 현상을 완화하고, 보다 정확한 최근접 이웃을 찾는다. 넷째, 양방향 사전 유도를 병합해 D = D_{X→Z} ∪ D_{Z→X} 형태로 구성함으로써 단일 방향에서 발생할 수 있는 편향을 최소화한다.

자기학습의 핵심 최적화는 정규 직교 변환 W_X, W_Z 를 구하는 것으로, 이는 Xᵀ D Z 의 SVD(U S Vᵀ) 를 통해 W_X = U, W_Z = V 로 얻어진다. 이후 매핑된 임베딩에 대해 위의 사전 유도 절차를 반복하면서 목표 함수(유사도 합계)의 개선이 멈출 때까지 진행한다. 마지막 단계에서는 대칭적 재가중치(symmetric re‑weighting)를 적용한다. 여기서는 U S^{1/2} 와 V S^{1/2} 를 각각 W_X, W_Z 로 사용해 양쪽 언어에 동일하게 차원을 스케일링함으로써 최종 매핑 품질을 한층 끌어올린다.

실험에서는 영어‑이탈리아어, 영어‑핀란드어, 영어‑러시아어 등 친밀도와 코퍼스 유사성이 낮은 언어쌍을 포함한 5가지 데이터셋을 사용했다. 기존 적대적 방법(Conneau et al., 2018 등)은 특히 영어‑핀란드어에서 2% 이하의 정확도를 보였지만, 제안 방법은 60% 이상, 심지어 일부 경우에는 70%에 달하는 정확도를 기록했다. 또한, 기존 감독 기반 매핑(수천 개 단어 사전 사용)과 비교했을 때도 동등하거나 더 나은 성능을 보였으며, 전체 파이프라인이 공개된 오픈소스 구현(vecmap)으로 제공되어 재현성이 확보되었다.

이러한 결과는 (1) 단어 간 유사도 분포가 언어 간 구조적 신호를 제공한다는 가설의 실증, (2) 확률적 사전 유도와 양방향 매칭이 지역 최적 탈출에 효과적이라는 점, (3) 대칭적 재가중치가 최종 매핑을 정교화한다는 점을 입증한다. 따라서 교차언어 임베딩 매핑에서 완전 무감독 접근법이 실제 적용 가능한 수준으로 끌어올려졌으며, 향후 다국어 NLP, 무감독 기계 번역, 언어 간 전이 학습 등에 광범위하게 활용될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기