다중 왜곡 GAN을 이용한 다스타일 캐리커처 생성

초록

**

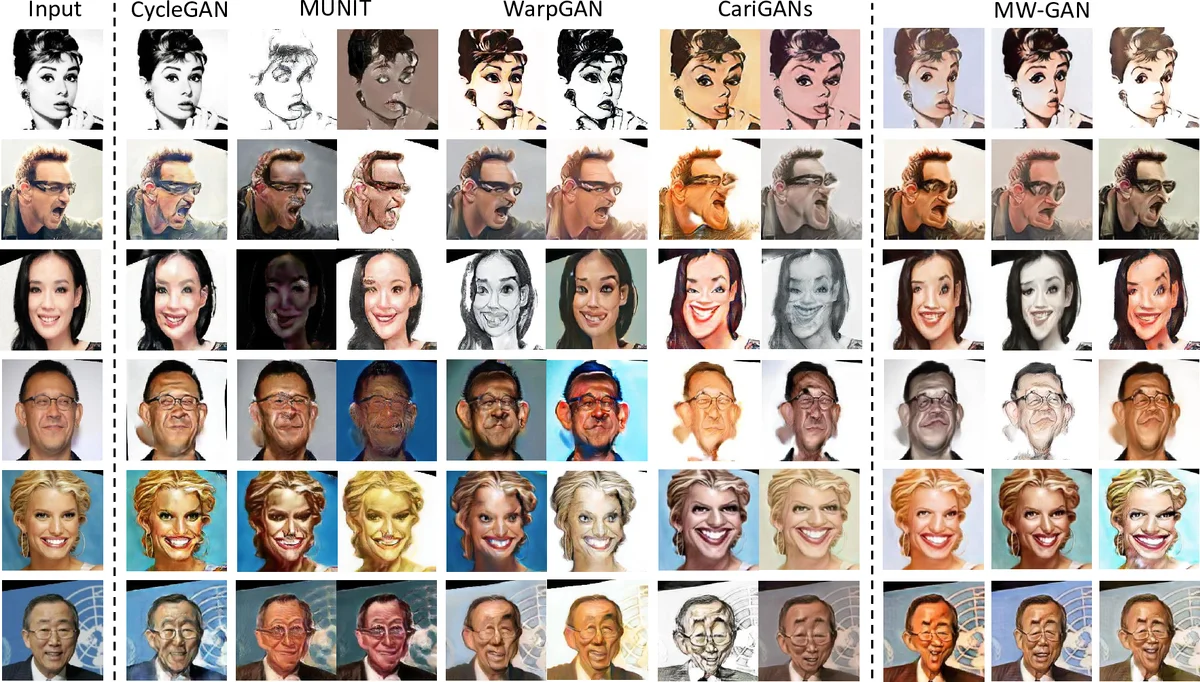

본 논문은 사진을 입력으로 받아 다양한 텍스처와 기하학적 과장 스타일을 동시에 적용한 캐리커처를 자동으로 생성하는 MW‑GAN 프레임워크를 제안한다. 스타일 네트워크와 기하학 네트워크를 각각 구축하고, 두 네트워크를 ‘양방향(dual way)’ 구조로 연결해 잠재 코드와 이미지·랜드마크 공간을 상호 정합시킨다. 이미지와 랜드마크 양쪽에 신원 보존 손실을 도입해 정체성을 유지하면서도 풍부한 다양성을 구현한다. 실험 결과, 기존 방법보다 높은 품질과 스타일·과장 다양성을 보여준다.

**

상세 분석

**

MW‑GAN은 캐리커처 생성이라는 복합 문제를 ‘텍스처 스타일 전이’와 ‘기하학적 과장’이라는 두 하위 과제로 분해하고, 각각을 전용 서브네트워크로 처리한다. 스타일 네트워크는 MUNIT과 유사하게 콘텐츠와 스타일을 분리하는 두 개의 오토인코더(콘텐츠 인코더 E_c, 스타일 인코더 E_s)와 스타일 디코더 G_s로 구성된다. 여기서 콘텐츠는 사진과 캐리커처가 공유하는 얼굴 형태 정보를 의미하고, 스타일은 색채·질감 등 시각적 특성을 담당한다. 스타일 잠재 코드 z_s는 정규 가우시안 분포를 가정해 무작위 샘플링하거나 기존 캐리커처에서 추출할 수 있어, 임의의 텍스처 변형을 자유롭게 생성한다.

기하학 네트워크는 랜드마크 좌표 l를 입력으로 받아 변위 맵 Δl을 출력하는 변형 생성기 G_l을 사용한다. 변위 맵은 콘텐츠 잠재 코드 z_c와 별도의 ‘랜드마크 스타일 코드’ z_l을 결합해 계산되며, z_l 역시 가우시안에서 샘플링하거나 실제 캐리커처에서 추출한다. 이렇게 얻어진 Δl을 원본 이미지와 원본 랜드마크에 적용해 기하학적으로 왜곡된 이미지 x_{p→c}를 만든다.

핵심 혁신은 ‘양방향 설계’이다. 사진→캐리커처 흐름뿐 아니라 캐리커처→사진 흐름을 동시에 학습함으로써 사이클 일관성 손실을 잠재 코드 수준에도 적용한다. 즉, z_s와 z_l이 양방향 변환 과정에서 동일하게 유지되도록 강제함으로써, 잠재 코드가 실제 스타일·과장과 강하게 연결되게 만든다. 이는 단일 방향 모델에서 발생할 수 있는 ‘코드 붕괴’ 문제를 완화하고, 보다 의미 있는 다양성을 확보한다.

또한 신원 보존을 위해 두 종류의 손실을 도입한다. 이미지 공간에서는 사전 학습된 얼굴 인식 모델을 이용해 원본 사진과 생성된 캐리커처의 임베딩 거리를 최소화하고, 랜드마크 공간에서는 변형 전후의 랜드마크와 원본 랜드마크 간의 구조적 차이를 최소화한다. 이중 손실은 과도한 변형으로 인한 정체성 손실을 방지하면서도 충분한 과장을 허용한다.

학습 과정은 adversarial loss, reconstruction loss, latent‑code cycle loss, identity loss 등을 종합한 복합 목표함수로 최적화된다. 실험에서는 CelebA‑Caricature와 자체 구축 데이터셋을 사용해 정량적 지표(FID, LPIPS)와 정성적 사용자 설문을 통해 기존 WarpGAN·CariGANs 대비 우수함을 입증한다. 특히, 동일 사진에 대해 여러 스타일·과장 조합을 자유롭게 생성할 수 있는 점이 큰 강점으로 부각된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기