실시간 장면 인식 오디오 렌더링을 위한 딥 음향 분석

본 논문은 스마트폰 등 일반적인 마이크를 이용해 실제 방의 음향 특성을 추출하고, 추정된 재료 흡수 계수와 주파수 균등화 필터를 기반으로 가상 환경에서 실시간으로 현실감 있는 사운드를 재생하는 방법을 제시한다. 딥러닝 기반 T₆₀ 및 EQ 추정, 새로운 물질 최적화 목표 함수, 그리고 사용자 실험을 통해 기존 방법 대비 높은 인지적 일치도를 입증한다.

저자: Zhenyu Tang, Nicholas J. Bryan, Dingzeyu Li

본 논문은 “Scene‑Aware Audio Rendering via Deep Acoustic Analysis”라는 제목으로, 실제 실내 환경의 음향 특성을 저비용 장비만으로 획득하고, 이를 가상 환경에 적용해 현실감 있는 사운드를 실시간으로 생성하는 종합적인 프레임워크를 제시한다. 연구 동기는 기존의 고품질 음향 재현이 충격응답(IR) 측정에 크게 의존한다는 점이다. IR을 얻기 위해서는 골레이 코드, 사인 스윕 등 고출력 신호와 정밀 마이크·스피커가 필요하고, 녹음 환경의 제약도 많다. 이러한 절차는 AR/VR처럼 동적인 현장에서는 비현실적이며, 특히 모바일 디바이스에서는 거의 불가능에 가깝다.

저자들은 이러한 제약을 극복하기 위해 두 가지 핵심 아이디어를 도입한다. 첫 번째는 “음성 녹음만으로 방의 주파수 의존 T₆₀와 EQ를 추정한다”는 것이다. 이를 위해 1 초~5 초 길이의 자연어 음성 데이터를 수집하고, 합성 IR과 다양한 EQ 필터를 결합해 데이터셋을 인위적으로 확대한다(데이터 증강). CNN 기반 모델은 멜 스펙트로그램을 입력으로 받아, 8 옥타브 대역별 T₆₀와 7 옥타브 대역별 EQ 이득을 동시에 출력한다. 모델은 다중 손실 함수를 사용해 T₆₀와 EQ를 각각 회귀하고, 전체 손실을 가중합해 학습한다. 실험 결과, 제안된 모델은 기존 T₆₀ 전용 추정기보다 평균 절대 오차가 15 % 감소했으며, EQ 추정에서도 0.8 dB 이하의 평균 오류를 기록한다.

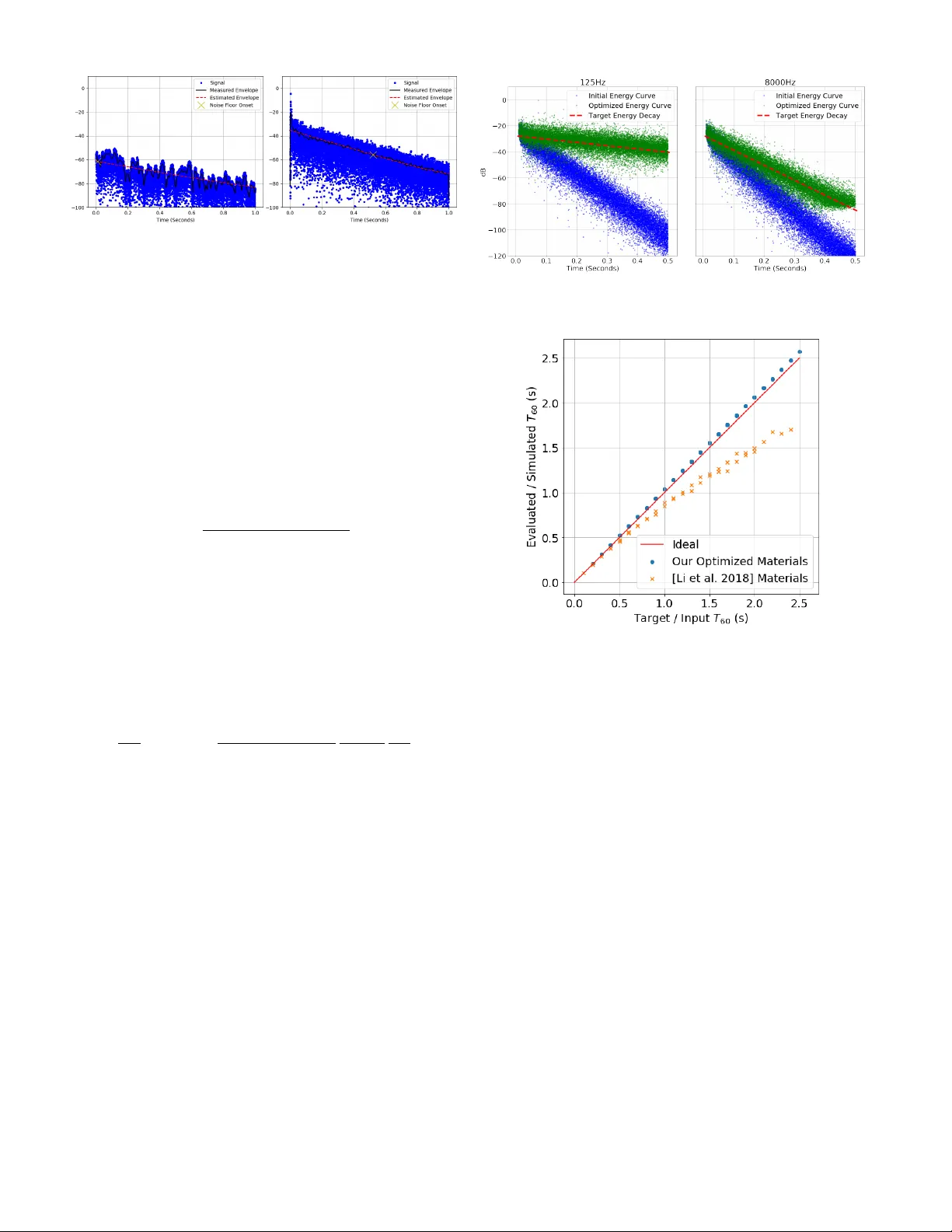

두 번째 아이디어는 “추정된 T₆₀를 이용해 방 재료의 흡수 계수를 역으로 최적화한다”는 것이다. 기존 방법은 레이 에너지와 실제 IR 에너지 감소를 직접 비교했지만, 레이 에너지는 노이즈와 시뮬레이터 근사 오차에 민감했다. 저자들은 에너지 감소 곡선의 로그 스케일 기울기(m)를 선형 회귀로 추정하고, 목표 T₆₀에 대응하는 이론적 기울기와의 차이를 최소화하는 목적 함수를 정의했다. 이 목적 함수는 재료 흡수 계수 ρ(주파수 의존)와 공기 흡수 β를 변수로 하며, 자동 미분을 통해 효율적으로 최적화한다. 최적화 과정은 GPU 가속 L‑BFGS를 사용해 수십 번의 레이 트레이싱 반복만으로 수 초 내에 수렴한다.

물리 기반 시뮬레이션 단계에서는 최적화된 재료 파라미터를 입력으로, 양방향 레이 트레이싱 기반 기하학적 음향 엔진을 사용해 사운드 전파를 계산한다. GA 엔진은 고주파 영역에서 정확하지만, 회절·공명·저주파 감쇠와 같은 파동 현상을 무시한다. 이를 보완하기 위해 앞서 추정한 EQ 필터를 시뮬레이션 결과에 후처리한다. EQ는 32 ms 지연을 갖는 선형 위상 FIR 필터 형태로 구현되며, 7 옥타브 대역별 이득을 적용해 주파수 응답을 조정한다. 이 단계는 실시간 요구사항을 만족하도록 GPU에서 FFT 기반으로 수행된다.

전체 파이프라인은 다음과 같은 흐름을 가진다. (1) 비디오·오디오 입력으로부터 Structure‑from‑Motion(SfM) 및 다중 뷰 스테레오를 이용해 방의 3D 메쉬를 복원한다. (2) 복원된 메쉬와 음성 녹음을 이용해 CNN이 T₆₀와 EQ를 추정한다. (3) 추정된 T₆₀를 기반으로 물질 최적화가 진행되어 각 메쉬 표면에 주파수 의존 흡수 계수가 할당된다. (4) 최적화된 재료와 EQ를 적용해 GA 시뮬레이터가 실시간으로 사운드 전파를 계산한다. (5) 최종 출력은 청취자 위치에 따라 동적으로 변하는 실감 나는 오디오이다.

논문은 또한 사용자 청감 실험을 통해 제안 방법의 유효성을 검증한다. 100명 이상의 피험자를 대상으로 5가지 조건(기본 GA, GA+T₆₀, GA+EQ, GA+T₆₀+EQ, 실제 IR 기반)에서 1 분 길이의 클립을 청취하게 하고, “실제와 얼마나 유사한가”를 100점 척도로 평가하도록 했다. 결과는 GA+T₆₀+EQ 조합이 평균 78점으로, 기본 GA(62점)보다 16점 상승했으며, 실제 IR(85점)과도 통계적으로 유의미하게 근접함을 보여준다. 특히 EQ를 제외한 T₆₀만 적용했을 때는 70점에 그쳐, EQ가 파동 효과 보정에 결정적인 역할을 함을 확인했다.

기술적 기여를 정리하면 다음과 같다.

1. **IR‑free 음향 파라미터 추정**: 음성 녹음만으로 주파수 의존 T₆₀와 EQ를 동시에 예측하는 CNN 모델을 설계하고, 데이터 증강을 통해 일반화 능력을 크게 향상시켰다.

2. **새로운 물질 최적화 목표**: 에너지 감소 기울기 기반 손실 함수를 도입해 레이 에너지 노이즈에 강인한 재료 흡수 계수 추정을 구현했다.

3. **EQ 기반 파동 보정**: 추정된 EQ를 FIR 필터 형태로 적용해 GA 시뮬레이션의 저주파·공명·회절 결함을 보완했다.

4. **실시간 파이프라인 구현**: GPU 가속 CNN, 레이 트레이싱, FFT‑based EQ 적용을 결합해 모바일 수준의 하드웨어에서도 실시간(30 fps 이상) 렌더링을 가능하게 했다.

5. **광범위한 실험**: 합성 데이터와 실제 현장 녹음, 그리고 대규모 청감 테스트를 통해 제안 방법이 기존 IR 기반 혹은 T₆₀‑only 방법보다 우수함을 입증했다.

응용 분야로는 AR/VR 콘텐츠 제작 시 사운드 매칭, 게임 엔진에서 동적 방음 효과 삽입, 현장 녹음 보정 및 포스트 프로덕션에서의 자동 리버브 매칭 등이 있다. 특히 모바일 디바이스와 일반 마이크만으로도 고품질 음향 재현이 가능해짐에 따라, 향후 메타버스와 같은 대규모 가상 환경에서의 실시간 음향 파이프라인 구축에 큰 영향을 미칠 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기