희소와 그룹 희소 학습을 위한 오류율 개선 및 최적화 이론

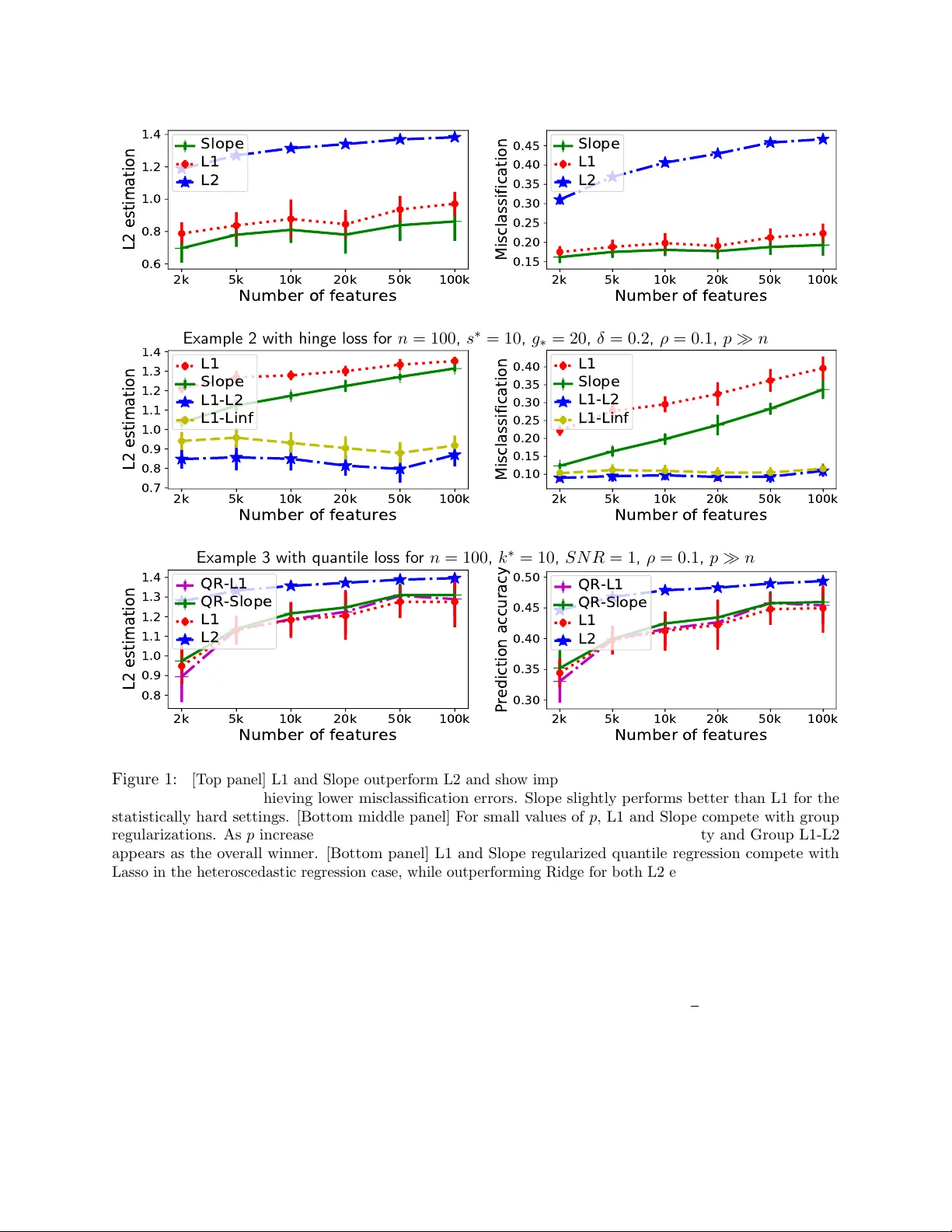

본 논문은 Lipschitz 연속성을 갖는 손실 함수(힌지, 로지스틱, 분위수 회귀)를 사용한 고차원 희소 및 그룹‑희소 추정기의 L2 추정 오차 상한을 새롭게 정립한다. L1, Slope, Group L1‑L2 정규화를 각각 다루며, 기존 결과를 능가하는 (k*/n)·log(p/k*) 및 (s*/n)·log(G/s*)+m*/n 형태의 상한을 제시한다. 또한 서브가우시안 선형 회귀에 적용해 Lasso와 Group‑Lasso에 대한 최적 최소화율…

저자: Antoine Dedieu

본 논문은 고차원 데이터 분석에서 널리 사용되는 희소 및 그룹‑희소 추정기를, 힌지 손실, 로지스틱 손실, 분위수 회귀 손실 등 Lipschitz 연속성을 갖는 일반적인 손실 함수와 결합하여 이론적 성능을 분석한다. 연구는 크게 네 부분으로 구성된다.

첫 번째 부분에서는 문제 설정과 목표를 명확히 한다. 관측 데이터 \((x_i,y_i)_{i=1}^n\)와 설계 행렬 \(X\in\mathbb{R}^{n\times p}\)가 주어지고, 손실 함수 \(f(\cdot;y)\)가 convex, L‑Lipschitz, 서브그라디언트를 갖는다고 가정한다. 이때 이론적 위험 \(L(\beta)=\mathbb{E}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기