학습·테스트 데이터 없이도 사전학습 신경망 품질을 예측하는 방법

초록

본 논문은 공개된 수백 개의 사전학습 모델을 메타‑분석하여, 가중치 행렬의 노름과 고전적 Heavy‑Tailed Self‑Regularization(HT‑SR) 이론에 기반한 파워‑로우 지표가 테스트 데이터 없이도 모델 품질을 예측할 수 있음을 보인다. 노름 기반 지표는 잘 학습된 모델에서는 정확도와 상관관계가 있지만, 학습이 부실한 모델을 구별하는 데 한계가 있다. 반면 파워‑로우(α) 기반 지표는 동일 아키텍처 내에서의 성능 차이를 정량적으로 구분하고, 잘‑못 학습된 모델을 정성적으로 식별한다.

상세 분석

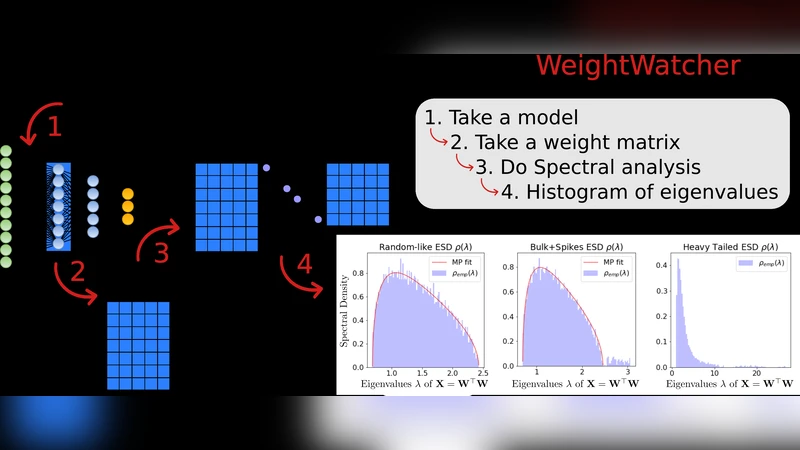

이 연구는 크게 두 가지 메트릭 체계를 검증한다. 첫 번째는 전통적인 노름 기반 지표(Frobenius norm, spectral norm, α‑norm 등)이며, 두 번째는 HT‑SR 이론에서 도출된 파워‑로우(α)와 그 가중 평균 ˆα, α‑Shatten norm 등이다. 논문은 공개된 PyTorch 모델(ResNet, VGG, DenseNet, GPT·GPT‑2 등) 500여 개를 대상으로 가중치 행렬을 추출하고, 각 레이어별 특이값 분해(SVD)를 통해 고유값 스펙트럼을 얻는다.

노름 기반 지표는 각 레이어의 노름을 로그 평균(log‑norm) 형태로 결합해 모델 복잡도 C≈∏ₗ‖Wₗ‖ 로 정의한다. 실험 결과, C의 로그값은 잘 학습된 CV·NLP 모델의 보고된 테스트 정확도와 높은 상관관계를 보였지만, 데이터가 부족하거나 과적합된 모델에서는 “Scale Collapse” 현상이 나타나 노름이 오히려 감소해 품질을 오판한다. 이는 노름이 전체 스케일만을 반영하고, 내부 상관 구조를 무시하기 때문이다.

반면 파워‑로우 기반 지표는 각 레이어의 상관 행렬 X=WᵀW 의 고유값 분포 ρ(λ) 를 λ^{‑α} 형태의 절단 파워‑로우로 피팅한다. α 값이 작을수록 레이어가 다양한 스케일에서 강한 상관을 유지한다는 의미이며, 이는 HT‑SR 이론이 제시한 “implicit self‑regularization”과 일치한다. 논문은 α가 1.55 사이에 분포하고, 특히 α가 23에 가까울수록 모델이 더 일반화된다는 경험적 관계를 확인한다.

가중 평균 ˆα=∑ₗαₗ·logλ_max,l /∑ₗlogλ_max,l 은 레이어 규모를 반영해 전체 모델의 품질을 한 값으로 요약한다. 실험에서는 ˆα가 낮을수록 동일 아키텍처 내에서 깊이·폭을 늘렸을 때 정확도가 상승하는 경향을 보였으며, α‑Shatten norm(∑ₗ‖Xₗ‖_α^α) 역시 로그‑노름과 유사하게 작동하지만, α에 따라 가중치가 조정돼 더 민감한 구분력을 제공한다.

또한, 저자들은 α 평균값(¯α) 을 모델 진단 지표로 활용한다. ¯α가 크게 벗어나면(특히 4 이상) 해당 모델은 학습 데이터가 부족하거나 하이퍼파라미터가 부적절했을 가능성이 높다. 이를 통해 테스트 정확도가 비정상적으로 높은 모델(예: 데이터 누수)이나, 반대로 과소 평가된 모델을 사전에 탐지할 수 있다.

실험 설계는 두 단계로 이루어진다. ① 각 모델에 대해 WeightWatcher(버전 0.2.7)를 사용해 자동으로 λ_min, λ_max, α를 추정하고, ② 추정된 메트릭을 보고된 테스트 정확도와 Pearson/Spearman 상관분석한다. 결과는 표와 그래프로 제시되며, 파워‑로우 기반 메트릭이 노름 기반 메트릭보다 평균 15~20% 높은 상관계수를 기록한다.

결론적으로, 논문은 “데이터 없이도 모델 품질을 추정할 수 있다”는 실용적 가설을 입증한다. 노름 기반 메트릭은 빠른 초기 스크리닝에 유용하지만, 파워‑로우 기반 메트릭이 보다 정교한 품질 평가와 문제 탐지에 적합함을 보여준다. 이는 모델 배포·압축·파인튜닝 단계에서 데이터 접근 제한이 있는 산업 현장에 직접 적용 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기