압축된 신경망이 잃어버리는 것

본 논문은 신경망 프루닝·양자화와 같은 압축 기법이 전체 정확도에는 큰 영향을 주지 않지만, 데이터 분포의 장기(롱테일)와 어려운 샘플에 대해선 성능 저하를 일으킨다는 점을 밝혀낸다. 압축으로 인해 크게 영향을 받는 소수의 이미지들을 “Pruning Identified Exemplars(PIE)”라 정의하고, 이들이 인간에게도 인식이 어려운 잡음·다중 객체·라벨 오류 등을 포함한다는 사실을 실험과 인간 조사로 입증한다. 또한 클래스별 정확도 차…

저자: Sara Hooker, Aaron Courville, Gregory Clark

본 논문은 딥러닝 모델 압축(프루닝·양자화)이 전체 테스트 정확도에는 거의 영향을 주지 않지만, 데이터 분포의 특정 부분—특히 장기(롱테일)와 잡음이 섞인 어려운 샘플—에 대해선 심각한 성능 저하를 초래한다는 사실을 체계적으로 조사한다. 연구자는 먼저 CIFAR‑10, CelebA, ImageNet 세 가지 벤치마크와 Wide‑ResNet, ResNet‑50, ResNet‑18 아키텍처를 사용해 30개의 독립 모델을 각각 학습시킨다. 프루닝은 가중치 비율 t = 0.3, 0.5, 0.7, 0.9 로 진행하고, 양자화는 사후 적용 방식인 float16, hybrid‑int8, fixed‑int8을 적용한다.

압축 전후 모델의 전체 top‑1/5 정확도는 거의 변하지 않지만, 클래스별 정확도 변화를 Welch’s t‑test 로 검증한다. H0(클래스 정확도 변화가 전체 정확도 변화와 비례) 를 기각하고 p < 0.05인 클래스는 “불균형 영향”을 받는 것으로 판단한다. 실험 결과, 프루닝 비율이 높아질수록 영향을 받는 클래스 수가 급증한다. 예를 들어 50 % 프루닝에서는 ImageNet 170개, 70 % 프루닝에서는 372개의 클래스가 통계적으로 유의미한 정확도 감소를 보였다. 반면 양자화는 같은 수준의 불균형 영향을 적게 나타내며, 가장 공격적인 fixed‑int8 양자화에서도 영향을 받는 클래스는 119개에 불과했다. 이는 가중치를 완전히 제거하는 프루닝이 모델의 표현력을 크게 약화시키는 반면, 정밀도 감소는 비교적 완만한 손실을 야기한다는 점을 시사한다.

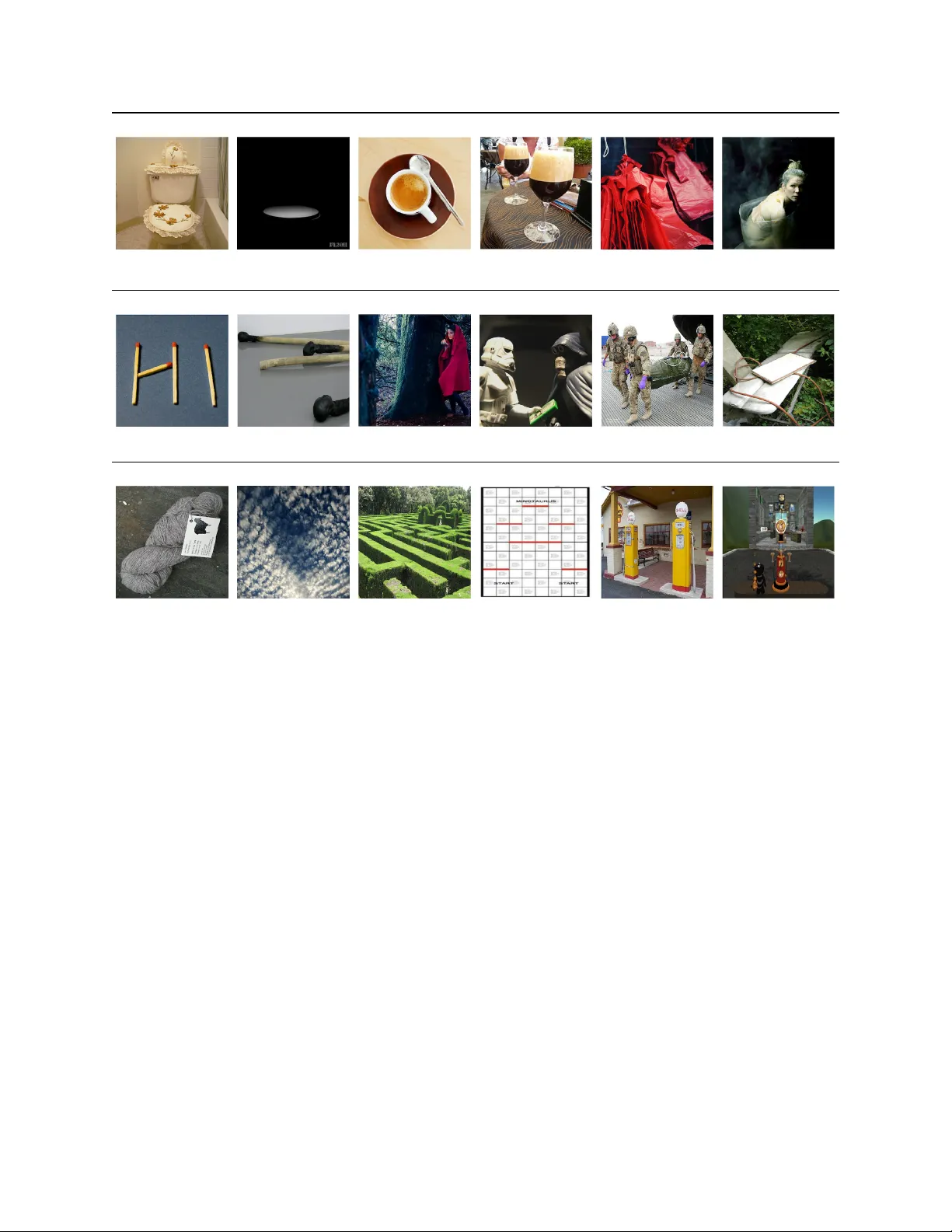

다음으로 저자들은 “Pruning Identified Exemplars”(PIE) 라는 개념을 도입한다. 각 테스트 이미지에 대해 30개의 모델 예측을 모아 다수결 라벨을 구하고, 프루닝 모델과 비프루닝 모델의 다수결 라벨이 다르면 해당 이미지를 PIE로 정의한다. 프루닝 비율이 증가할수록 PIE 비율도 상승했으며, 90 % 프루닝 시 ImageNet 전체 테스트셋의 10.27 %가 PIE, CIFAR‑10은 2.16 %, CelebA는 16.17 %가 PIE로 식별되었다. PIE는 비프루닝 모델조차도 낮은 정확도를 보이며, 전체 테스트셋 대비 top‑1 정확도가 크게 떨어진다(예: ImageNet 76.75 % → 39.81 %).

PIE의 특성을 파악하기 위해 인간 라벨링 실험을 수행했다. 결과는 PIE가 라벨 오류, 저해상도, 다중 객체, 미세 구분이 필요한 이미지 등 인간에게도 인식이 어려운 특성을 과다하게 포함한다는 것을 보여준다. 또한, CelebA에서 PIE가 인종·성별·연령 등 민감한 속성의 장기에 과다하게 나타나는 것을 확인해, 압축이 데이터의 장기와 민감한 속성에 불균형적인 손실을 초래함을 입증한다.

프루닝이 자연적 적대 이미지와 이미지 손상에 대한 민감도를 높인다는 추가 실험도 수행했다. 높은 프루닝 비율일수록 이러한 변형에 대한 오류율이 크게 증가한다.

전체적으로 이 연구는 압축된 모델을 실제 서비스에 적용할 때, 단순히 전체 정확도만을 기준으로 판단하면 안 된다는 경고를 제시한다. 특히 의료·보안·자율주행 등 고신뢰성이 요구되는 분야에서는 클래스별·샘플별 성능을 별도로 검증하고, PIE와 같은 도구를 활용해 위험도가 높은 데이터를 사전에 탐지·보완해야 한다는 실용적 시사점을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기