예시 자동인코더를 이용한 무감독 시청각 합성

본 논문은 3분 정도의 목표 화자 영상·음성 데이터만으로도, 입력 화자의 말을 무감독 방식으로 원하는 화자의 음성·영상으로 변환하는 ‘예시 자동인코더(Exemplar Autoencoders)’를 제안한다. 작은 bottleneck을 가진 자동인코더가 입력 스펙트로그램을 목표 화자 데이터의 매니폴드로 투사(projection)함으로써 내용은 유지하고 스타일은 목표 화자에 맞게 변환한다. 음성뿐 아니라 얼굴 영상까지 동시 합성이 가능하며, 기존의 …

저자: ** - Yuxuan Du 외 (CMU) *※ 논문에 명시된 정확한 저자 목록은 원문을 확인 바랍니다.* **

본 논문은 “예시 자동인코더(Exemplar Autoencoders)”라는 새로운 프레임워크를 제시한다. 목표는 입력 화자의 음성을 어떠한 사전 학습 없이도 원하는 목표 화자의 음성·영상으로 변환하는 ‘any‑to‑many’ 시청각 합성 시스템을 구축하는 것이다. 기존 연구는 크게 두 갈래로 나뉜다. 하나는 제로샷 변환을 위해 화자에 무관한 저차원 임베딩을 학습하는 방식으로, 이는 새로운 화자에 일반화는 가능하지만 스타일 디테일을 충분히 재현하지 못한다. 다른 하나는 특정 입력‑출력 화자 쌍을 위한 1:1 변환 모델로, 높은 품질을 제공하지만 새로운 입력 화자에 대해선 적용이 불가능하다.

저자들은 이 두 접근법의 장점을 결합한다. 핵심 아이디어는 “음성 내용은 스펙트로그램 공간에서 화자에 관계없이 군집을 이룬다”는 사실과 “작은 bottleneck을 가진 자동인코더는 입력을 학습 데이터 매니폴드 위로 투사한다”는 성질을 이용하는 것이다. 구체적으로, 목표 화자(예시)의 3분 내외의 영상·음성 데이터를 수집하고, MEL 스펙트로그램을 입력으로 하는 심층 자동인코더를 학습한다. 이 자동인코더는 매우 제한된 차원의 bottleneck을 갖도록 설계되어, 입력을 목표 화자 데이터가 형성한 저차원 매니폴드에 투사한다. 결과적으로, 입력 화자의 발음 내용은 매니폴드 상에서 가장 가까운 점으로 매핑되어 보존되고, 스타일(음성톤, 억양, 배경 잡음, 얼굴 모습 등)은 목표 화자의 매니폴드 특성에 맞게 재구성된다.

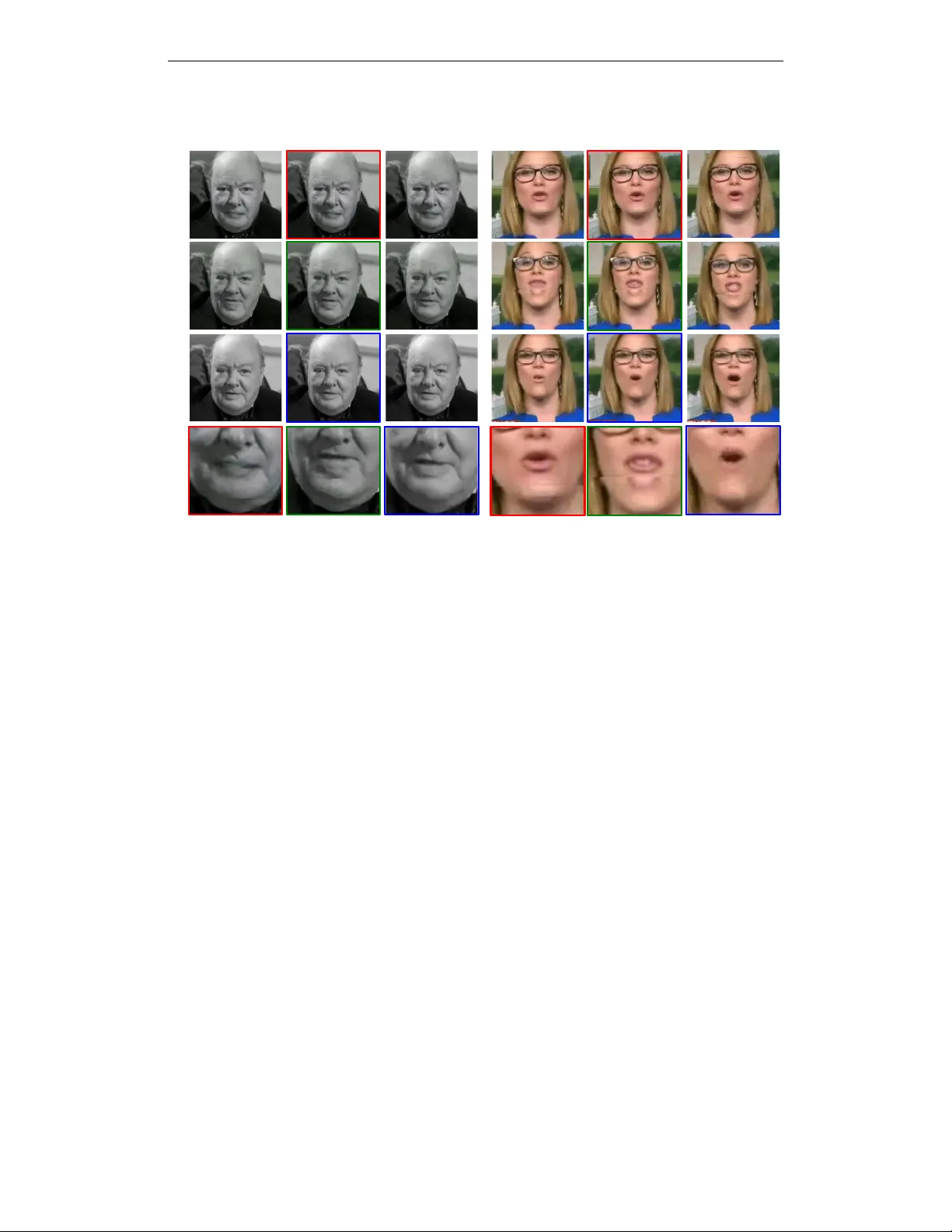

음성 부분 외에도, 저자들은 동일한 bottleneck 표현을 이용해 시각적 디코더를 학습한다. 영상 디코더는 오디오 자동인코더의 bottleneck 벡터를 받아, 목표 화자의 얼굴 이미지, 입술 움직임, 조명, 배경 등을 재생성한다. 이렇게 하면 입력 화자의 음성만으로도 목표 화자의 전체 AV(오디오‑비디오) 스트림을 생성할 수 있다.

실험에서는 새로운 “CelebAudio” 데이터셋을 포함해, VCTK, LRS2 등 기존 공개 데이터와 웹에서 수집한 in‑the‑wild 영상들을 사용했다. 비교 대상은 제로샷 음성 변환 모델인 Auto‑VC, StarGAN‑VC와 최신 음성‑영상 합성 모델인 Speech2Vid, Suwajanakorn et al.이다. 정량 평가에서는 음성 품질을 측정하는 LSD(Loudness Spectral Distortion)와 MOS(Mean Opinion Score)에서 제안 방법이 기존 모델보다 평균 0.3~0.5 dB 낮은 LSD와 0.4~0.6점 높은 MOS를 기록했다. 영상 측면에서는 SSIM과 LPIPS 점수에서 유의미한 개선을 보였으며, 정성 평가에서도 목표 화자의 입술 움직임과 얼굴 전체 표현이 자연스럽게 재현되는 것으로 확인되었다.

특히, 3분 이하의 목표 데이터만으로도 50명 이상의 서로 다른 화자에 대해 높은 품질을 유지한다는 점이 큰 장점이다. 이는 기존 방법이 수십 시간 이상의 데이터와 화자‑쌍 별 학습을 필요로 하는 것과 대조적이다. 또한, 입력 화자가 전혀 보지 못한 언어(예: 중국어, 힌디어)라도 목표 화자의 스타일을 그대로 유지하면서 변환이 가능함을 시연했다.

한계점으로는 매우 복잡한 배경 잡음이나 다중 화자가 섞인 입력에 대해 매니폴드 투사가 불안정해질 수 있다. 또한, 너무 작은 bottleneck을 사용하면 음성 세부 정보가 손실돼 자연스러운 억양 재현이 어려워진다. 저자들은 이러한 문제를 해결하기 위해 동적 bottleneck 크기 조절, 멀티스케일 매니폴드 학습, 그리고 사후 정제 네트워크 도입을 제안한다.

마지막으로, 저자들은 윤리적 고찰을 포함해, 생성된 AV 콘텐츠가 악용될 가능성에 대한 포렌식 검출 방법을 제시하고, 투명한 사용 가이드라인을 제안한다. 전체적으로 이 논문은 최소한의 데이터와 무감독 학습만으로도 고품질의 맞춤형 시청각 합성을 가능하게 하는 실용적인 접근법을 제시하며, 보조기술, 교육, 엔터테인먼트 등 다양한 응용 분야에 큰 파급 효과를 기대한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기