가우시안 네트워크 학습을 위한 베이지안 접근법

초록

본 논문은 연속 변수만을 포함하는 도메인에서 베이지안 네트워크 구조를 학습하기 위한 점수화 메트릭과 탐색 절차를 제시한다. 다변량 정규분포 가정 하에 사건 등가(event equivalence)와 파라미터 모듈러리티(parameter modularity)라는 두 핵심 가정을 도입해, 사용자가 제공한 단일 사전 베이지안 네트워크로부터 다변량 정규 파라미터의 사전 분포를 구성한다. 이를 통해 연속형 데이터에 대한 구조 학습이 가능한 점수 함수를 유도하고, 완전·불완전 네트워크에 대한 베이지안 업데이트 식을 제시한다.

상세 분석

이 논문은 기존에 주로 이산 변수에 초점을 맞추어 개발된 베이지안 네트워크 학습 프레임워크를 연속 변수, 즉 가우시안(다변량 정규) 변수에 확장한다는 점에서 의미가 크다. 핵심 아이디어는 두 가지 가정, ‘사건 등가(event equivalence)’와 ‘파라미터 모듈러리티(parameter modularity)’를 도입함으로써, 구조마다 별도의 사전 분포를 정의할 필요 없이 하나의 사전 베이지안 네트워크만으로 모든 가능한 구조에 대한 사전을 일관되게 정의할 수 있다는 것이다.

-

가우시안 베이지안 네트워크 정의

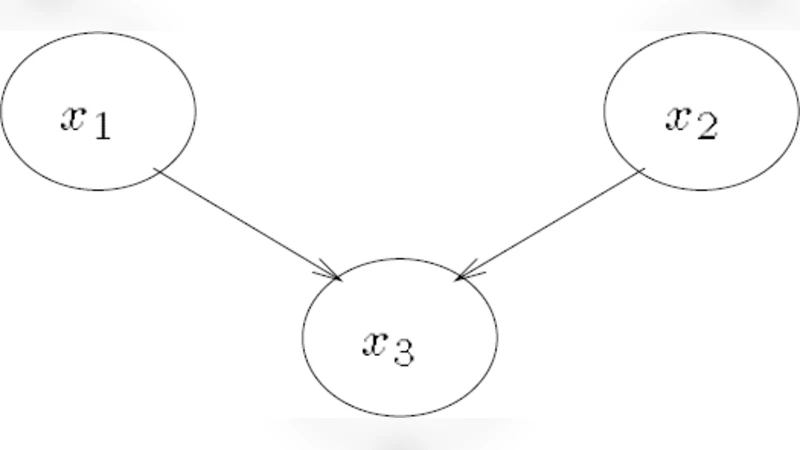

- 변수 집합 x = {x₁,…,xₙ}에 대해 각 변수는 선형 회귀 형태의 조건부 정규분포를 가진다(식 4).

- 회귀계수 bᵢⱼ 가 0이면 xⱼ 는 xᵢ 의 부모가 아니며, 이는 그래프 구조와 직접 대응한다.

- 따라서 구조 B_S 와 파라미터 (m, v, B) 는 다변량 정규분포의 평균 m 과 정밀도 행렬 W (= Σ⁻¹)으로 완전히 기술된다.

-

사건 등가(event equivalence)

- 두 구조가 동일한 독립성(conditional independence) 관계를 표현하면 같은 사건 B_eS 에 해당한다.

- 이를 통해 구조가 등가 클래스에 속하면 동일한 점수를 부여하도록 보장한다.

- 논문은 사건 정의를 약간 수정해 겹치는 사건들의 교집합을 측정 0 집합으로 처리함으로써, 사건들이 상호 배타적이면서도 등가성을 유지하도록 설계한다.

-

파라미터 모듈러리티(parameter modularity)

- 구조가 바뀌어도 동일한 부모‑자식 관계에 대한 파라미터 사전은 변하지 않는다.

- 즉, 특정 변수 xᵢ 의 조건부 분포에 대한 사전은 그 변수의 부모 집합 Πᵢ 만을 의존한다.

- 이 가정은 사전 분포를 ‘정규‑위시트( Normal‑Wishart )’ 형태로 선택하게 만든다.

-

정규‑위시트 사전과 사후 계산

- 가정 1(데이터는 다변량 정규표본)과 2(데이터는 완전) 하에, 평균 m 과 정밀도 W 에 대한 사전은 정규‑위시트 분포로 설정한다(정리 3).

- 이 사전은 데이터가 추가될 때 폐쇄형 형태로 업데이트되며, 사후 평균 μ_l 과 정밀도 W 의 파라미터는 샘플 평균 X̄ 와 산포 행렬 S_l 에 의해 간단히 계산된다(식 7‑9).

- 따라서 구조 B_S 에 대한 점수 ρ(D, B_eS | ξ) 는 사전·사후 정규‑위시트 정규화 상수들의 비율로 표현될 수 있다.

-

점수 함수와 탐색 절차

- 구조 점수는 사전 구조 확률 p(B_S | ξ)와 데이터 우도 ρ(D | B_S, ξ) 의 곱으로 정의된다.

- 사건 등가에 의해 동일한 독립성 집합을 가진 구조들은 동일한 점수를 갖게 되므로, 탐색 알고리즘은 등가 클래스를 기준으로 탐색 효율을 높일 수 있다.

- 논문은 완전 그래프(모든 가능한 부모‑자식 관계가 존재)와 불완전 그래프(일부 엣지가 제거된 경우) 모두에 대해 점수 함수를 유도하고, 구조 변경 시 파라미터 사전이 어떻게 변하는지를 명시한다.

-

실용적 의의

- 연속형 변수에 대해 별도의 이산화(discretization) 과정을 거치지 않아도 되므로, 정보 손실과 차원 폭발 문제를 회피한다.

- 파라미터 공간이 다변량 정규분포의 경우 O(n²) 정도에 불과해, 이산 변수에서 요구되는 지수적 파라미터 수와 비교해 계산 효율이 크게 향상된다.

- 사용자는 도메인 지식을 평균, 회귀계수, 조건부 분산 형태로 제공하면 되며, 이는 직관적인 ‘베이지안 네트워크 설계’와 일치한다.

전반적으로 이 논문은 베이지안 네트워크 학습 이론을 연속형 데이터에 자연스럽게 확장하고, 사건 등가와 파라미터 모듈러리티라는 두 원칙을 통해 사전 설계와 점수 계산을 일관되게 수행할 수 있는 체계적인 방법을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기