자율차량을 활용한 동적 경로 제어로 혼합 교통 혼잡 최소화

초록

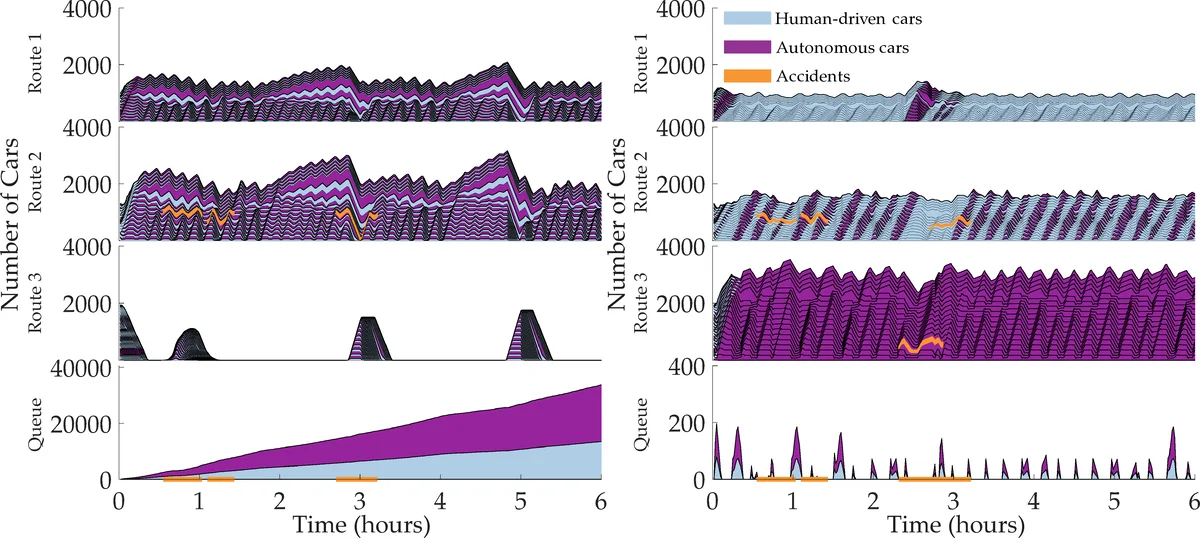

본 논문은 자율주행 차량만을 제어해 인간 운전자의 경로 선택을 간접적으로 유도함으로써, 혼합 자율교통망에서 교통 혼잡을 감소시키는 방법을 제시한다. 딥 강화학습(PPO) 기반 정책을 학습하고, 평행 도로 네트워크에 대한 균형 해석을 통해 최적 균형을 다항시간으로 계산한다. 실험 결과, 제안된 정책이 사고·수요 급증 등 외란 상황에서도 평균 여행 시간을 크게 단축시키며, 기존 MPC·그리디 방식보다 우수함을 보인다.

상세 분석

이 연구는 두 가지 축을 동시에 탐구한다. 첫째, 혼합 자율교통망에서 인간 운전자가 자기이익을 따르는 나쉬 균형(Nash equilibrium)의 구조적 특성을 분석한다. 특히 평행 도로(다중 경로) 모델에 대해, 자율차 비율이 도로 용량에 미치는 영향을 수식화하고, ‘가장 효율적인 균형(optimal equilibrium)’을 찾는 다항시간 알고리즘을 제시한다. 이는 기존 문헌이 정적·정상 상태에만 초점을 맞춘 것과 달리, 동적 라우팅 게임에서 균형이 어떻게 변하는지를 명시적으로 보여준다.

둘째, 실제 동적 시스템을 다루기 위해 모델‑프리 딥 강화학습을 적용한다. 저자들은 셀 전송 모델(CTM)을 확장해, 각 셀의 임계 밀도와 최대 흐름을 자율차 비율 α에 따라 조정한다(α가 높을수록 헤드웨이가 짧아져 용량이 증가). 교차로에서는 충돌점(conflict point)별 우선순위 β를 도입해, 인간·자율차 흐름을 동시에 고려한 흐름 계산 알고리즘을 설계한다. 이러한 복잡한 연속·이산 상태·액션 공간을 직접 모델링하기 어려운 상황에서, Proximal Policy Optimization(PPO) 기반 정책을 학습한다. 정책은 현재 네트워크 상태(셀 밀도, 자율차 비율 등)를 입력받아, 각 자율차가 선택할 경로 확률을 출력한다.

학습된 정책은 인간 운전자의 반응 모델(즉시 최단 경로 선택)과 결합될 때, 시스템 전체가 ‘사회적으로 바람직한’ 균형으로 수렴한다는 점이 핵심이다. 실험에서는 수요 급증, 사고에 의한 도로 차단 등 외란을 가했을 때도, 정책이 빠르게 새로운 균형을 찾아 평균 여행 시간을 30~50% 정도 감소시킨다. 또한, 동일한 시나리오에서 MPC 기반 최적 제어와 그리디 흐름 재분배 기법을 적용했을 때보다 성능이 현저히 우수함을 입증한다.

이 논문의 주요 공헌은 (1) 혼합 자율교통망에서의 균형 구조를 이론적으로 규명하고, 최적 균형을 효율적으로 계산하는 알고리즘을 제공한 점, (2) 복잡한 교통 흐름 모델을 직접 모델링하지 않고도 딥 RL을 통해 실시간 라우팅 정책을 학습함으로써, 인간 운전자의 자율적 선택을 유도해 전체 시스템 효율을 크게 향상시킨 점이다. 특히, 자율차 비율이 낮은 초기 단계에서도 정책이 효과를 발휘한다는 점은 실제 도입 초기 단계에 실용적 함의를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기