훈련 없이 성능을 예측하는 베이지안 신경망 구조 탐색

본 논문은 RNN 구조 최적화를 위해 베이지안 최적화와 훈련‑무료 성능 추정 지표인 MRS(Mean Absolute Error Random Sampling)를 결합한다. 가변 길이의 아키텍처를 고정 길이 인코딩 세 가지(Plain, Flag, Size)로 변환하여 BO가 적용 가능하도록 하였으며, 세 가지 실험(사인파, 재활용 쓰레기 채움 수준, 슬로바키아 전력 수요)에서 기존 방법 대비 학습 시간은 크게 단축하면서도 예측 정확도는 유지함을 보…

저자: Andres Camero, Hao Wang, Enrique Alba

본 논문은 순환 신경망(RNN) 구조 최적화 문제를 베이지안 최적화(Bayesian Optimization, BO)와 훈련‑무료 성능 추정 지표인 Mean Absolute Error Random Sampling(MRS)을 결합하여 해결한다. RNN은 시계열 예측에 강력하지만, 아키텍처와 하이퍼파라미터에 민감해 최적 구성을 찾는 데 많은 시간과 계산 자원이 소요된다. 전통적인 접근법은 전문가의 경험에 의존하거나, 그리드 탐색·진화 알고리즘·BO 등 자동화 기법을 사용하지만, 후보 모델을 실제 학습시켜 평가하는 과정이 병목이 된다.

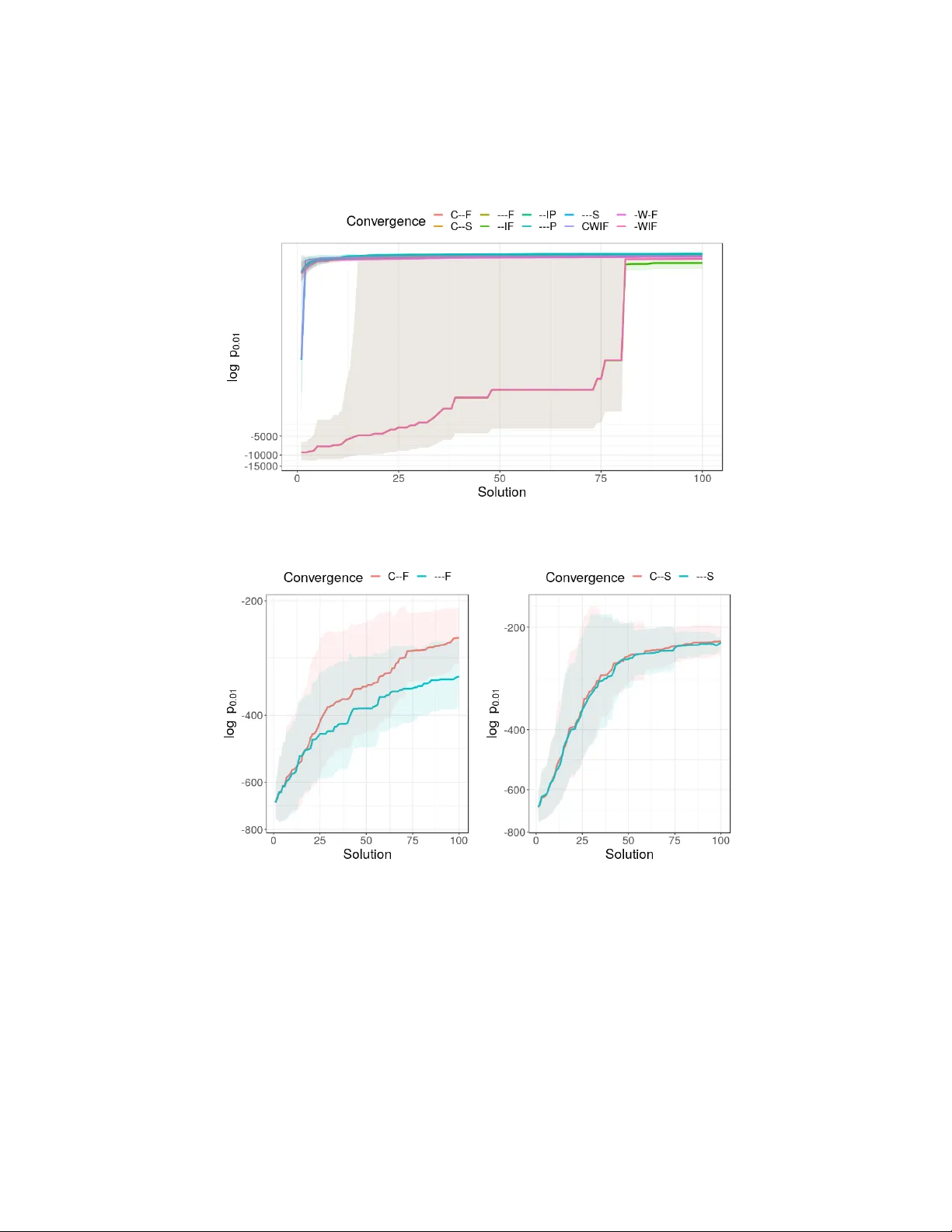

MRS는 무작위 초기 가중치를 여러 번 샘플링하고, 각 샘플에 대해 MAE(Mean Absolute Error)를 계산한다. 얻은 오류값들의 평균(μ)과 표준편차(σ)를 이용해 정규분포를 근사하고, 사용자가 정의한 오류 임계값(p_m, 본 연구에서는 1%) 이하가 나올 확률을 구한다. 이 확률이 높을수록 실제 학습 후 좋은 성능을 기대할 수 있다는 가정 하에, MRS 값을 최대화하는 방향으로 아키텍처를 탐색한다. MRS는 실제 학습 없이도 성능을 추정하므로, 후보 모델 평가 비용을 크게 낮출 수 있다.

BO는 고비용 함수 최적화를 위해 서플러 모델(본 논문에서는 랜덤 포레스트)과 획득 함수(EI)를 사용한다. 그러나 BO는 일반적으로 고정 차원의 연속 공간을 전제로 설계돼 있어, 레이어 수와 뉴런 수가 가변적인 RNN 구조를 직접 다루기 어렵다. 이를 해결하기 위해 저자는 세 가지 고정 길이 인코딩 방식을 제안한다.

1. **Plain 인코딩**: 레이어 수 m과 시간 단계 T가 정해진 경우, 각 레이어의 뉴런 수 h_i와 시간 단계 l을 순차적으로 나열한다. h_i가 0이면 해당 레이어는 비활성화된다. 인코딩 길이는 m+1이다.

2. **Flag 인코딩**: 각 레이어에 활성화 플래그 b_i(0/1)를 추가한다. 인코딩 길이는 2m+1이며, b_i=0이면 해당 레이어를 무시한다.

3. **Size 인코딩**: 실제 사용될 레이어 수 s를 별도로 지정하고, 앞쪽 s개의 레이어만 해석한다. 인코딩 길이는 m+2이며, s≤m이다.

이러한 인코딩은 가변 길이 구조를 고정 차원의 벡터로 변환함으로써 랜덤 포레스트가 효과적으로 학습될 수 있게 한다. 또한, 불가능한 구조에 대한 페널티를 부여하거나 초기 해집합을 활용한 워밍업(warm‑start) 전략을 통해 탐색 효율을 높였다.

실험은 세 가지 실제 시계열 데이터셋에 대해 수행되었다. 첫 번째는 사인파 예측, 두 번째는 217개의 재활용 쓰레기통 채움 수준 예측, 세 번째는 슬로바키아 전력 수요 예측이다. 각 실험에서 제안된 BO‑MRS 프레임워크는 기존 전체 학습 기반 NAS와 비교해 약 70~90%의 시간 절감을 달성했으며, 최종 선택된 아키텍처를 ADAM으로 짧게 학습시킨 결과는 기존 최적화 방법과 거의 동일한 MAE를 기록했다. 특히, Flag와 Size 인코딩은 탐색 공간을 효율적으로 제한하면서도 다양한 구조를 탐색할 수 있게 해, 최적 구조 발견에 크게 기여했다.

논문의 주요 기여는 다음과 같다.

- **훈련‑무료 메트릭(MRS) 활용**: 후보 구조 평가 비용을 크게 낮추어 BO가 더 많은 반복을 수행하도록 함.

- **고정 길이 인코딩 설계**: 가변 길이 RNN 구조를 BO가 다룰 수 있는 고정 차원 벡터로 변환, 세 가지 인코딩 방식 제시.

- **BO 효율성 강화**: 불가능한 해에 페널티 부여와 워밍업 전략을 도입해 탐색 효율을 향상.

한계점으로는 MRS가 실제 학습 후 성능을 완벽히 예측하지는 못한다는 점이다. 따라서 최종 단계에서 짧은 학습을 통해 후보를 검증해야 한다. 또한, 현재는 랜덤 포레스트를 서플러로 사용했으며, 정규화된 연속 공간을 다루는 가우시안 프로세스와의 비교는 향후 연구 과제로 남는다.

결론적으로, 본 연구는 훈련‑무료 성능 추정과 베이지안 최적화를 결합함으로써 RNN 아키텍처 탐색의 비용을 크게 절감하면서도 높은 예측 정확도를 유지하는 실용적인 방법을 제시한다. 이는 시계열 예측뿐 아니라 다양한 딥러닝 분야에서 비용 효율적인 NAS 접근법으로 확장 가능성을 가진다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기