PathologyGAN 암 조직의 깊은 표현 학습

** 본 논문은 GAN 기반 모델인 PathologyGAN을 제안하여 대규모 병리학 이미지에서 조직 형태와 세포 구성을 자동으로 학습하고, 고품질 합성 이미지를 생성함과 동시에 의미 있는 잠재 공간을 구축한다. 대장암과 유방암 두 데이터셋에서 FID 32.05·16.65를 달성했으며, 병리학자 평가에서도 실제와 구분이 어려운 결과를 보였다. **

저자: Adalberto Claudio Quiros, Roderick Murray-Smith, Ke Yuan

**

본 논문은 병리학 이미지에서 조직 형태와 세포 구성을 자동으로 학습하고, 이를 기반으로 고품질 합성 이미지를 생성하는 새로운 GAN 프레임워크인 PathologyGAN을 제안한다. 기존의 지도 학습 기반 병리학 연구는 라벨링 비용이 높고, 라벨이 조직의 미세 환경을 완전히 포착하기 어렵다는 한계가 있다. 이를 극복하고자 저자들은 비지도 학습, 특히 표현 학습 능력을 갖춘 생성 모델을 활용한다.

**모델 설계**

PathologyGAN은 BigGAN을 기본 구조로 채택하고, StyleGAN‑2의 매핑 네트워크와 스타일 믹싱, AdaIN을 도입해 잠재 공간을 보다 해석 가능하고 조작 가능하게 만든다. 매핑 네트워크는 4‑layer ResNet으로 구성돼, 표준 정규분포에서 샘플링된 잡음 z 를 고차원 잠재 벡터 w 로 변환한다. 이 과정은 잠재 차원에서의 비선형 변형을 촉진해, 조직의 색상·텍스처·세포 밀도와 같은 고수준 특성을 별도의 차원에 분리한다. 스타일 믹싱은 두 개의 서로 다른 z 를 동일한 생성기에 투입하고, 중간 레이어에서 교체함으로써 “고수준 특성”이 특정 레이어에 국한되도록 강제한다. 이는 잠재 공간에서 의미론적 벡터 연산이 실제 이미지 변형으로 직결되게 만든다.

판별기에는 Relativistic Average Discriminator(RAD)를 적용했다. RAD는 단순히 “진짜인지 가짜인지”를 판단하는 것이 아니라, 실제 샘플이 가짜보다 더 현실적인 확률을 추정한다. 이를 통해 학습이 더 안정화되고, 기존 hinge loss 대비 빠른 수렴과 높은 이미지 품질을 얻을 수 있었다.

**데이터 및 전처리**

두 종류의 데이터셋을 사용했다. (1) 독일 NCT에서 제공한 대장암 슬라이드 86장, 총 100 K 패치(224 × 224)와 10가지 조직 라벨(지방, 배경, 파편, 림프구, 근육 등). (2) 네덜란드 NKI와 캐나다 VGH에서 수집한 유방암 TMA 576개, 환자 576명, 총 249 K 학습 패치와 62 K 테스트 패치. 패치 추출 시 50 % 겹치게 슬라이딩하고, 회전·수평·수직 반전 등 기본 증강을 적용했으며, 조직이 70 % 이상 차지하는 패치만 사용했다.

학습은 NVIDIA Titan RTX 24 GB GPU에서 72시간 동안 진행됐으며, Adam 옵티마이저(β₁=0.5, lr=1e‑4)를 사용하고 판별기 5 step : 생성기 1 step 비율을 유지했다.

**성능 평가**

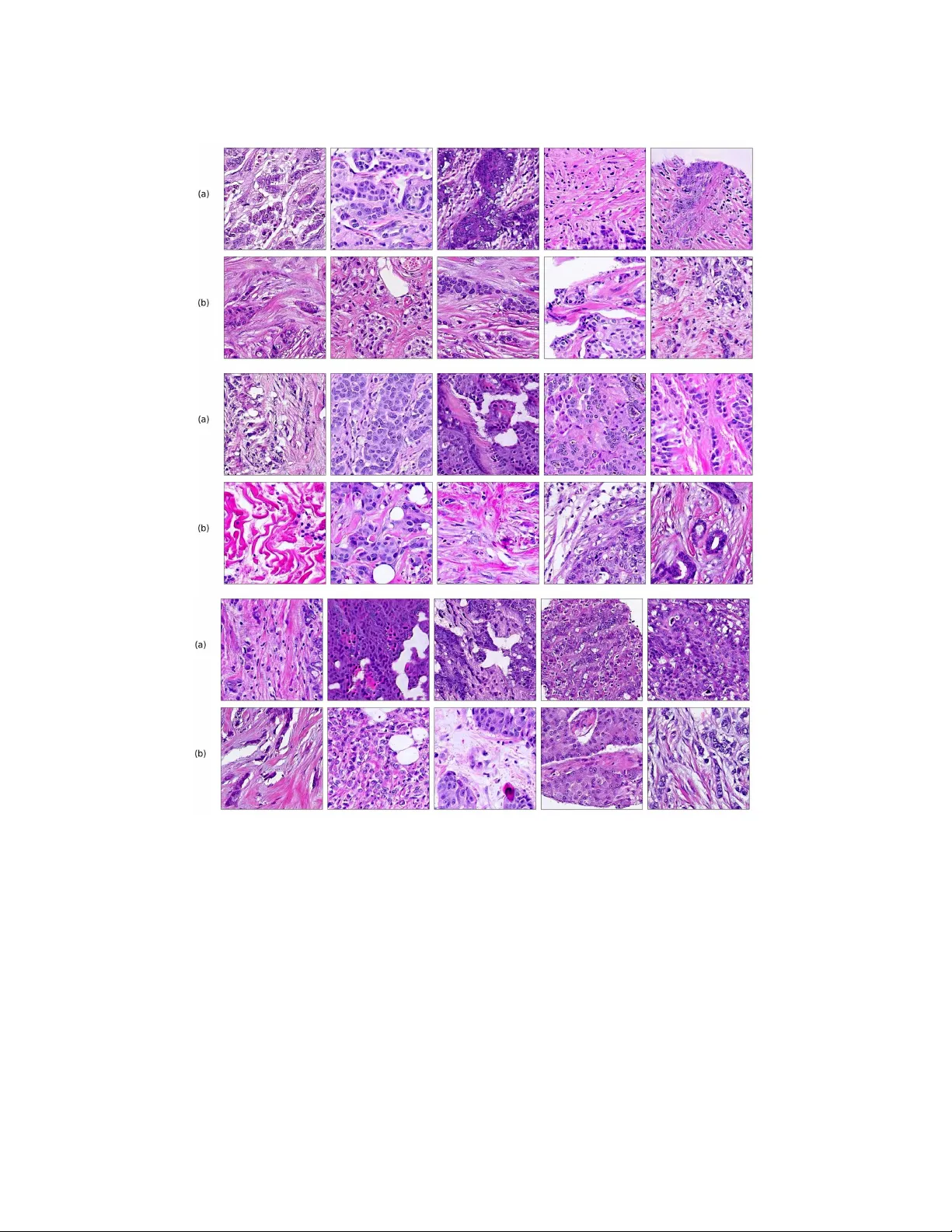

① **이미지 품질**: Fréchet Inception Distance(FID)를 사용해 10 K 생성 이미지와 10 K 실제 이미지를 비교했다. 유방암에서 16.65, 대장암에서 32.05라는 점수를 얻어, 기존 디지털 병리학 GAN 대비 우수한 품질을 입증했다.

② **조직학적 의미**: CellProfiler를 이용해 각 패치에서 암세포, 림프구, 기질세포 수·밀도를 정량화하고, 이를 Inception‑V1 특징에 결합해 FID를 재계산했다. 결과는 9.86으로, 생성 이미지가 실제 조직의 세포 구성을 정량적으로도 잘 재현함을 보여준다.

③ **잠재 공간 해석**: “암세포 밀도 증가” 벡터, “림프구 비율 증가” 벡터 등을 잠재 벡터에 선형적으로 더했을 때, 생성 이미지에서 해당 조직 특성이 눈에 띄게 변한다. 이는 잠재 공간이 의미론적으로 정렬되어 있음을 의미한다.

④ **전문가 평가**: 두 명의 병리학자가 블라인드 방식으로 200여 장의 실제·생성 이미지를 평가했으며, 통계적으로 유의미한 차이를 보이지 않았다. 이는 PathologyGAN이 임상 수준의 시각적 신뢰성을 확보했음을 의미한다.

**추가 실험**

Appendix B에서는 5 K, 10 K, 20 K 규모의 소규모 데이터셋에서도 모델이 수렴하고 의미 있는 잠재 표현을 학습함을 확인했다. Appendix C에서는 hinge loss 기반 모델이 조직 구조를 제대로 재현하지 못함을 시각적으로 제시했다.

**공헌 및 향후 방향**

1. BigGAN에 StyleGAN‑2 요소와 RAD를 결합해 조직 이미지에 특화된 고품질 GAN을 구현.

2. FID와 세포 정량화 지표를 동시에 사용해 이미지 품질과 조직학적 의미를 정량화.

3. 의미론적 잠재 공간을 구축해 벡터 연산으로 조직 특성 변환이 가능하도록 함.

4. 코드·사전 학습 모델을 공개해 재현성을 보장하고, 다중 암종·다중 모달 데이터와의 통합 연구 기반을 제공.

향후 연구에서는 (i) 조직 라벨이 없는 대규모 WSI 전체에 대한 학습, (ii) 면역조직화학·공간 전사체와 같은 멀티모달 데이터와의 연계, (iii) 생성된 이미지 기반 데이터 증강을 통한 지도 학습 모델 성능 향상 등을 탐색할 수 있다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기