연속시간·연속공간 강화학습을 위한 차분·적분 정책반복 이론과 구현

초록

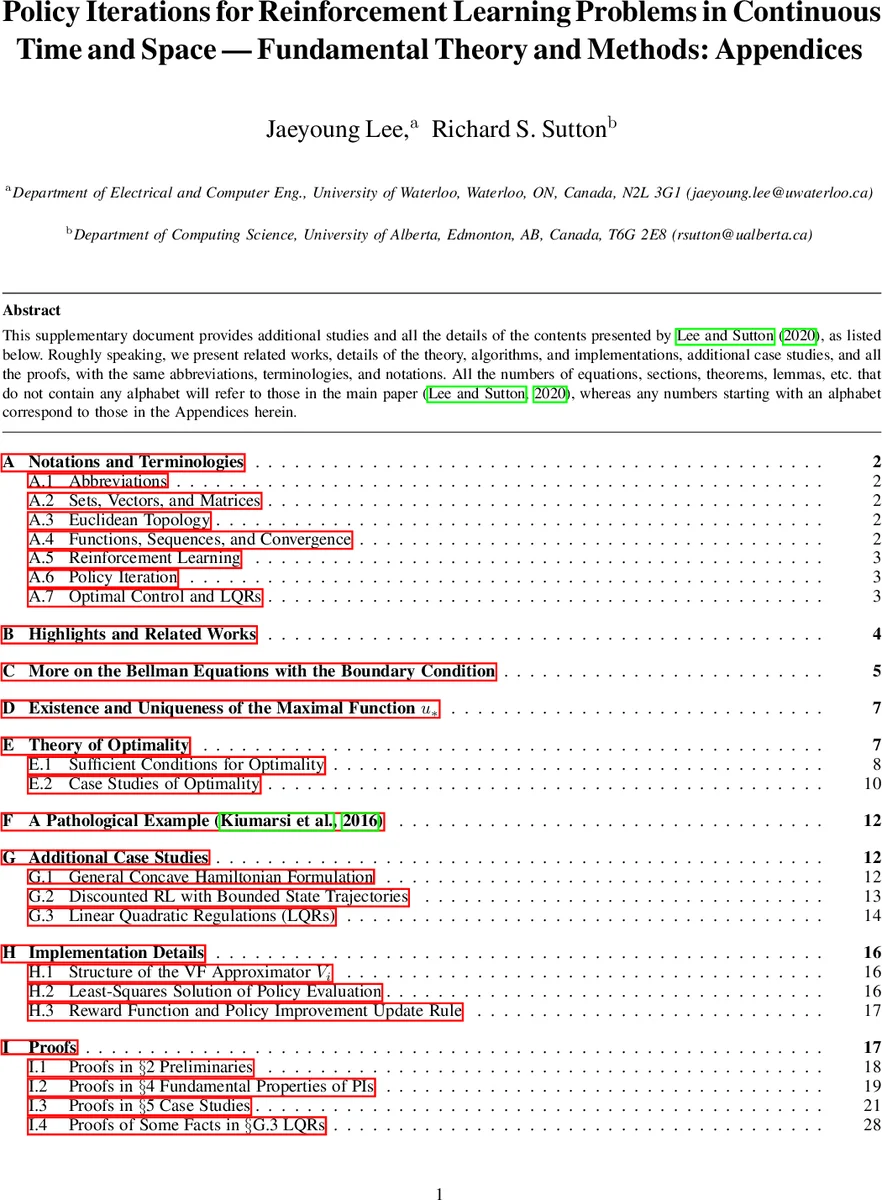

본 논문은 연속시간·연속공간(CTS) 환경을 ODE로 모델링한 강화학습 문제에 대해 두 가지 정책반복(PI) 알고리즘, 차분 정책반복(DPI)과 적분 정책반복(IPI)을 제안한다. 기존 최적제어의 안정성 기반 PI와 달리 초기 정책의 안정성을 요구하지 않으며, 할인계수 γ∈(0,1]에 대한 제한도 없도록 일반적인 가정을 설정한다. 제안 방법은 베벨 방정식 해의 유일성, 정책의 단조 개선, 수렴성, 해밀턴‑자코비‑벨만 방정식(HJBE) 최적성 등을 엄밀히 증명한다. 이론적 결과를 바탕으로 할인형 강화학습과 비선형 최적제어 사례를 분석하고, 역진자 시뮬레이션을 통해 모델 기반·부분 모델프리 구현을 검증한다.

상세 분석

이 논문은 연속시간·연속공간(RL) 문제를 ODE 형태로 정의하고, 기존 MDP 기반 PI가 갖는 이산시간·이산공간 한계를 극복하고자 한다. 핵심 아이디어는 두 가지 정책반복 스킴을 도입하는데, 차분 정책반복(DPI)은 전통적인 미분형 베벨 방정식(동적 프로그래밍의 연속형 버전)을 직접 풀어 현재 정책에 대한 가치함수를 얻고, 이를 이용해 정책을 개선한다. 반면 적분 정책반복(IPI)은 시스템 동역학의 일부만 알면 충분히 수행할 수 있는 부분 모델프리 방식으로, 베벨 방정식을 적분 형태(시간 차분, 즉 TD‑like)로 변환하여 샘플 경로를 통해 가치함수를 추정한다. 이 두 방법은 모두 정책 평가와 정책 개선을 번갈아 수행하지만, IPI는 초기 안정 정책이 필요 없다는 점에서 기존 안정성 기반 PI와 근본적으로 차별화된다.

이론적 기여는 다음과 같다. 첫째, 정책이 admissible(가치함수가 모든 상태에서 유한)하다는 정의를 도입하고, admissible 정책 집합 Πₐ가 비공집합임을 보인다. 둘째, 베벨 방정식의 해가 존재하고 유일함을 증명하는데, 여기서는 연속성·미분가능성만을 가정하고 할인계수 γ에 대한 별도 제한을 두지 않는다. 셋째, 정책 개선 단계에서 얻어지는 새로운 정책 π′가 기존 정책 π보다 가치함수가 항상 크거나 같음(단조 개선)을 보이며, 이를 통해 가치함수 열 {v_{π_k}}가 단조 증가하고 상한에 수렴함을 보인다. 넷째, 수렴한 정책이 HJBE의 최적해와 일치함을 증명함으로써, 제안된 PI가 최적 제어 해를 찾는 알고리즘임을 확립한다.

또한, 논문은 네 가지 구체적 사례를 통해 이론을 검증한다. (1) Hamiltonian이 볼록한 경우, (2) 할인형 RL에서 보상 함수가 유계인 경우, (3) 로컬 Lipschitz 연속성을 만족하는 비선형 시스템, (4) 전통적인 비선형 최적제어 문제. 각 경우에 대해 기존 문헌의 가정보다 약화된 전제조건을 사용하면서도 동일하거나 더 강한 수렴·안정성을 확보한다.

시뮬레이션에서는 역진자 시스템을 대상으로 DPI와 IPI를 구현하고, 완전 모델 기반 버전과 부분 모델프리 버전을 비교한다. 결과는 초기 정책이 비안정적이더라도 두 알고리즘이 성공적으로 최적 정책에 수렴함을 보여준다. 특히 IPI는 시스템 동역학의 입력‑결합 항만 알면 충분히 동작하므로, 실제 로봇이나 물리 시스템에 적용하기에 실용적이다. 전체적으로 이 논문은 연속시간·연속공간 강화학습에 대한 근본적인 정책반복 이론을 확립하고, 기존 최적제어와 현대 RL 기법을 통합하는 중요한 다리 역할을 수행한다.

댓글 및 학술 토론

Loading comments...

의견 남기기