Adam 최적화의 따뜻한 시작: 무조정 워밍업이 충분히 효과적이다

본 논문은 Adam 계열 적응형 옵티마이저에서 학습률 워밍업이 왜 필요한지를 업데이트 크기의 초기 폭에 초점을 맞춰 재해석한다. 기존 RAdam이 제시한 “분산 보정” 설명을 반박하고, 단순 선형 워밍업을 무조정으로 적용해도 RAdam과 거의 동일한 성능을 얻을 수 있음을 실험적으로 입증한다. 저자는 β₂에 기반한 2 / (1‑β₂) iteration 정도의 선형 워밍업을 기본값으로 제안한다.

저자: Jerry Ma, Denis Yarats

본 연구는 최근 인공신경망 학습에서 널리 사용되는 적응형 옵티마이저인 Adam의 초기 학습 안정성을 보장하기 위해 흔히 적용되는 워밍업 스케줄에 대한 재검토를 목표로 한다. 기존 연구(Liu et al., 2020)는 Adam의 학습률 워밍업이 필요하다는 근거로 “분산이 발산하는” 적응 학습률 q = (1‑βₜ₂) vₜ의 변동성을 제시하고, 이를 자동으로 보정하는 RAdam을 제안하였다. 그러나 저자들은 RAdam이 실제로는 4번의 Heavy‑Ball Momentum(Polyak 1964) 후에 고정된 워밍업을 적용한 Adam에 불과하다는 사실을 수학적으로 증명한다. ρₜ ≤ 4 조건이 β₂ ≥ 0.8인 실무 환경에서는 단순히 t ≤ 4와 동치이며, 따라서 RAdam의 “분산‑발산 단계”는 초기 4스텝에만 존재한다.

그 다음, 기존의 분산 기반 설명이 Adam 업데이트의 실제 동작을 제대로 설명하지 못한다는 점을 강조한다. Adam의 1차 모멘트 mₜ와 2차 모멘트 vₜ는 높은 상관관계를 보이며, 초기 단계에서는 |mₜ| ≈ √vₜ가 되므로 업데이트는 α·sign(mₜ) 형태로 거의 일정한 크기를 가진다. 즉, q의 분산이 크더라도 업데이트 크기의 분산은 거의 0에 가깝다. 이는 “적응 학습률의 분산이 크다”는 현상이 실제로는 업데이트 크기의 변동성을 억제한다는 역설적인 상황을 만든다.

이러한 통찰을 바탕으로 저자들은 업데이트 크기 자체를 직접 분석한다. 가상의 로컬 최소점에서 i.i.d. N(0,10⁻⁹) 그라디언트를 가정한 시뮬레이션을 수행했을 때, Adam의 업데이트 크기는 초기 1·α에서 시작해 약 40 iteration 후에야 0.16·α 수준으로 감소한다. 이는 SGD와 달리 Adam이 초기 단계에서 반드시 큰 스텝을 수행하게 됨을 의미한다. 실제 EMNIST 실험에서도 비슷한 패턴이 관찰되었으며, 무작위 초기화 시에는 수백 스텝에 걸쳐 큰 업데이트가 지속된다. 따라서 워밍업은 “학습률을 서서히 올려 초기 큰 업데이트를 완화”하는 역할을 수행한다는 것이 핵심 논점이다.

실용적인 관점에서 저자들은 β₂에 기반한 워밍업 기간 T = 2 / (1‑β₂) iteration을 제안한다. β₂ = 0.999이면 약 2000 iteration, β₂ = 0.9이면 약 20 iteration에 해당한다. 이 값은 RAdam이 내부적으로 사용하는 워밍업 팩터와 거의 일치한다. 또한, “지수 워밍업” ωₜ = 1 − exp(−(1‑β₂)·t)와 같은 간단한 스케줄도 제시한다.

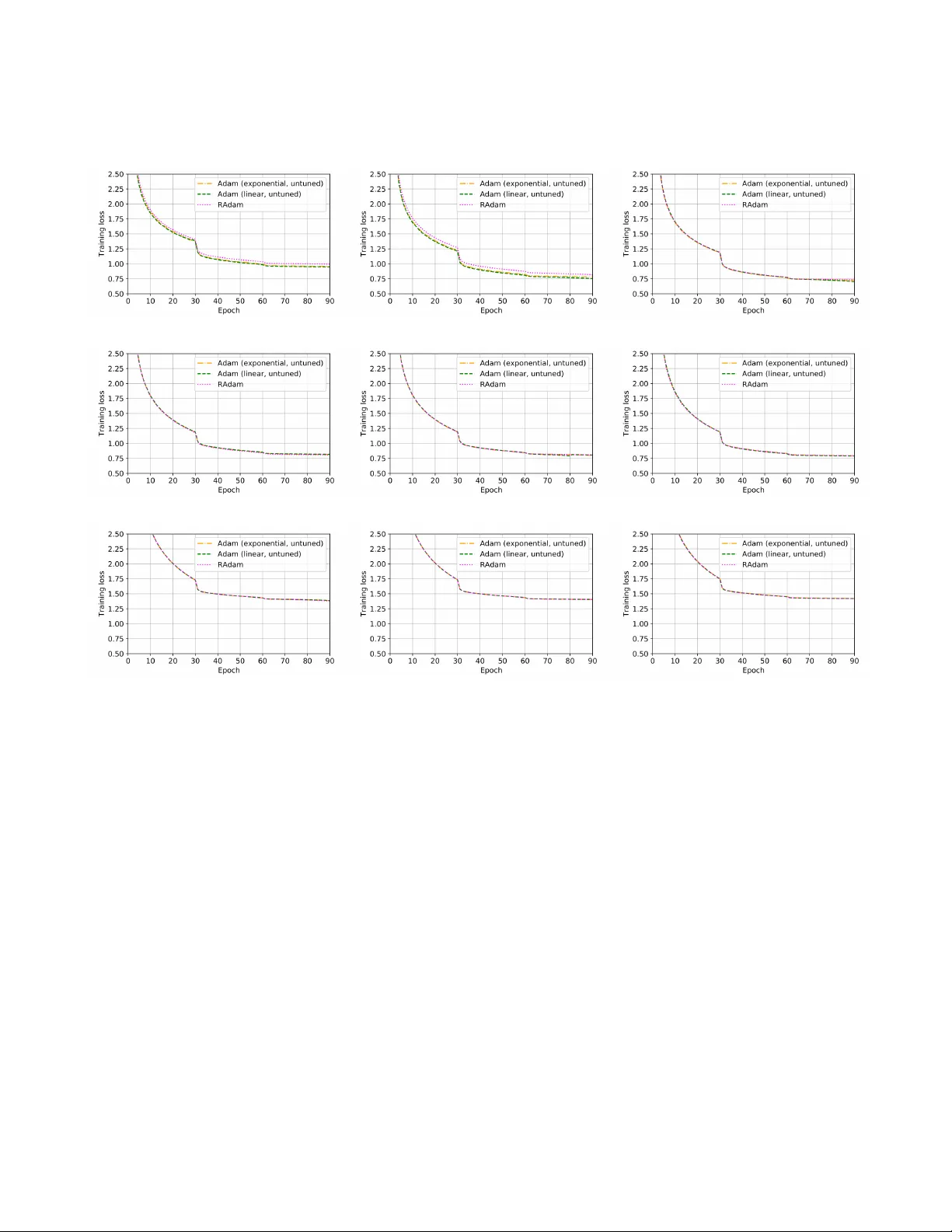

다양한 모델(Transformer, ResNet‑50, BERT‑large 등)과 데이터셋(WMT, ImageNet, GLUE)에서 광범위한 실험을 수행했으며, 제안된 무조정 선형 워밍업(또는 지수 워밍업)과 RAdam은 거의 동일한 학습 곡선, 최종 정확도, 그리고 수렴 속도를 보였다. 특히, 하이퍼파라미터 탐색 비용이 크게 감소하고, 구현 복잡성이 낮아진다.

결론적으로, 논문은 (1) RAdam이 본질적으로 고정된 워밍업을 적용한 Adam이며, (2) 워밍업의 진정한 필요성은 업데이트 크기의 초기 폭을 제어하는 데 있음을 입증한다. 따라서 복잡한 자동 보정 메커니즘 대신 간단한 선형(또는 지수) 워밍업을 무조정으로 사용해도 충분히 안정적이고 효율적인 학습이 가능함을 실증한다. 실무자들은 β₂에 따라 2 / (1‑β₂) iteration 정도의 선형 워밍업을 기본값으로 채택하면 별도의 튜닝 없이도 대부분의 최신 딥러닝 작업에서 좋은 성능을 얻을 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기