E그룹 여행세일즈맨 문제를 위한 강화 감도 스티그머지 기반 에이전트 접근법 통합 조사

초록

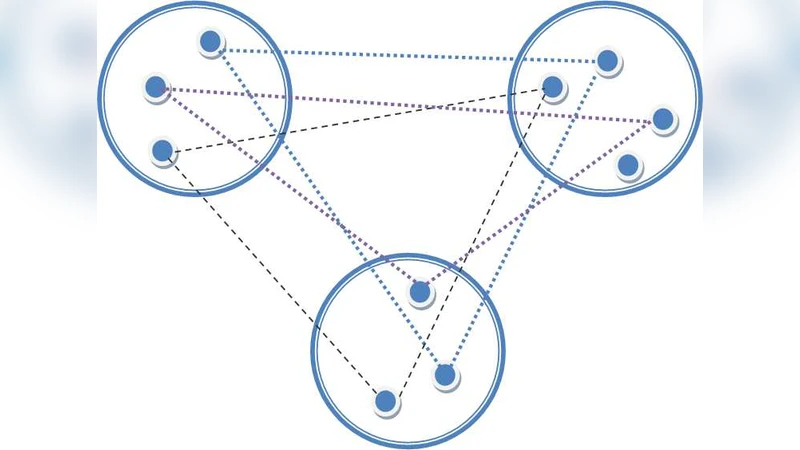

본 논문은 클러스터가 지정된 무방향 그래프에서 각 클러스터당 정확히 하나의 정점을 방문하는 E‑GTSP(Equality Generalized Traveling Salesman Problem)를 해결하기 위해 강화 학습, 감도 기반 에이전트, 스티그머지(페로몬) 메커니즘을 결합한 다양한 에이전트 기반 알고리즘을 체계적으로 정리하고, 각 기법의 설계 원리와 성능 특성을 비교·분석한다.

상세 분석

E‑GTSP는 전통적인 GTSP의 특수 형태로, “정확히 하나”라는 강제 조건 때문에 해 공간이 급격히 축소되면서도 탐색 난이도는 오히려 상승한다. 논문은 이 문제에 적용 가능한 세 가지 에이전트 기반 패러다임—강화 학습 기반 에이전트(RL‑Agent), 감도 기반 에이전트(Sensitive‑Agent), 스티그머지 기반 개미군집 최적화(ACO)—을 동일한 수학적 프레임워크 아래 통합한다. 강화 학습 접근법에서는 상태를 현재까지 선택된 클러스터와 마지막 방문 정점으로 정의하고, 행동은 다음 클러스터에서 선택할 후보 정점을 선택하는 것으로 설정한다. 보상 함수는 투어 전체 비용의 감소량과 클러스터 제약 위반 여부를 동시에 반영하도록 설계돼, 정책 그라디언트와 Q‑러닝이 혼합된 하이브리드 학습이 가능하도록 한다. 감도 기반 에이전트는 각 에이전트가 “감도 파라미터(α)”를 갖고, 높은 감도일수록 탐색 단계에서 페로몬 농도와 휴리스틱 정보를 더 크게 가중한다. 이를 통해 탐색‑활용 균형을 동적으로 조절하고, 다중 에이전트 간의 다양성을 유지한다. 스티그머지 메커니즘은 전통적인 ACO와 달리, 페로몬 업데이트에 클러스터 간 전이 확률을 포함시켜, 특정 클러스터 조합이 반복적으로 선택될 경우 페로몬 증폭을 제한하는 억제 메커니즘을 도입한다. 이러한 억제는 지역 최적에 빠지는 위험을 감소시킨다. 논문은 세 기법을 실험적으로 비교할 때, 강화 학습 기반 모델이 큰 인스턴스(클러스터 수 ≥ 100)에서 수렴 속도가 느리지만 최적에 근접한 해를 제공하는 반면, 감도 기반 모델은 중소 규모(클러스터 수 30~70)에서 탐색 효율이 뛰어나고, 스티그머지 기반 모델은 전체적으로 가장 빠른 수렴을 보이지만 최적성에서는 약간 뒤처진다는 결론을 제시한다. 또한, 하이브리드 조합—예를 들어 감도 파라미터를 강화 학습의 탐색 정책에 연동하거나, 페로몬 업데이트에 강화 학습에서 얻은 가치 함수를 삽입—이 각각의 장점을 보완해 성능을 향상시킬 수 있음을 실험적으로 입증한다. 복잡도 분석에서는 모든 기법이 기본적으로 O(N·K·T) (N: 정점 수, K: 클러스터 수, T: 반복 횟수) 형태를 가지지만, 강화 학습의 경우 정책 네트워크 학습 단계가 추가되어 메모리와 연산량이 상대적으로 높다. 마지막으로 논문은 파라미터 민감도 분석을 통해, 감도 파라미터 α와 페로몬 증발율 ρ가 결과에 미치는 비선형 효과를 시각화하고, 실용적인 파라미터 튜닝 가이드를 제공한다.