다중에이전트 그룹 인식 및 상호작용 모델 MGpi

초록

MGpi는 사회적 신호(시선, 위치, 몸짓 등)를 기반으로 다중 에이전트·다중 그룹 상황에서 적절한 대화 행동을 예측하는 딥러닝 네트워크이다. 핵심인 KPM 게이트는 키네시스와 프로섹스 정보를 이용해 사회적 신호를 선택적으로 가중치 부여하고, 이를 풀링해 그룹 식별까지 수행한다. 모방학습을 통해 시뮬레이터 데이터로 학습되며, 명시적 그룹 라벨 없이도 최첨단 그룹 식별 성능을 보인다.

상세 분석

본 논문은 인간‑로봇 상호작용에서 요구되는 ‘사회적 지각’과 ‘사회적 행동 관리’를 하나의 통합 모델로 구현하려는 시도를 제시한다. MGpi는 크게 세 부분으로 구성된다. 첫 번째는 Social Signal Gating Module(SGM)로, 주변 에이전트들의 비언어적 신호(시선·위치)와 언어적 행동(발화·청취 등)을 각각 비언어 인코더(N)와 대화 인코더(C)인 GRU 기반 서브모듈에 입력한다. 두 인코더는 각각 64차원 임베딩을 출력하고, 이들 임베딩은 Kinesic‑Proxemic‑Message(KPM) 게이트를 통해 가중치가 부여된다. KPM 게이트는 키네시스(몸짓)와 프로섹스(거리·위치) 정보를 결합해 ‘사회적 중요도’를 학습한다. 여기서 중요한 점은 전통적인 하드코딩된 F‑formation이나 거리 임계값 대신, 데이터‑드리븐 방식으로 신호의 중요도를 자동 추정한다는 것이다.

두 번째는 Short‑Term Memory(STM) 인코더이다. Social‑STM은 각 이웃과의 과거 상호작용을 기억하고, Self‑STM은 자신의 행동 이력을 기억한다. 두 STM 모두 시간축을 따라 GRU로 인코딩되며, 이는 에이전트가 과거 대화 흐름과 비언어적 피드백을 기반으로 현재 행동을 선택하도록 돕는다.

세 번째는 Interaction Policy 모듈이다. Social‑STM, Self‑STM, 그리고 KPM‑가중치된 이웃 메시지를 결합해 다중 클래스 확률분포를 출력한다. 정책은 모방학습(imitation learning) 방식으로 학습되며, 시뮬레이터가 제공하는 ‘전문가’ 행동 시퀀스를 그대로 복제한다.

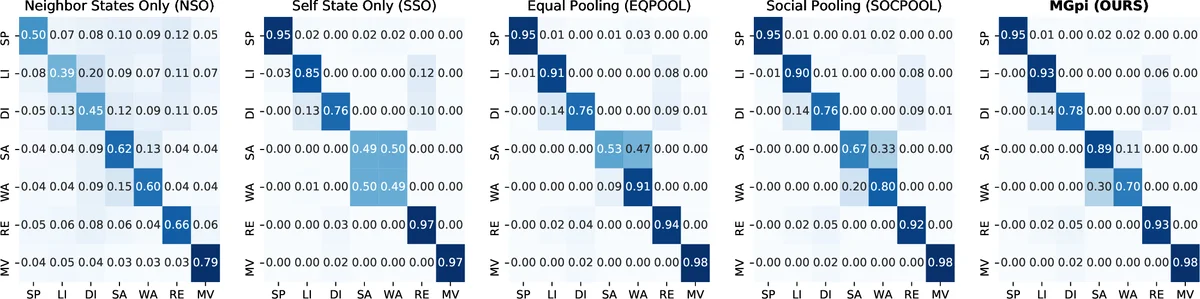

핵심 실험은 두 가지로 나뉜다. 첫째, MGpi가 실제 대화 상황에서 speak, listen, respond, leave 등 4가지 행동을 얼마나 정확히 예측하는가를 평가한다. 결과는 기존 다중 에이전트 커뮤니케이션 모델보다 높은 정확도와 빠른 수렴 속도를 보였다. 둘째, KPM 게이트를 이용한 그룹 식별 성능을 검증한다. 그룹 라벨이 학습에 사용되지 않았음에도 불구하고, KPM이 생성한 attention 맵을 클러스터링하면 F‑formation 기반 방법들보다 높은 정밀도·재현율을 달성한다. 이는 사회적 신호 가중치가 자연스럽게 그룹 경계를 드러낸다는 중요한 통찰을 제공한다.

또한 논문은 기존 데이터 부족 문제를 해결하기 위해 자체 시뮬레이터를 구축했다. 시뮬레이터는 인간 대화 연구에서 제시된 비언어·언어 상호작용 규칙을 구현하고, 다양한 그룹 크기·구성 변화를 자동 생성한다. 이러한 합성 데이터는 MGpi 학습에 충분히 활용될 수 있음을 실증한다.

전체적으로 MGpi는 (1) 비언어·언어 신호를 통합한 다중 모달 인코딩, (2) 데이터‑드리븐 사회적 신호 가중치(KPM), (3) 동적 이웃 수용을 위한 풀링 메커니즘, (4) 짧은 기억을 활용한 행동 예측이라는 네 가지 핵심 요소를 결합함으로써, 로봇이 복잡한 사회적 환경에서 인간과 자연스럽게 협업할 수 있는 기반을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기