음성에서 의미까지 엔드투엔드 SLU 접근법

본 논문은 오디오 입력을 직접 의미(도메인, 인텐트, 슬롯)로 변환하는 엔드투엔드 시퀀스‑투‑시퀀스 모델들을 제안하고 비교한다. 중간 텍스트 표현을 유지하는 것이 슬롯 정확도에 크게 기여함을 확인했으며, ASR과 NLU를 공동 최적화하면 전체 시스템 성능이 향상된다. 최종 모델은 독립적으로 학습한 기존 시스템과 도메인·인텐트 F1은 동등하지만 슬롯 오류율을 18 % 상대적으로 감소시킨다.

저자: Parisa Haghani, Arun Narayanan, Michiel Bacchiani

본 논문은 음성 기반 인간‑컴퓨터 인터페이스에서 핵심 역할을 하는 SLU(Spoken Language Understanding) 시스템을 재설계한다. 기존 시스템은 자동 음성 인식(ASR)과 자연어 이해(NLU)를 별도 모듈로 구성하고 각각 독립적으로 최적화한다. 그러나 ASR 오류가 NLU 성능을 크게 저하시킬 수 있다는 한계가 있다. 이를 극복하고자 저자는 오디오 → 의미라는 단일 시퀀스‑투‑시퀀스 문제를 정의하고, 다양한 엔코더‑디코더 기반 아키텍처를 제안한다.

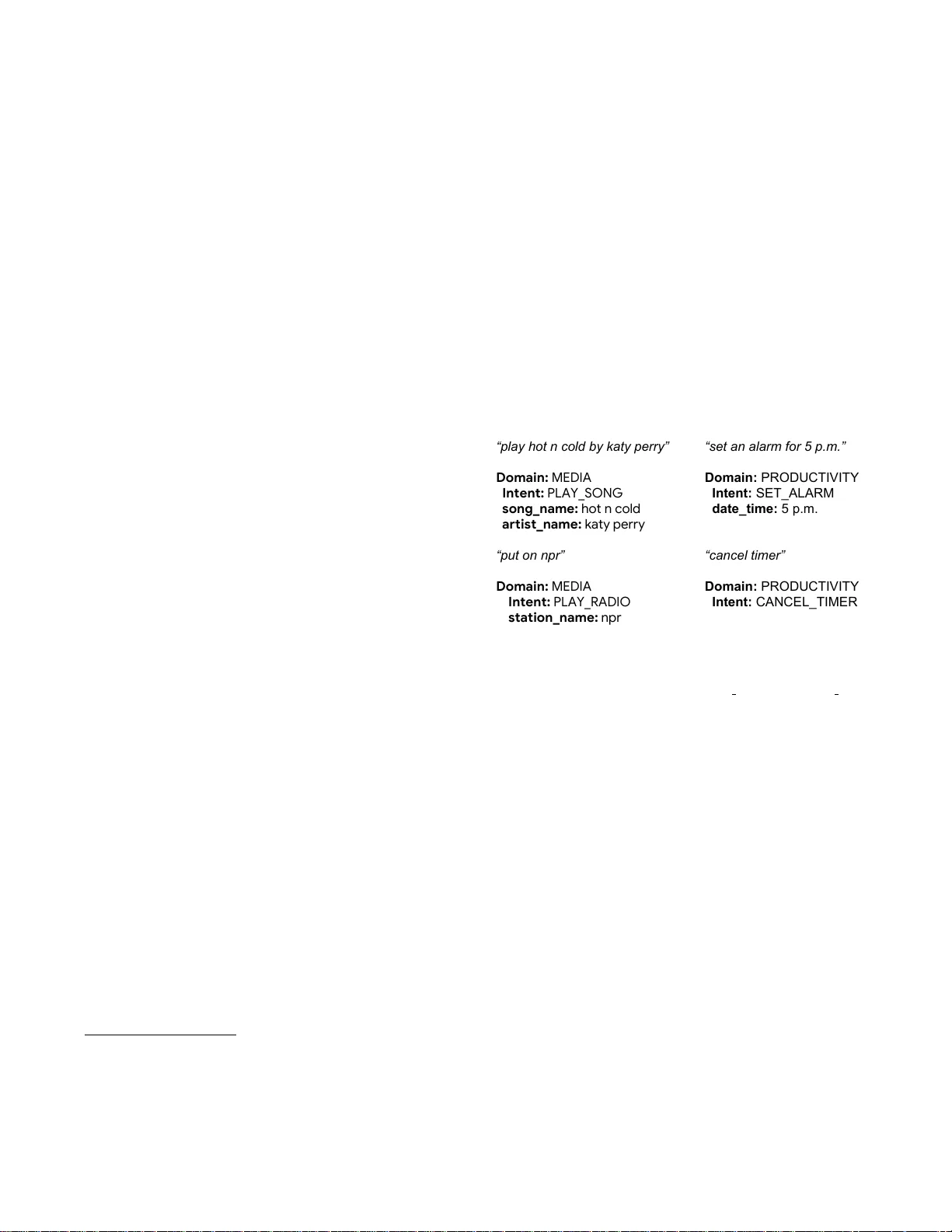

먼저, 입력은 로그 멜 스펙트로그램 등 전통적인 음성 특징을 사용한다. 출력은 의미 시퀀스로, 도메인, 인텐트, 슬롯 라벨 및 슬롯 값이 순차적으로 직렬화된 형태다. 직렬화 규칙은 , , 태그를 이용해 인간이 읽기 쉬운 형태로 만든다. 이렇게 하면 디코더가 텍스트와 의미를 동일한 어휘 집합에서 생성할 수 있다.

제안된 네 가지 모델은 다음과 같다.

1. **Direct Model** – 오디오만을 입력으로 받아 바로 의미 시퀀스를 생성한다. 텍스트 정보를 전혀 학습하지 않으므로, 의미를 추출하기 위해 음성 신호에서 직접 슬롯 값을 인식해야 하는 어려움이 있다. 실험 결과, 슬롯 정확도가 가장 낮았다.

2. **Joint Model** – 디코더가 먼저 텍스트 전사(W)를 생성하고, 이어서 의미 시퀀스(S)를 출력한다. 즉, 출력이

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기