연속 제어를 위한 증강 리플레이 메모리

본 논문은 인간의 활성 기억 통합(Active Memory Consolidation) 메커니즘을 모방하여, 경험 재생 시 각 전이의 보상을 동적으로 조정하는 증강 리플레이 메모리(AMR) 기법을 제안한다. AMR은 작은 인공신경망으로 TD‑오차, 즉시 보상, 상태·다음 상태의 엔트로피 등 네 가지 특징을 입력받아 보상 증강값을 출력하고, 이를 유전 알고리즘으로 최적화한다. DDPG 기반 연속 제어 환경(OpenAI Gym의 Reacher‑v2,…

저자: Mirza Ramicic, Andrea Bonarini

1. 서론

- 강화학습 에이전트는 경험 재생 메모리를 이용해 과거 전이를 무작위로 샘플링해 학습한다. 하지만 데이터 양이 증가하면 중복·충돌 데이터로 인한 망각(Forgetfulness) 문제가 발생한다. 인간 두뇌에서는 새로운 기억이 장기 저장소에 통합되기 전에 활성 기억 통합(Active Memory Consolidation, AMC) 과정을 거쳐 중요한 기억을 강화하고 불필요한 기억은 소멸시킨다.

- 논문은 이 생물학적 메커니즘을 모방해, 경험 재생 시 각 전이의 보상을 동적으로 조정하는 “증강 리플레이 메모리(AMR)”를 제안한다.

2. 관련 연구

- DDPG, Prioritized Experience Replay, Dual‑Critic, 메타‑러닝 기반 보상 설계 등 다양한 연속 제어 강화학습 기법을 소개하고, 이들 대부분이 정적 혹은 사전 정의된 샘플링/보상 방식을 사용한다는 점을 지적한다.

- 기존 연구와 달리 AMR은 학습 과정 중에 보상 자체를 변형함으로써, 경험의 “중요도”를 실시간으로 재조정한다.

3. 이론적 배경

- TD‑learning, 연속 액션 공간에서의 DDPG(Deterministic Policy Gradient)와 Bellman 방정식 등을 정리한다.

- TD‑error와 상태 엔트로피를 경험의 불확실성·탐색 가치 지표로 활용한다는 가정을 제시한다.

4. 모델 구조 및 학습 알고리즘

- 전체 시스템은 두 부분으로 나뉜다: (1) 평가 단계 – DDPG 기반 TD‑learning에서 AMR 블록이 보상을 수정한다. (2) 진화 단계 – 유전 알고리즘(GA)이 AMR 블록을 구성하는 ANN의 파라미터를 최적화한다.

- AMR ANN 구조: 입력 4(절대 TD‑error, 즉시 보상, 현재 상태 엔트로피, 다음 상태 엔트로피) → 은닉 4 → 출력 1(증강값 Aₜ).

- 보상 수정 식: rₜ←rₜ+β·Aₜ (β는 고정 스칼라).

- GA는 개체군을 초기화하고, 각 개체를 사용해 일정 에피소드 동안 학습시킨 뒤 누적 보상을 적합도로 평가한다. 선택·교차·돌연변이 과정을 통해 다음 세대의 ANN 파라미터를 생성한다.

5. 실험 설정

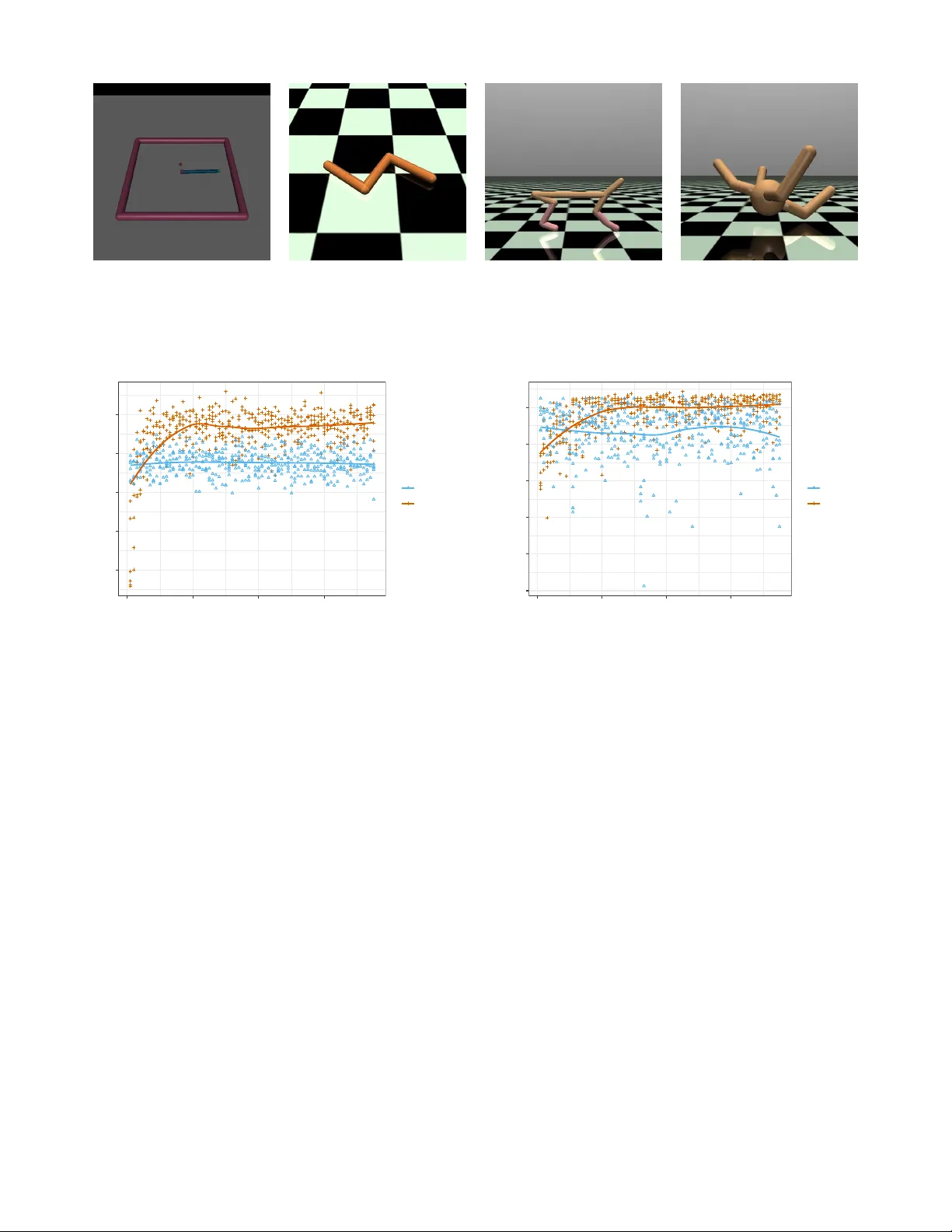

- 환경: OpenAI Gym 연속 제어 벤치마크 – Reacher‑v2(11‑dim state), HalfCheetah‑v2, Swimmer‑v2, Ant‑v2(111‑dim state, 8‑dim action).

- DDPG 기본 설정: replay buffer N, 미니배치 32, critic 학습률 0.002, actor 학습률 0.001, critic 은닉 50, actor 은닉 30.

- AMR ANN 학습률 및 GA 파라미터는 논문에 명시되지 않았으나, 일반적인 GA 설정(인구 20~30, 세대 50 등)을 사용한 것으로 추정된다.

- 비교 대상: 기존 DDPG(정적 리플레이), Prioritized Replay 등은 직접 비교하지 않고, 기본 DDPG와만 성능 차이를 보고한다.

6. 결과

- 모든 환경에서 AMR 적용 시 평균 누적 보상이 더 빠르게 상승하고, 학습 곡선의 변동성이 감소한다.

- 특히 고차원 Ant‑v2에서 수렴 속도가 약 30 % 가량 빨라졌으며, HalfCheetah‑v2와 Swimmer‑v2에서도 비슷한 수준의 개선이 관찰되었다.

- GA를 통해 진화된 AMR 함수는 TD‑error가 큰 전이와 엔트로피가 높은 전이를 강조하는 경향을 보였다(시각화 결과는 논문에 포함).

7. 논의 및 한계

- AMR은 경험의 “중요도”를 보상 수준으로 직접 변환함으로써, 기존의 Prioritized Replay이 샘플링 확률을 조정하는 방식과 차별화된다.

- 그러나 GA 기반 최적화는 추가적인 연산 비용을 요구한다. 단일 CPU 환경에서 실험했지만, 대규모 분산 학습과의 비교가 부족하다.

- 입력 특성이 제한적이며, β 값이 고정돼 있어 환경별 최적화가 필요할 가능성이 있다.

- 기존의 중요도 기반 샘플링 기법과의 정량적 비교가 없으며, 증강 ANN 구조가 너무 단순해 복잡한 상황에서의 일반화 능력이 의문이다.

8. 결론

- 인간의 활성 기억 통합 메커니즘을 모방한 AMR은 연속 제어 강화학습에서 학습 안정성과 수렴 속도를 향상시킬 수 있음을 실험적으로 입증했다.

- 향후 연구에서는 GA 비용 절감, 입력 피처 확장, β 자동 튜닝, 기존 Prioritized Replay과의 통합 등을 통해 실용성을 높일 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기