워밍 스타트가 딥러닝 일반화에 미치는 역설적 영향과 간단한 해결책

데이터가 순차적으로 추가되는 실제 환경에서, 이전 모델 파라미터를 이용해 학습을 시작하는 “워밍 스타트”는 학습 시간은 단축하지만 테스트 정확도가 떨어지는 현상이 반복된다. 논문은 이 현상을 다양한 아키텍처·옵티마이저·데이터셋에서 재현하고, 기존 정규화·학습률·배치 크기 조정 등 전통적 방법으로는 해결되지 않음을 보인다. 마지막으로, 첫 번째 학습 단계에서 파라미터를 약간 축소하고 작은 잡음을 추가하는 “Shrink‑and‑Perturb”(SP…

저자: Jordan T. Ash, Ryan P. Adams

**1. 연구 배경 및 동기**

현실 세계의 머신러닝 시스템은 데이터가 지속적으로 유입되는 환경에 놓여 있다. 금융 시계열, 온라인 광고, 소셜 미디어 이미지 등에서 매일 혹은 매시간 새로운 샘플이 추가되며, 모델은 최신 데이터를 반영하도록 주기적으로 업데이트되어야 한다. 전통적인 최적화 이론에서는 이전 최적해를 초기값으로 사용하면 수렴 속도가 빨라진다고 알려져 있다. 특히 선형·볼록 문제에서는 워밍 스타트가 널리 활용되고 있다. 그러나 딥러닝에서는 동일한 직관이 항상 성립하는지에 대한 실증적 검증이 부족했다.

**2. 워밍 스타트가 일반화에 미치는 현상 재현**

논문은 먼저 가장 기본적인 “두 단계 학습” 실험을 설계한다. CIFAR‑10, CIFAR‑100, SVHN 데이터셋을 50 %와 100 %로 나누어, 첫 번째 단계에서 절반 데이터를 사용해 모델을 완전히 수렴시킨 뒤, 두 번째 단계에서 전체 데이터를 사용해 추가 학습한다. 모델은 ResNet‑18, 3‑layer MLP, 로지스틱 회귀로 구성하고, 옵티마이저는 SGD와 Adam을 모두 적용한다. 결과는 다음과 같다.

- 훈련 손실은 두 단계 모두 거의 동일하게 수렴한다.

- 검증 정확도는 워밍 스타트 모델이 랜덤 초기화 모델보다 2 %~8 % 낮다.

- 비선형 모델(ResNet, MLP)에서 차이가 크게 나타나고, 선형 로지스틱 회귀에서는 차이가 미미하다.

**3. 온라인 학습 시나리오**

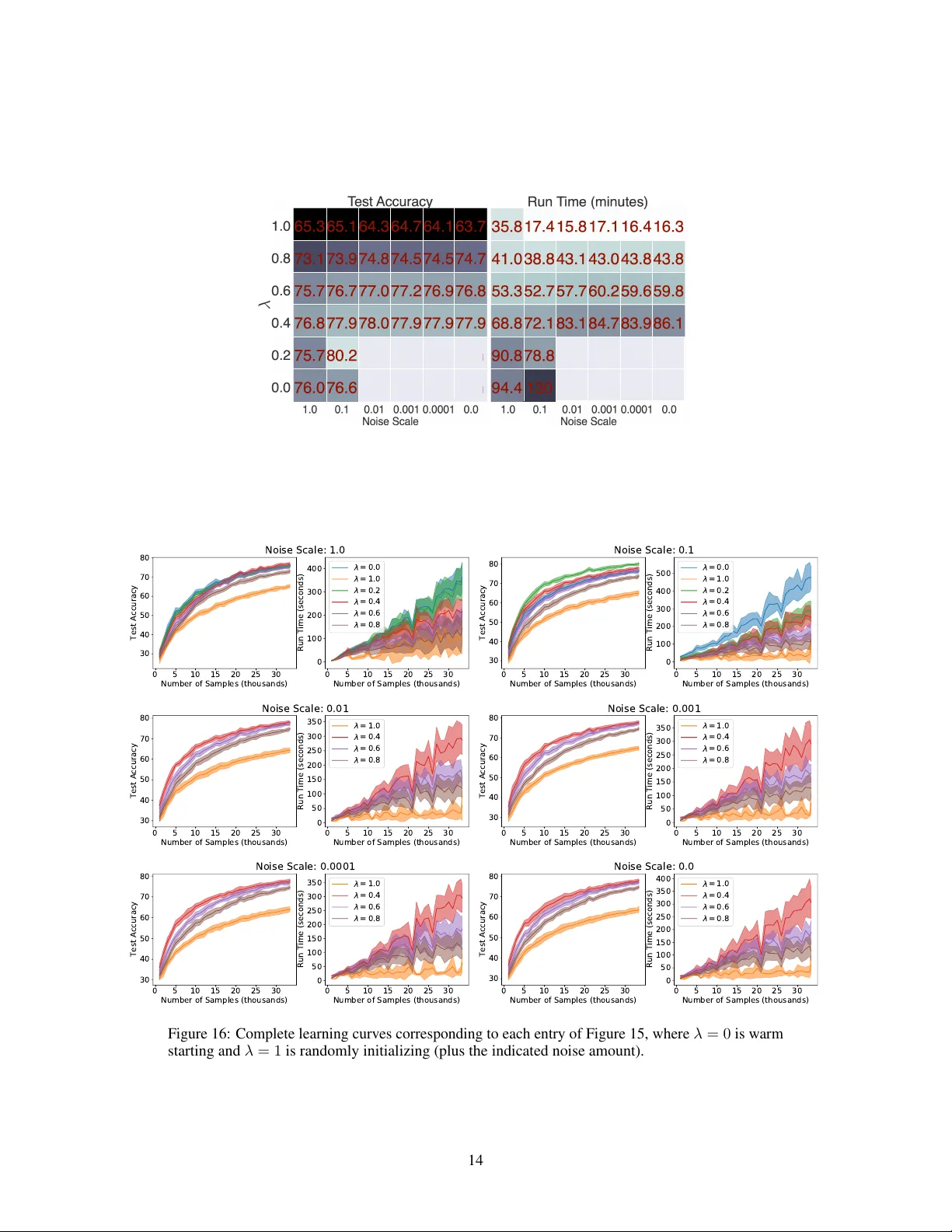

데이터가 스트림 형태로 제공되는 상황을 모사해, CIFAR‑10을 1 000 샘플씩 순차적으로 추가한다. 두 가지 전략을 비교한다. (1) 매 배치마다 모델을 처음부터 랜덤 초기화 후 전체 데이터를 학습, (2) 이전 단계의 파라미터를 그대로 사용해 이어 학습. 전략 (2)는 학습 시간에서 약 30 % 정도 절감되지만, 검증 정확도는 데이터가 누적될수록 점점 더 낮아진다. 이는 워밍 스타트가 “시간 효율성”을 제공하지만 “일반화 효율성”을 희생한다는 것을 의미한다.

**4. 기존 해결책 탐색**

다양한 하이퍼파라미터 조합을 실험한다. 배치 크기(16, 32, 64, 128), 학습률(0.001, 0.01, 0.1)을 첫 번째와 두 번째 단계 각각 다르게 설정하고, 총 3 × 4 × 4 = 48가지 조합을 평가한다. 결과는 다음과 같다.

- 일부 조합에서는 워밍 스타트 모델이 랜덤 초기화 모델과 동등한 검증 정확도를 보이지만, 그 경우 학습 시간도 거의 동일해 워밍 스타트의 시간 이점이 사라진다.

- 배치 정규화, L2 정규화, confidence‑penalty, 적대적 학습 등 일반적인 정규화 기법을 적용해도 일반화 격차는 크게 감소하지 않는다.

**5. 일반화 손상 메커니즘 분석**

워밍 스타트 모델의 파라미터와 최종 수렴 파라미터 사이의 코사인 유사도를 측정한 결과, 일반화가 좋은 모델일수록 초기 파라미터와의 상관관계가 낮았다. 이는 워밍 스타트가 첫 번째 단계에서 학습한 “정보”를 두 번째 단계에서 거의 잊어버리고, 새로운 데이터에만 집중하게 됨을 시사한다. 반면 로지스틱 회귀와 같이 손실 표면이 볼록한 경우에는 이런 현상이 거의 관찰되지 않는다.

**6. 제안된 해결책: Shrink‑and‑Perturb (SP) 트릭**

첫 번째 단계가 끝난 뒤, 모든 파라미터 θ를 λ·θ (0 < λ < 1) 로 축소하고, 정규분포 N(0, σ²)에서 추출한 작은 잡음 ε를 더한다: θ′ = λ·θ + ε. 이 변형된 파라미터를 두 번째 단계의 초기값으로 사용한다. 주요 특징은 다음과 같다.

- λ가 0.9~0.95 정도이면 기존 파라미터의 구조적 특성을 크게 보존한다.

- σ는 0.005~0.02 정도로 작게 잡아, 파라미터가 완전히 새롭게 초기화되는 것을 방지한다.

- 실험 결과, SP를 적용한 워밍 스타트 모델은 랜덤 초기화 모델과 동등하거나 약간 높은 검증 정확도를 달성하면서도, 전체 학습 시간은 여전히 20 %~30 % 정도 단축된다.

**7. 추가 실험 및 확장성**

- 다른 데이터셋(Imagenet‑subset, Tiny‑ImageNet)과 다른 아키텍처(VGG, DenseNet)에서도 동일한 현상이 재현되었으며, SP 트릭이 일관된 효과를 보였다.

- 사전 학습(pre‑training) 시나리오에서도, 대규모 데이터에 대해 부분 학습 후 전체 데이터에 적용할 때 SP를 사용하면 “전이 손실”이 크게 감소한다.

**8. 결론 및 시사점**

워밍 스타트는 딥러닝에서 일반화 성능을 저하시킬 위험이 있음을 실증적으로 입증하였다. 기존 하이퍼파라미터 튜닝만으로는 이 문제를 해결하기 어렵다. 제안된 Shrink‑and‑Perturb 기법은 구현이 간단하고 추가 연산 비용이 거의 없으며, 실제 서비스 환경에서 모델 업데이트 비용을 크게 절감할 수 있는 실용적인 해결책이다. 앞으로는 워밍 스타트와 일반화 사이의 이론적 연결 고리를 밝히는 연구와, 더 복잡한 온라인/활성 학습 파이프라인에 SP를 적용하는 실증 연구가 필요하다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기