프로그래머블 스펙트럼 카메라로 실시간 재료 분류

초록

본 논문은 하이퍼스펙트럴 이미지 전체를 획득하지 않고, 학습된 스펙트럼 필터 집합을 광학적으로 구현하는 프로그래머블 카메라를 제안한다. 이를 통해 필요한 선형 투영만을 실시간으로 측정함으로써 획득 속도를 크게 높이고, 넓은 대역폭 필터 사용으로 신호대잡음비를 개선한다. SVM 및 심층 신경망을 이용해 최적 필터를 학습하고, 시뮬레이션 및 실험 프로토타입을 통해 4 fps 수준의 영상 기반 픽셀별 재료 분류를 입증한다.

상세 분석

이 논문은 기존 하이퍼스펙트럴 이미지(HSI) 방식이 직면한 두 가지 근본적 한계—고차원 데이터 획득에 소요되는 시간과 각 스펙트럼 밴드에 분산되는 광량으로 인한 낮은 SNR—를 광학적 선형 투영으로 대체하는 혁신적 접근을 제시한다. 핵심 아이디어는 “프로그래머블 스펙트럼 필터”를 구현하는 카메라 아키텍처이다. 저자는 기존의 4f 시스템에 코딩된 개구(aperture)를 삽입하고, 무작위 또는 학습된 스펙트럼 프로파일을 LCoS(액정 온 실리콘) 디스플레이에 로드함으로써, 장면의 HSI를 직접 원하는 선형 조합으로 필터링한다. 이때 코딩된 개구는 공간‑스펙트럼 블러를 동시에 유도하지만, 역변환이 가능하도록 설계돼 복원 손실을 최소화한다.

학습 단계에서는 훈련 데이터셋(픽셀당 스펙트럼과 라벨)을 이용해 두 종류의 분류기를 학습한다. 첫 번째는 이진/다중 클래스 SVM으로, 각 클래스에 대한 초평면 가중치 w가 바로 광학적으로 구현될 필터가 된다. 두 번째는 5‑layer 전결합(fully‑connected) 딥 뉴럴 네트워크이며, 첫 번째 레이어의 가중치 행렬 A₁을 스펙트럼 필터 집합으로 해석한다. 여기서 중요한 점은 첫 레이어가 선형 투영만을 수행한다는 점이며, 이는 광학적으로 구현 가능하다는 점이다. 따라서 이후 비선형 활성화와 다중 레이어 연산은 전통적인 디지털 프로세서에서 수행한다.

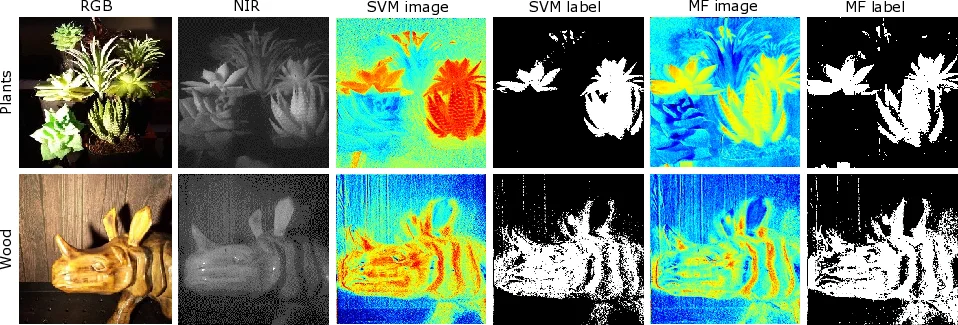

실험에서는 NASA Indian Pines 데이터셋(220 밴드)과 자체 제작한 실험용 프로토타입을 사용한다. 시뮬레이션 결과, 5‑class 분류에서 16개의 필터(즉, 16장의 이미지)만으로도 90 % 이상의 정확도를 달성했으며, 이는 전체 220 밴드를 모두 촬영하는 전통적 방법에 비해 측정 횟수를 14배 이상 감소시킨다. 실제 하드웨어에서는 4 fps 영상 스트림을 얻어, 플라스틱 식물과 실제 식물을 구분하는 실시간 데모를 구현했다. 또한, 필터가 넓은 스펙트럼 대역을 차지함에 따라 각 이미지당 광량이 증가해 SNR이 크게 향상된다.

기술적 한계로는 (1) 현재 구현된 시스템이 주로 1‑D 스펙트럼 투영에 국한되어 공간 정보를 활용하지 못한다는 점, (2) 코딩된 개구와 LCoS의 해상도·응답 속도가 전체 시스템 해상도와 프레임 레이트에 병목을 만든다는 점, (3) 혼합 픽셀(다중 물질 혼합) 상황에서 순수 픽셀 모델을 가정한 것이 실제 현장에서의 적용을 제한할 수 있다는 점을 들 수 있다. 향후 연구에서는 공간‑스펙트럼 결합 필터 설계, 더 빠른 고해상도 SLM 사용, 그리고 혼합 픽셀 모델을 위한 비선형 광학 연산을 탐구할 여지가 있다. 전반적으로 이 논문은 “광학적 선형 투영 = 하드웨어‑소프트웨어 공동 설계”라는 새로운 패러다임을 제시하며, 실시간 재료 인식, 농업 자동화, 의료 현장 등 다양한 분야에서 하이퍼스펙트럴 기술의 실용화를 가속화할 잠재력을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기