실시간 잡음 제거를 위한 AeGAN: 시간‑주파수 기반 GAN 혁신

본 논문은 2차원 시간‑주파수(log‑Mel) 스펙트로그램을 입력으로 하는 조건부 생성적 적대 신경망(AeGAN)을 제안한다. CasNet 기반의 다중 U‑블록 생성기와 패치 판별기를 사용하고, 픽셀‑단위 L1 손실 외에 판별기 특징을 이용한 퍼셉추얼 손실을 추가함으로써 저주파 잡음과 음성‑유사 잡음에서도 높은 품질의 복원을 달성한다. 동적 시간 해상도 기법으로 가변 길이 음성을 고정 크기 256×256 스펙트로그램에 매핑하고, LS‑ISTFT…

저자: Sherif Abdulatif, Karim Armanious, Karim Guirguis

본 논문은 자동 음성 인식(ASR) 시스템이 복잡한 실내·실외 환경에서도 안정적으로 동작하도록 돕는 전처리 기술인 음성 강화, 특히 잡음 제거(denoising) 문제를 다룬다. 기존의 전통적인 스펙트럼 서브트랙션, Wiener 필터, Bayesian 추정기 등은 사전 SNR 추정에 의존하고, 잡음이 음성 주파수 대역과 겹칠 때 성능이 급격히 저하되는 한계가 있다. 최근에는 딥러닝 기반 DAE, LSTM, WaveNet 등 데이터‑드리븐 접근법이 등장했지만, 이들 역시 손실 함수가 픽셀‑단위 L1 혹은 MSE에 머물러 음성의 세밀한 포네틱 구조를 손상시키는 경우가 많다.

이에 저자들은 2차원 로그‑멜 스펙트로그램을 입력으로 하는 조건부 GAN(Conditional GAN, cGAN) 구조를 설계한다. 핵심 아이디어는 (1) 생성기(generator)로서 CasNet을 채택해 세 개의 U‑블록을 연속적으로 쌓아 깊이 있는 피처 재구성을 가능하게 하고, (2) 판별기(discriminator)를 단순 이진 분류기가 아니라 다중 스케일 특징을 추출하는 네트워크로 활용해, 이 특징을 기반으로 한 퍼셉추얼 손실(L_percep)을 추가함으로써 전역적인 스펙트럼 형태를 보존한다는 점이다.

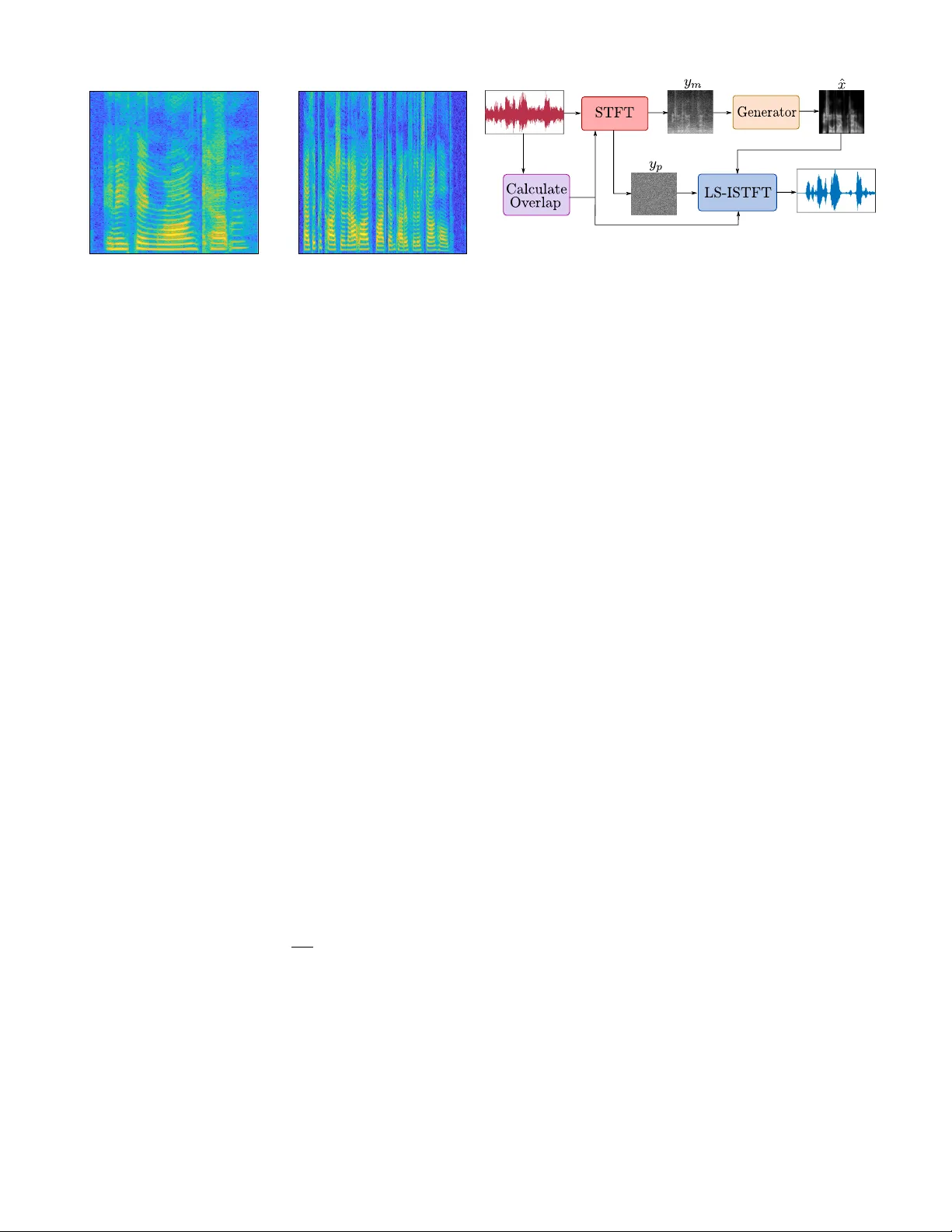

구체적인 아키텍처는 다음과 같다. 입력은 256 × 256 크기의 로그‑멜 스펙트로그램이며, 이는 동적 시간 해상도(dynamic timeresolution) 기법을 통해 가변 길이 음성(0.9 s~6.1 s)을 하나의 이미지에 매핑한다. STFT 단계에서 윈도우 길이 S=512, FFT 포인트 N_F=256을 고정하고, 오버랩 O를 O = S – (L/N_T)·N_T 로 계산해 시간 해상도를 자동 조정한다. 이렇게 얻은 magnitude y_m만을 네트워크에 입력하고, 복원된 magnitude ŷ와 원본 noisy phase y_p를 결합해 LS‑ISTFT(Least‑Squares ISTFT)로 시간 도메인 신호를 재구성한다.

생성기 손실은 세 부분으로 구성된다. (i) adversarial loss L_adv는 전통적인 GAN 손실로, 생성기가 판별기를 속이도록 학습한다. (ii) L1 손실은 픽셀‑단위 차이를 최소화해 기본적인 복원을 보장한다. (iii) 퍼셉추얼 손실 L_percep는 판별기의 N개의 중간 레이어에서 추출한 특징 맵 D_n(x)와 D_n(ŷ) 사이의 MAE를 가중 평균한 것으로, 이는 전역적인 스펙트럼 구조와 음성의 포네틱 패턴을 유지하도록 만든다. 전체 손실은 λ1·L1 + λ2·L_percep + λ3·L_adv 형태로 가중합한다.

판별기는 16 × 16 패치 단위로 입력을 나누어 각각을 실·가짜로 분류한다. 작은 패치 크기를 채택함으로써 주파수‑시간 영역의 미세한 차이를 더 민감하게 감지하고, 생성기가 놓치기 쉬운 작은 잡음 성분까지 학습하도록 유도한다.

실험은 TIMIT 데이터셋을 기반으로 진행되었다. 학습 데이터는 462명의 화자(8개 방언)로부터 36 000개의 (청음, 잡음) 쌍을 구성했으며, 잡음은 카페, 푸드코트, 주방 소음 3종을 0, 5, 10 dB SNR로 혼합했다. 검증은 (1) 동일 잡음 유형이지만 다른 화자와 전체 방언을 포함한 5 000개 트랙, (2) 전혀 새로운 도시 거리 잡음 500개 트랙 두 가지 시나리오로 수행했다. 비교 대상은 기존 SEGAN, FSEGAN, Wiener 필터, 최적화된 Bayesian 추정기이며, 모든 모델을 동일한 학습 설정(50 epoch, 동일 하이퍼파라미터)으로 훈련했다.

평가 지표는 PESQ(음성 품질), CSIG(음성 신호), CBAK(배경 잡음), COVL(전체 MOS), STOI(단기 청취 가능도), 그리고 Deep Speech 기반 ASR의 WER이다. 결과는 다음과 같다. 첫 번째 실험에서 AeGAN은 모든 SNR 구간에서 PESQ 3.04~4.5, CSIG 4.28~5.0, COVL 3.66~5.0, STOI 0.93~1.0, WER 20 %까지 달성했다. 이는 SEGAN(WER 44.7 %~49.6 %)과 FSEGAN(35.8 %~49.0 %)을 크게 앞선 수치이며, 전통 모델은 70 % 이상으로 실질적인 개선이 없었다. 두 번째 실험(도시 거리 잡음)에서도 AeGAN은 PESQ 3.27, CSIG 5.0, COVL 3.94, STOI 0.94, WER 20 %를 기록해, 새로운 잡음 유형에 대한 일반화 능력도 뛰어남을 확인했다.

시각적 분석(Fig. 4)에서도 AeGAN은 저전력 잡음 성분을 효과적으로 억제하면서, 음성 구간을 손실 없이 보존한다. 반면 SEGAN은 일부 음성 구간을 완전히 제거하고, FSEGAN은 잡음 잔류가 눈에 띈다.

결론적으로, AeGAN은 (1) CasNet 기반 다중 U‑블록을 통한 풍부한 피처 재구성, (2) 판별기 기반 퍼셉추얼 손실을 통한 전역 스펙트럼 보존, (3) 동적 시간 해상도 매핑을 통한 가변 길이 입력 처리라는 세 가지 핵심 기술을 결합해, 기존 GAN 기반 음성 강화 모델이 겪던 블러링·아티팩트·고정 길이 제한 문제를 효과적으로 해결한다. 이는 실시간 통신, 보청기, 스마트폰 등 다양한 실용 시스템에 바로 적용 가능한 수준의 성능 향상을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기