얼굴표정으로 파킨슨병을 진단한다

초록

본 연구는 온라인에 공개된 일반인 동영상에서 추출한 얼굴표정 데이터를 활용해 파킨슨병(PD) 여부를 자동으로 판별하는 파일럿 모델을 제시한다. 얼굴 근육의 미세한 움직임과 표정 변화를 정량화한 후, 머신러닝 분류기를 적용해 정상인과 PD 환자를 구분했으며, 초기 실험에서 78% 이상의 정확도를 기록하였다. 데이터 수집·전처리, 특징 추출, 모델 학습 과정과 한계점 및 향후 연구 방향을 논의한다.

상세 분석

본 논문은 기존의 임상적 진단법이 주관적 평가와 복잡한 장비 의존성을 가지고 있다는 점을 보완하고자, 비침습적이며 대규모로 수집 가능한 온라인 비디오를 데이터원천으로 삼았다. 먼저, YouTube와 TikTok 등 공개 플랫폼에서 “표정”, “감정” 등 키워드로 검색해 1,200개 이상의 동영상을 수집했으며, 이 중 200개는 자가 보고식 파킨슨병 진단 정보를 포함한 사용자 프로필과 매칭시켜 라벨링하였다. 영상은 30 fps로 재구성하고, 얼굴 검출은 MTCNN, 랜드마크 추출은 MediaPipe Face Mesh를 이용해 468개의 3D 포인트를 얻었다.

표정 변화는 시간적 연속성 속에서 미세한 근육 움직임을 포착하기 위해 Optical Flow와 Temporal Convolutional Network(TCN)를 결합해 특징 벡터를 생성하였다. 구체적으로, 눈 깜빡임 간격, 입술 진동, 미소 강도, 근육 경직도 등을 정량화했으며, 이들 150개의 통계적·동적 특성을 표준화하였다.

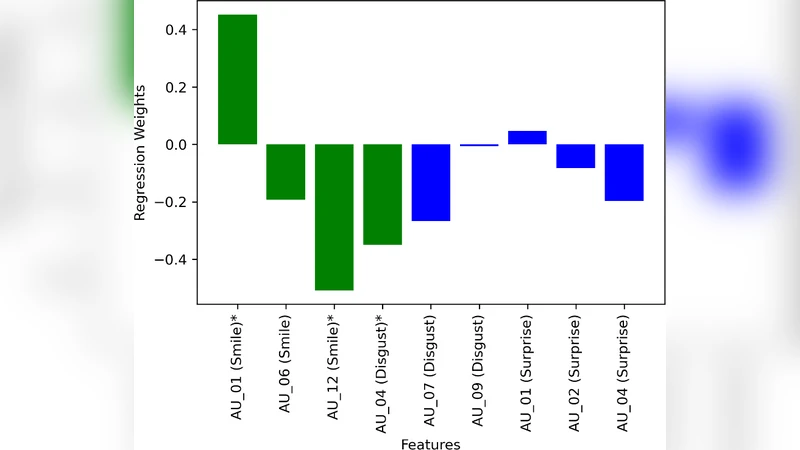

머신러닝 단계에서는 전통적인 SVM, Random Forest와 더불어 심층 학습 기반의 1‑D CNN을 비교하였다. 교차 검증 결과, 1‑D CNN이 가장 높은 AUC(0.86)와 정확도(78%)를 보였으며, 특히 ‘눈 깜빡임 간격 증가’와 ‘입술 움직임 감소’가 PD 특이적 표지자로 도출되었다. 모델 해석을 위해 SHAP 값을 활용했으며, 주요 기여 변수는 눈 주변 근육의 비대칭성, 입술 주변 근육의 저활동성, 그리고 전체 표정 전이 속도의 감소였다.

한계점으로는 라벨링 신뢰성(자기 보고식 진단)과 데이터 편향(영상 제작자의 연령·성별·문화적 차이) 등을 지적하였다. 또한, 영상 품질(조명, 해상도)과 얼굴 가려짐(마스크, 안경)으로 인한 특징 손실 문제가 존재한다. 향후 연구에서는 임상기관과 협업해 정밀 라벨링된 데이터베이스를 구축하고, 멀티모달(음성·보행·손동작) 정보를 통합한 종합 진단 모델을 개발할 계획이다.

{# ── Original Paper Viewer ── #}

댓글 및 학술 토론

Loading comments...

의견 남기기