신경 튜링 머신 종합 리뷰

초록

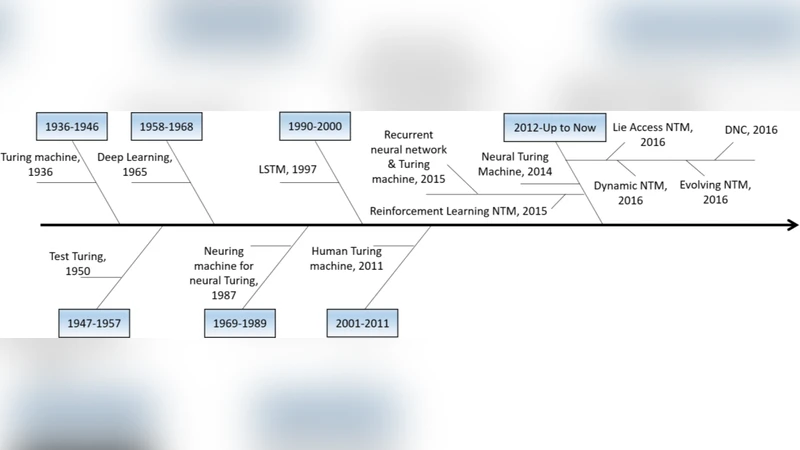

본 논문은 신경 튜링 머신(NTM)의 이론적 배경과 구조를 체계적으로 정리하고, 기존 연구에서 제시된 다양한 변형 모델과 적용 사례를 비교 분석한다. 또한 현재 직면한 학습·메모리 효율성 문제와 향후 연구 방향을 제시한다.

상세 분석

신경 튜링 머신은 전통적인 튜링 머신의 무한 메모리 개념을 신경망의 미분 가능한 형태로 구현한 모델로, 외부 메모리와 컨트롤러(보통은 LSTM 또는 GRU) 사이의 연산을 연속적인 가중치로 학습한다. 핵심은 읽기·쓰기 헤드가 메모리 슬롯에 대한 가중치 기반 주소 지정 방식을 사용한다는 점이다. 이때 가중치는 소프트맥스 함수를 통해 정규화되며, 따라서 역전파가 가능해진다. 논문은 먼저 머신러닝·신경망·튜링 머신의 관계를 마인드맵 형태로 제시하고, 이를 기반으로 NTM을 ‘기억·연산·학습’ 삼각형 구조로 분류한다.

구조적 분석에서는 컨트롤러, 메모리 매트릭스, 읽기·쓰기 헤드, 그리고 주소 지정 메커니즘(내용 기반·위치 기반·혼합) 네 가지 요소를 상세히 설명한다. 내용 기반 주소 지정은 현재 컨트롤러 출력과 메모리 내용 간의 코사인 유사도를 이용해 유사도가 높은 슬롯에 높은 가중치를 부여하고, 위치 기반은 순차적 이동(shift) 연산을 통해 인접 메모리 셀을 탐색한다. 이러한 두 방식을 조합함으로써 NTM은 복잡한 데이터 구조(리스트, 스택, 큐 등)를 동적으로 구성할 수 있다.

다양한 변형 모델로는 차별화된 주소 지정 전략을 채택한 차별적 메모리 네트워크(Differentiable Neural Computer, DNC), 메모리 접근을 강화한 메모리 강화 신경망(MANN), 그리고 메모리 크기를 압축하기 위한 압축 메모리 NTM 등이 있다. 각 변형은 원본 NTM이 겪는 학습 불안정성, 메모리 사용 비효율성, 그리고 장기 의존성 학습 한계를 보완하려는 시도로 설계되었다.

구현 과제 측면에서는 복사(copy), 연관 회상(associative recall), 정렬(sort), 그리고 그래프 탐색과 같은 알고리즘적 작업이 대표적으로 사용된다. 실험 결과, NTM은 전통적인 순환 신경망(RNN)이나 LSTM 대비 복잡한 순서적 패턴을 더 적은 학습 단계로 습득하지만, 메모리 크기가 커질수록 학습 시간과 메모리 사용량이 급격히 증가한다는 단점이 있다.

비교 분석에서는 어텐션 기반 트랜스포머와의 차이를 강조한다. 트랜스포머는 자체 어텐션을 통해 전역 정보를 처리하지만, 명시적인 외부 메모리를 갖지 않아 순차적 연산을 직접 모델링하기 어렵다. 반면 NTM은 외부 메모리를 통해 순차적 데이터 흐름을 명시적으로 저장·조작할 수 있어 알고리즘적 추론에 유리하다. 그러나 트랜스포머에 비해 병렬화가 제한되고, 미분 가능한 주소 지정 연산이 복잡해 학습이 불안정해지는 문제가 있다.

마지막으로 논문은 현재 NTM이 직면한 주요 이슈—메모리 스케일링, 주소 지정 정확도, 학습 안정성—를 정리하고, 계층적 메모리 구조, 강화학습과의 통합, 하드웨어 가속기 설계 등을 향후 연구 방향으로 제시한다. 이러한 논의는 NTM이 일반 목적 인공지능 구현을 위한 핵심 구성 요소로 자리매김하기 위한 로드맵을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기