감성 합성을 위한 GAN 최신 동향과 미래 과제

초록

본 리뷰는 인간 감성 합성 분야에서 GAN(Generative Adversarial Networks)의 적용 현황을 정리한다. 얼굴 표정, 음성 감정, 그리고 음·영상 교차 모달리티를 대상으로 주요 데이터베이스, 모델 구조·변형, 학습 전략 및 장·단점을 비교 분석하고, 현재 직면한 기술적 한계와 향후 연구 방향을 제시한다.

상세 분석

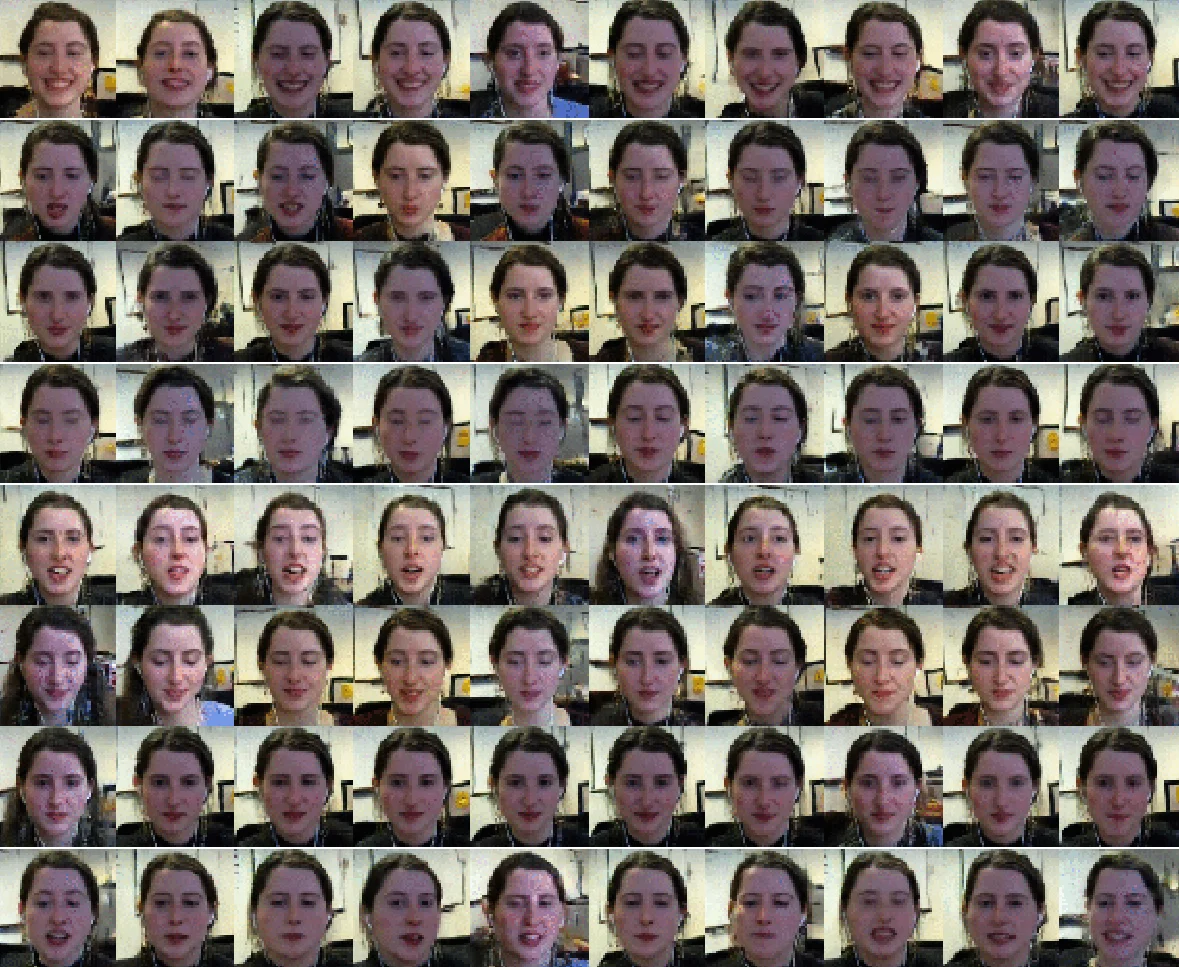

본 논문은 감성 컴퓨팅에서 GAN이 차지하는 위치를 체계적으로 조명한다. 먼저 GAN의 기본 원리와 vanila, CGAN, LAPGAN, SGAN, StyleGAN, DCGAN 등 주요 변형을 정리하고, 각각이 데이터 분포 학습에 어떻게 기여하는지를 수식과 함께 설명한다. 특히 조건부 입력(c)와 라플라시안 피라미드, 스펙트럴 정규화, 잔차 연결 등 구조적 개선이 생성 품질과 모드 붕괴 방지에 미치는 영향을 상세히 논의한다. 감성 합성 작업은 크게 얼굴 표정 합성, 음성 감정 합성, 그리고 음·영상 교차 합성으로 구분되며, 각 영역에서 사용되는 대표 데이터셋(MAFFS, CREMA‑D, RAVDESS, AffectNet 등)과 평가 지표(FID, PESQ, MOS 등)를 정리한다. 모델 학습 시 발생하는 불안정성(판별기와 생성기의 비대칭 학습, 모드 붕괴, 훈련 발산)과 이를 완화하기 위한 기법(라벨 스무딩, 한계 손실, 두 단계 학습, 프리트레인된 인코더 활용)도 구체적으로 제시한다. 또한 멀티모달 합성에서는 음성‑영상 정렬 문제와 교차 도메인 매핑을 위한 공동 잠재 공간 설계, 어텐션 메커니즘 도입이 핵심임을 강조한다. 마지막으로 현재 연구가 데이터 편향, 실시간 생성, 감정 표현의 미세 차이 포착, 윤리·프라이버시 문제 등 실용화 장벽에 직면해 있음을 지적하고, 대규모 비지도 학습, 변분 베이즈 GAN, 강화학습 기반 피드백 루프 등 차세대 접근법을 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기