회의용 두 단계 정보 병목 기반 화자 다이어리제이션의 점진적 전이 학습

본 논문은 기존 두 단계 정보 병목(TPIB) 화자 다이어리제이션 시스템이 매 회의마다 인공신경망(ANN)을 처음부터 학습함으로써 발생하는 높은 실시간 비율(RTF)을 개선하고자, 이전 회의에서 학습된 ANN 파라미터를 현재 회의에 전이하고 소량의 미세조정만 수행하는 점진적 전이 학습 방식을 제안한다. 제안 방식은 NIST RT‑04Eval 및 AMI‑1 데이터셋에서 각각 33.07%와 24.45%의 RTF 감소를 달성하면서, 화자 오류율(SE…

저자: Nauman Dawalatabad, Srikanth Madikeri, C Ch

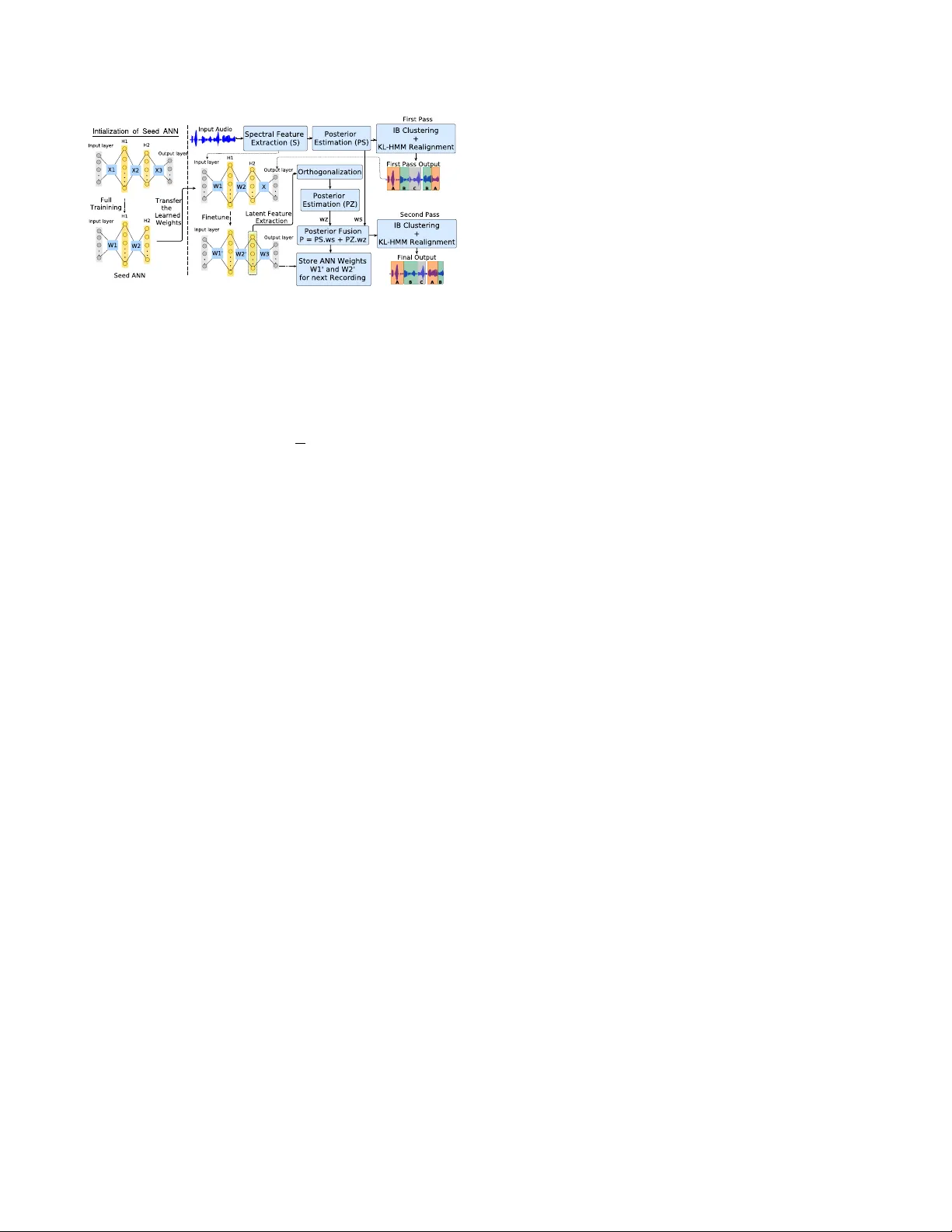

본 논문은 회의 녹음과 같은 대화형 음성 데이터에서 “누가 언제 말했는가”를 판별하는 화자 다이어리제이션 문제에 초점을 맞추고 있다. 기존의 정보 병목(Information Bottleneck, IB) 기반 클러스터링은 빠른 처리 속도와 비교적 간단한 구현으로 널리 사용되어 왔지만, 화자 구분 능력에서는 한계가 있었다. 이를 보완하기 위해 두 단계 정보 병목(Two‑Pass IB, TPIB) 시스템이 제안되었으며, 첫 번째 단계에서 기본 IB 클러스터링과 KL‑HMM 재정렬을 수행하고, 그 결과를 이용해 인공신경망(ANN)을 학습해 잠재 특징을 추출한 뒤, 두 번째 단계에서 이 특징과 원본 스펙트럼 특징을 결합해 다시 클러스터링한다. TPIB는 화자 구분 정확도에서는 기존 IB보다 우수했지만, 매 회의마다 ANN을 무작위 초기화하고 전체 데이터를 학습해야 하므로 실시간 비율(RTF)이 크게 증가하는 문제가 있었다.

이에 저자들은 “기억‑학습‑전이(Remember‑Learn‑Transfer)”라는 개념을 도입해, 이전 회의에서 학습된 ANN 파라미터를 현재 회의에 전이하고, 소량의 미세조정만 수행하는 점진적 전이 학습(Incremental Transfer Learning, ITL) 방식을 제안한다. 구체적인 절차는 다음과 같다.

1. **Seed ANN 학습**: 첫 번째 회의에 대해 기존 TPIB와 동일하게 IB‑KL‑HMM을 수행하고, 얻어진 라벨과 MFCC 스펙트럼 특징을 사용해 ANN을 무작위(Xavier) 초기화 후 학습한다. 이 ANN을 ‘seed ANN’이라 부른다.

2. **첫 번째 패스**: 이후 모든 회의에 대해 동일하게 IB‑KL‑HMM을 수행해 초기 라벨을 만든다.

3. **전이 및 미세조정**: 현재 회의의 ANN을 seed ANN의 가중치(W₁, W₂)로 초기화한다. 출력층의 뉴런 수는 현재 회의의 화자 수에 맞게 재설정하고, 이 층만 Xavier 초기화한다. 그런 다음 현재 회의의 라벨과 스펙트럼 특징을 이용해 제한된 epoch(논문에서는 50)만큼 미세조정한다. 미세조정된 가중치는 ANN*에 저장된다.

4. **잠재 특징 추출 및 정규화**: 미세조정된 ANN*의 penultimate layer 출력을 잠재 특징(LF)으로 추출하고, PCA를 적용해 정규 직교화한다.

5. **특징 결합**: 원본 MFCC와 LF를 가중합(w_s·MFCC + w_z·LF) 형태로 결합한다. 가중치는 실험을 통해 최적값(예: 0.8/0.2, 0.1/0.9 등)을 선택한다.

6. **두 번째 패스**: 결합된 특징을 이용해 두 번째 IB 클러스터링을 수행하고, 최종적으로 KL‑HMM 재정렬을 적용해 최종 화자 라벨을 얻는다.

이 과정에서 ANN*는 매 회의마다 업데이트되며, 이전 회의에서 학습된 화자 구분 지식이 누적된다. 따라서 매 회의마다 완전 새 학습을 하는 것에 비해 학습 시간과 메모리 사용량이 크게 감소한다.

실험은 NIST RT‑04Dev(개발), RT‑04Eval, RT‑05Eval 및 AMI‑1, AMI‑2 데이터셋을 사용했다. 평가 지표는 화자 오류율(SER)과 실시간 비율(RTF)이며, SER는 화자 매칭 오류만을 고려하기 위해 음성 활동 검출 오류는 제외하고, 0.25 s의 콜라를 적용했다.

**결과 요약**

- **SER**: 제안된 TPIB‑ITL은 기존 IB와 TPIB에 비해 큰 차이를 보이지 않으며, 일부 경우(특히 AMI‑2)에서는 1.6%p 정도의 절대 개선을 기록했다. 평균적으로는 TPIB와 비슷하거나 약간 우수했다.

- **RTF**: TPIB‑ITL은 TPIB 대비 평균 29%~33%의 RTF 감소를 달성했다. 특히 RT‑04Eval에서는 33.07% 감소, AMI‑1에서는 24.45% 감소, AMI‑2에서는 18.24% 감소를 보였다. 이는 ANN 학습 단계에서 소요되는 시간이 크게 단축된 결과이다.

- **순서 무관성**: 회의 순서를 무작위로 섞어 10번 실험했을 때도 전체적인 성능 추세가 유지되었으며, ‘개발 데이터만 전이’ 실험에서도 비슷한 RTF 감소와 SER 유지가 확인되었다.

**의의 및 향후 과제**

- **실시간 적용 가능성**: 점진적 전이 학습을 통해 실시간 혹은 준실시간 화자 다이어리제이션이 가능해졌으며, 대규모 콜센터, 회의 기록 자동 처리 등에 바로 적용할 수 있다.

- **비지도 학습**: 라벨이 없는 비지도 환경에서도 작동하도록 설계되었으며, 별도의 라벨링 데이터가 필요 없다는 점이 큰 장점이다.

- **확장성**: 현재는 MFCC와 ANN 기반 잠재 특징만을 결합했지만, 최신 음성 임베딩(x‑vector, ECAPA‑TDNN 등)과도 동일한 전이 학습 프레임워크를 적용할 수 있다. 또한, 다중 GPU 혹은 분산 학습을 통해 여러 회의를 병렬 처리하도록 확장 가능하다.

결론적으로, 본 논문은 화자 다이어리제이션 시스템에서 전이 학습을 활용함으로써 기존의 정확도는 유지하면서 연산 효율성을 크게 향상시킨 혁신적인 접근법을 제시한다. 이는 음성 처리 분야에서 실시간 요구가 점점 높아지는 현재와 미래에 중요한 기술적 토대를 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기