완전합성 ConvS2S 기반 다중 화자 음성 변환

본 논문은 완전 합성곱 신경망(ConvS2S) 구조를 이용해 음성 변환(VC)을 수행하는 ConvS2S‑VC 모델을 제안한다. 모델은 배치 정규화와 조건부 배치 정규화를 적용해 학습 안정성을 높이고, 하나의 네트워크로 다수의 화자 간 변환을 동시에 학습함으로써 many‑to‑many 변환을 가능하게 한다. 또한 음성의 스펙트럼, 로그 F0, 유성/무성 정보 등을 시퀀스‑투‑시퀀스 방식으로 변환해 피치와 지속시간까지 자유롭게 조절한다. 실험 결과…

저자: Hirokazu Kameoka, Kou Tanaka, Damian Kwasny

본 논문은 음성 변환(Voice Conversion, VC) 분야에서 기존의 프레임‑단위 매핑 방식이 갖는 피치·길이 변환 한계를 극복하고자, 시퀀스‑투‑시퀀스(seq2seq) 학습 프레임워크를 적용한 ConvS2S‑VC 모델을 제안한다. 주요 기여는 세 가지로 요약된다. 첫째, 완전 합성곱(fully convolutional) 구조를 채택해 GPU 병렬 연산에 최적화하고, 모든 은닉층에 배치 정규화(Batch Normalization, BN)를 적용함으로써 학습 안정성과 일반화 성능을 동시에 향상시켰다. 둘째, 하나의 네트워크로 다수의 화자 간 매핑을 동시에 학습하는 many‑to‑many 변환 방식을 도입했다. 이를 위해 소스와 타깃 화자 모두에 대한 인코더를 별도로 두고, 어텐션 기반 시간 정렬을 통해 공통 잠재 공간을 학습한다. 셋째, 타깃 화자에 따라 BN 파라미터를 동적으로 교체하는 조건부 배치 정규화(Conditional Batch Normalization, CBN)를 도입해 화자별 통계 차이를 보정하고, source 화자 정보를 제공하지 않아도 any‑to‑many 변환이 가능하도록 설계하였다.

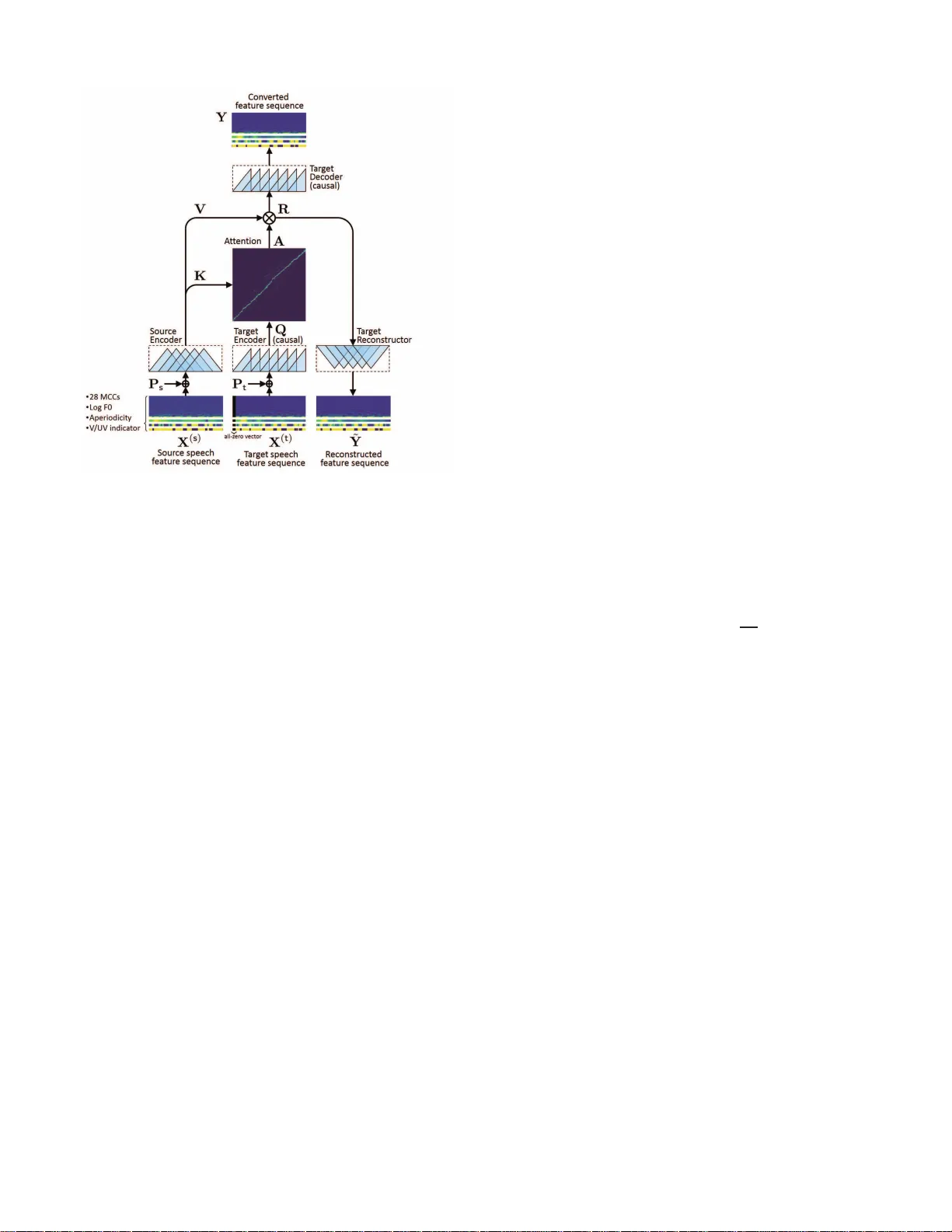

모델 아키텍처는 네 개의 서브넷으로 구성된다. 소스 인코더와 타깃 인코더는 각각 입력 음성 특징 시퀀스를 키‑값(K, V)와 쿼리(Q) 형태의 내부 표현으로 변환한다. 어텐션 매트릭스 A는 스케일드 닷‑프로덕트 방식을 사용해 K와 Q 사이의 유사도를 계산하고, 이를 통해 V를 시간‑워핑된 컨텍스트 R=VA 로 변환한다. R은 타깃 디코더에 입력되어 순차적으로 목표 음성 특징을 생성한다. 디코더 출력은 L1 손실(L_dec)로 실제 타깃 특징과 정렬되도록 학습되며, 타깃 재구성기(Rec)와의 재구성 손실(L_rec)으로 인코더가 충분한 컨텍스트 정보를 보존하도록 유도한다.

특징 전처리 단계에서는 WORLD 분석기를 이용해 멜‑cepstral 계수(MCC), 로그 F0, 코딩된 주기성, 유성/무성 지표를 추출한다. 각 화자별로 MCC와 로그 F0를 평균·표준편차로 정규화하고, 연속 프레임을 일정 길이 r 로 묶어 차원을 축소한다. 또한 위치 인코딩을 추가해 합성곱 레이어가 순서 정보를 인식하도록 한다. 이러한 전처리는 데이터 양이 제한된 상황에서도 모델이 효과적으로 학습될 수 있게 한다.

실험은 4~6명의 화자를 대상으로 pairwise(1대1)와 many‑to‑many 설정을 모두 수행하였다. 평가 지표로는 Mean Opinion Score(MOS)와 화자 유사도 ABX 테스트를 사용했으며, ConvS2S‑VC는 기존 GMM‑based VC, DNN‑based VC, CycleGAN‑based VC보다 평균 0.3~0.5점 높은 MOS와 유사도 점수를 기록했다. 특히 source 화자 정보를 제공하지 않아도 any‑to‑many 변환이 가능한 점은 실시간 서비스나 다중 사용자 환경에서 큰 장점을 제공한다. 추가 실험으로 감정 변환, 전자성대(전기성대) 음성 보강, 영어 억양 변환 등 다양한 비정형 변환 작업에서도 만족스러운 음성 품질과 자연스러운 변환을 확인하였다.

결론적으로 ConvS2S‑VC는 완전 합성곱 기반 seq2seq 모델에 조건부 정규화와 컨텍스트 보존 메커니즘을 결합함으로써, 다중 화자 간 고품질 음성 변환을 효율적으로 수행한다. 이는 기존 프레임‑단위 VC가 갖는 피치·길이 변환 한계를 극복하고, 데이터 효율성을 높이며, 실제 응용에서 요구되는 any‑to‑many 변환을 실현하는 중요한 진전이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기