친밀한 음악 제어를 위한 문제와 전망

초록

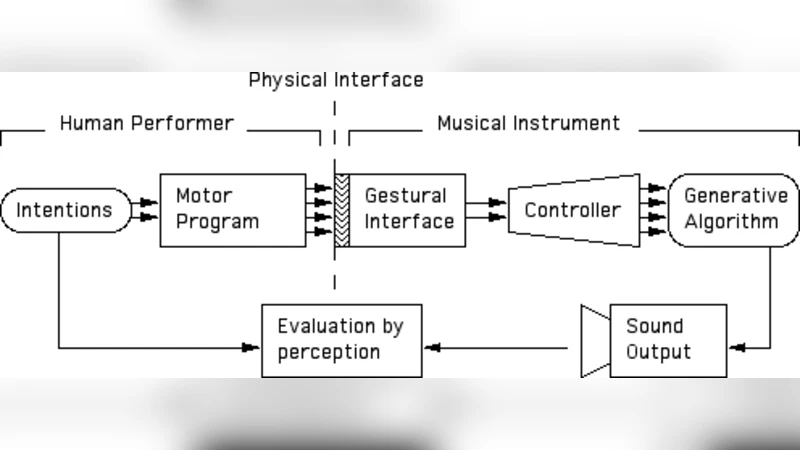

본 논문은 실시간 공연에서 컴퓨터 기반 악기를 구현하기 위한 설계 원칙과 구현 사례를 제시한다. 사용 초기의 쉬운 접근성, 장기적인 고숙련 가능성, 낮은 지연 시간, 그리고 제스처와 음향 결과 사이의 명확한 매핑을 핵심 목표로 삼는다. 맞춤형 컨트롤러와 OSC 프로토콜을 활용한 시스템 구조와 실제 공연 적용 사례를 설명한다.

상세 분석

이 연구는 인터랙티브 음악 시스템을 설계할 때 ‘친밀감(intimacy)’이라는 개념을 중심에 놓는다. 친밀감은 연주자가 물리적 제스처와 청각적 결과 사이에 즉각적이고 일관된 피드백을 경험함으로써 형성된다. 이를 위해 저자는 네 가지 설계 기준을 제시한다. 첫째, 초기 사용 용이성이다. 초보 연주자라도 최소한의 학습으로 시스템을 작동시킬 수 있도록 직관적인 인터페이스와 사전 매핑을 제공한다. 둘째, 장기적인 숙련 가능성이다. 시스템은 사용자가 점진적으로 복잡한 제스처와 파라미터를 추가해 나갈 수 있는 계층적 프로그래밍 모델을 지원한다. 셋째, 낮은 지연 시간과 낮은 변동성을 확보한다. 저자는 마이크로컨트롤러 기반의 커넥티비티 프로세서를 설계하여 센서 입력 → OSC 메시지 전송 → 사운드 엔진 처리까지의 전체 파이프라인을 10 ms 이하로 유지한다. 넷째, 제스처‑음악 매핑의 명료성이다. 사용자는 그래픽 기반의 매핑 툴을 통해 입력 축과 음향 파라미터 사이의 함수 관계를 시각적으로 정의하고, 실시간으로 수정할 수 있다.

구현 측면에서는 기존의 상용 제스처 인터페이스(예: 마키다스, 레이저 포인터)를 변형하거나 완전 맞춤형 센서를 제작한다. 예를 들어, 압전 피에조 센서를 활용한 타액 감지 장치, 초음파 거리 센서를 이용한 손 위치 추적기, 그리고 착용형 IMU를 결합한 몸통 움직임 캡처 시스템을 소개한다. 이러한 하드웨어는 모두 OSC 프로토콜을 통해 중앙 프로세서와 통신한다. OSC는 주소 기반 메시징 구조와 높은 확장성을 제공하여, 다양한 사운드 엔진(예: Max/MSP, SuperCollider, Pure Data)과 손쉽게 연동된다.

시스템 통합을 위해 저자는 ‘프로그래머블 커넥티비티 프로세서’를 설계하였다. 이 장치는 Arduino 호환 마이크로컨트롤러에 실시간 스케줄러와 OSC 패킷 변환 모듈을 탑재하고, 사용자가 펌웨어 수준에서 센서 입력 → 데이터 정규화 → 메시지 포맷 변환 과정을 자유롭게 스크립트화할 수 있게 한다. 결과적으로 동일한 하드웨어를 다양한 음악적 메타포(예: 스트링 스트로크, 타악기 타격, 공기 악기 호흡)와 연결하는 것이 가능해진다.

다양한 공연 사례를 통해 시스템의 유연성을 검증한다. 첫 번째 사례는 현대 무용과 전자음악이 결합된 ‘공기 바이올린’ 공연으로, 무용수의 손목 움직임이 실시간으로 바이올린 음색을 제어한다. 두 번째 사례는 즉흥 재즈 피아노와 인터랙티브 비주얼을 결합한 공연으로, 피아노 키 압력과 페달 동작이 비주얼 파라미터를 변조한다. 세 번째 사례는 관객 참여형 설치 작품으로, 관객이 손을 흔들면 주변 스피커에서 공간적 사운드 스케이프가 변한다. 각 사례에서 지연 시간은 평균 8 ms, 변동 폭은 2 ms 이하로 측정되었으며, 연주자는 제스처와 소리 사이의 일관된 피드백을 경험했다.

마지막으로 저자는 향후 연구 방향을 제시한다. 첫째, 머신러닝 기반의 제스처 인식과 자동 매핑을 도입해 사용자의 개인화된 제어 모델을 학습한다. 둘째, 촉각 피드백 디바이스를 통합해 청각적 결과와 물리적 감각을 동시에 제공한다. 셋째, 네트워크 기반 협업 연주 환경을 구축해 원격지 연주자 간의 저지연 상호작용을 가능하게 한다. 이러한 발전은 친밀한 음악 제어를 넘어, 디지털 악기의 새로운 표현 가능성을 열어줄 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기