이진 시냅스를 가진 제한볼츠만 머신 학습을 위한 변분 평균장 이론

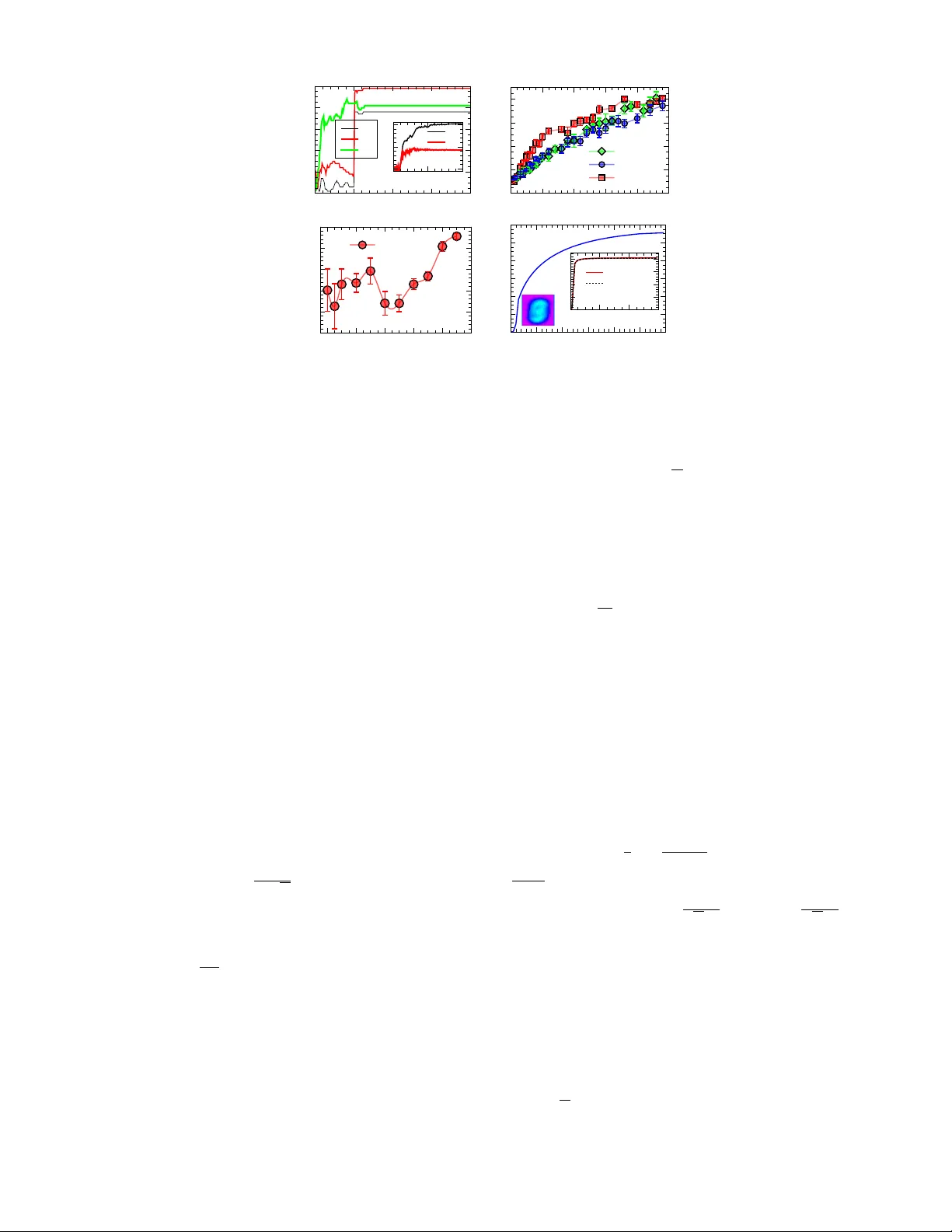

본 논문은 이진(±1) 가중치를 갖는 제한볼츠만 머신(RBM)의 무감독 학습을, 가중치 분포를 변수화한 변분 평균장(Variational Mean‑Field) 프레임워크로 재구성한다. 변분 파라미터 λ를 최적화하는 최대화 단계와, λ에 의해 정의된 등가 신경망에서 메시지 전달을 수행하는 기대 단계가 교차하며, 데이터 로그가능도에 대한 하한(Lower‑Bound)을 구배 상승으로 최대화한다. 실험에서는 플랜트된 가중치를 가진 합성 RBM과 손글씨…

저자: Haiping Huang

본 논문은 뇌의 무감독 학습 메커니즘을 인공 신경망에 적용하기 위해, 이진(±1) 시냅스를 갖는 제한볼츠만 머신(RBM)의 학습을 변분 평균장(Variational Mean‑Field) 이론으로 재구성한다. 전통적인 RBM 학습은 연속적인 가중치를 전제로 한 대조 발산(Contrastive Divergence) 알고리즘에 의존한다. 그러나 이산 가중치, 특히 저정밀 바이너리 시냅스에서는 미분이 정의되지 않아 기존 방법을 적용하기 어렵다. 저자는 이를 베이즈 관점에서 “데이터 D가 주어졌을 때 가중치 ξ의 사후분포 P(ξ|D)”를 추정하는 문제로 전환하고, 이 사후분포를 tractable한 변분 분포 qλ(ξ)로 근사한다. 변분 분포는 각 시냅스 i‑μ에 대해 독립적인 베르누이 형태를 취하며, 평균 파라미터 λiμ가 실제 가중치의 기대값을 대변한다.

변분 원리는 KL 발산을 최소화하는 것이며, 이는 데이터 로그가능도에 대한 하한(Lower‑Bound) LB(qλ)=E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기