계층형 하이퍼그라디언트 적응 학습률 최적화

초록

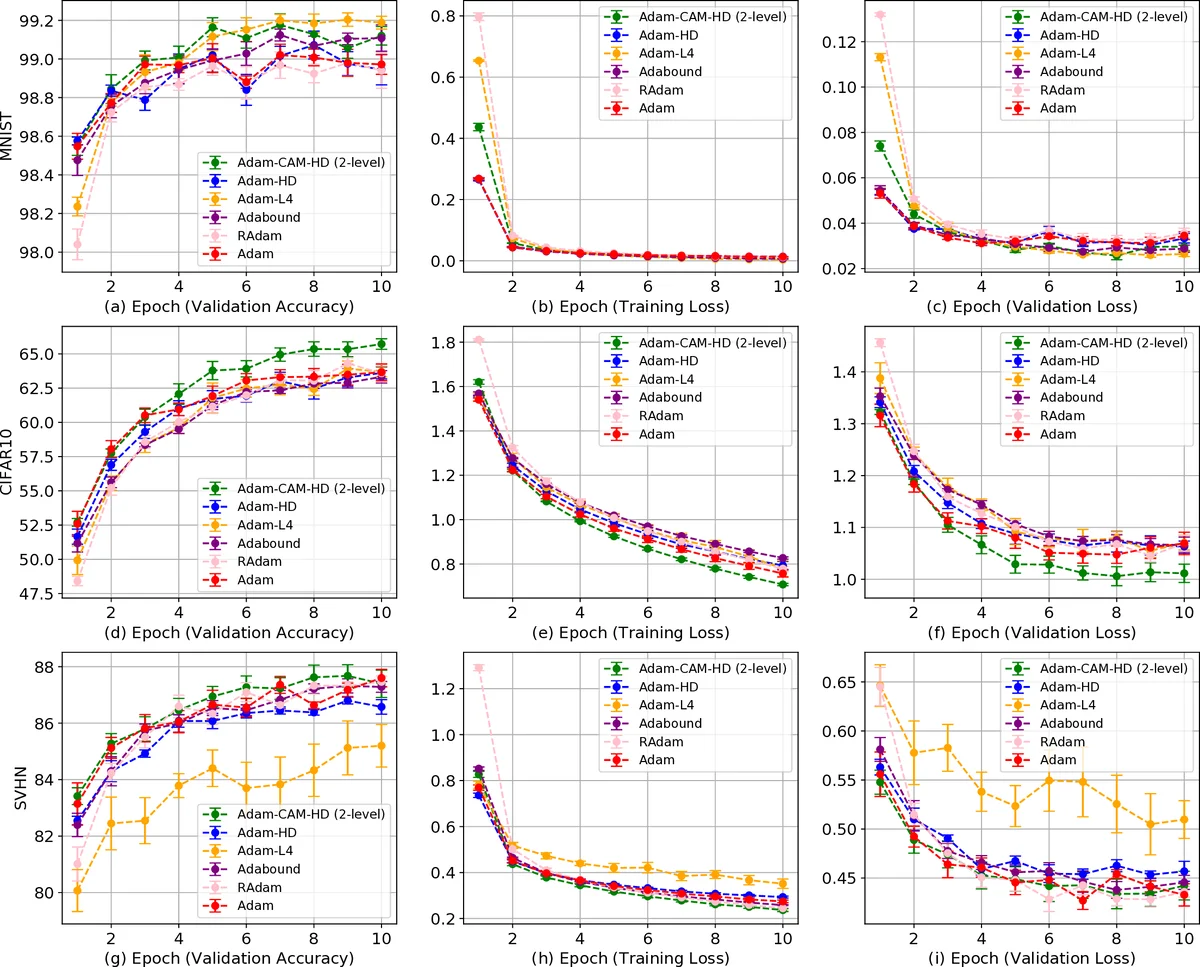

본 논문은 하이퍼그라디언트 기반 학습률 적응을 계층적으로 확장하여, 전역·층·유닛·파라미터 수준의 학습률을 동시에 학습하고, 과다 파라미터화를 방지하기 위한 정규화 항을 도입한다. 제안 방법은 LeNet‑5, ResNet‑18/34 등 다양한 네트워크에서 기존 적응형 옵티마이저를 능가하는 성능을 보인다.

상세 분석

이 연구는 기존 하이퍼그라디언트(HD) 기법이 주로 전역 스칼라 학습률만을 최적화한다는 한계를 지적하고, 학습률을 전역‑층‑유닛‑파라미터 네 단계로 세분화한다는 새로운 패러다임을 제시한다. 핵심 아이디어는 각 레벨별 학습률을 별도의 파라미터 벡터(또는 행렬)로 두고, 이들에 대한 하이퍼그라디언트를 역전파를 통해 실시간으로 업데이트하는 것이다.

수식 (1)‑(6)에서 기본 GD와 하이퍼그라디언트 업데이트 규칙을 재정의하고, 이를 가법형과 곱셈형 두 형태로 일반화한다. 이후 3.1 절에서는 학습률을 벡터화하고, 레이어별, 파라미터별, 유닛별로 구분하는 구체적 정의를 제공한다. 특히 파라미터‑와 레이어‑학습률 사이의 관계를 그라디언트 체인을 이용해 도출함으로써, 기존 스칼라 학습률이 갖는 표현력의 한계를 극복한다.

하지만 레벨이 늘어날수록 파라미터 수가 급증하고, 작은 배치에서의 추정 노이즈가 커지는 과다 파라미터화(over‑parameterization) 문제가 발생한다. 이를 해결하기 위해 3.2 절에서 정규화 항을 도입한다. 레이어‑정규화 (L_{lr_reg}^{layer}= \lambda_{layer}\sum_l(\alpha_l-\alpha_g)^2) 은 레이어별 학습률을 전역 평균에 끌어당겨 과도한 변동을 억제한다. 파라미터‑정규화는 두 단계(파라미터‑↔︎레이어, 파라미터‑↔︎전역)를 동시에 고려해 (\lambda_{para_layer},\lambda_{para}) 로 가중한다. 또한 시간‑연속성 정규화 (L_{lr_reg}^{ts}= \lambda_{ts}(\alpha_{g,t}-\alpha_{g,t-1})^2) 를 통해 학습률의 급격한 변동을 완화한다.

업데이트 규칙(13)‑(19)에서는 정규화 항을 포함한 전체 손실에 대한 미분을 구하고, 가상 학습률 (\hat\alpha) 를 도입해 실제 학습률 (\alpha^*) 를 가중 평균 형태로 표현한다. 이 과정에서 (\beta) 와 (\lambda_{layer}) 의 곱이 0~1 사이에 머물도록 제약을 두어 수치적 안정성을 확보한다. 근사식의 정확도는 (\beta)·(\lambda) 가 충분히 작을 때 보장되며, 실험에서는 이 범위 내에서 하이퍼파라미터 탐색이 수행된다.

실험 섹션에서는 Feed‑forward, LeNet‑5, ResNet‑18/34 등 네트워크에 대해 Adam, RMSProp, L4 등 기존 적응형 옵티마이저와 비교한다. 다중 레벨 적응이 수렴 속도와 최종 정확도 모두에서 일관된 개선을 보이며, 특히 깊은 ResNet 구조에서 과적합을 억제하는 효과가 두드러진다. 정규화 계수를 조절함으로써 전역‑지역 균형을 자유롭게 조정할 수 있다는 점도 실증적으로 확인된다.

한계점으로는 추가 하이퍼파라미터 탐색 비용과 복잡한 업데이트 식으로 인한 구현 난이도가 있다. 또한 정규화 계수의 선택이 성능에 민감하게 작용하므로, 자동화된 메타‑튜닝 기법이 필요할 것으로 보인다. 전반적으로 이 논문은 하이퍼그라디언트 기반 학습률 적응을 계층적으로 확장함으로써, 기존 적응형 옵티마이저가 놓친 지역‑전역 상호작용을 효과적으로 포착한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기