영구적 랜덤 연결망으로 비파라메트릭 불변성 학습

본 논문은 컨볼루션 신경망에 영구적인 랜덤 채널 연결(Connectome)을 도입한 PRC‑NPTN 레이어를 제안한다. 무작위로 초기화된 채널 셔플링을 고정시켜 두고, 각 입력 채널에 다수의 필터를 적용한 뒤 고정된 랜덤 풀링 지원(CMP)으로 채널‑맥스풀링을 수행한다. 이를 통해 파라메트릭 변환이 아닌 데이터 자체에서 비파라메트릭 변환 불변성을 학습할 수 있으며, 기존 ConvNet 및 NPTN 대비 일반화 성능이 향상됨을 MNIST, ETH…

저자: Dipan K. Pal, Akshay Chawla, Marios Savvides

본 논문은 머신러닝, 특히 이미지 분류와 같은 감독 학습 과제에서 데이터에 존재하는 비파라메트릭 변환 불변성을 효과적으로 모델링하는 방법이 부족하다는 문제점을 지적한다. 기존 연구들은 주로 회전, 이동, 스케일 등과 같은 파라메트릭 변환을 사전에 정의하고, 이를 네트워크 구조에 하드코딩하거나 데이터 증강을 통해 간접적으로 학습한다. 그러나 실제 데이터는 이러한 변환이 복합적이고, 때로는 그룹 구조를 이루지 않는 경우가 많아 파라메트릭 접근만으로는 충분히 커버하기 어렵다.

이러한 배경에서 저자들은 ‘Permanent Random Connectome Non‑Parametric Transformation Networks (PRC‑NPTN)’라는 새로운 레이어를 제안한다. PRC‑NPTN은 기본적인 컨볼루션 연산을 유지하면서, 두 가지 핵심 메커니즘을 추가한다. 첫 번째는 ‘영구적 랜덤 채널 셔플링’이다. 네트워크 초기화 시, 각 입력 채널에 대해 |G|개의 필터를 학습시키고, 이 필터들의 출력 맵을 랜덤하게 매핑한다. 이 매핑은 학습·테스트 전 과정에서 고정되며, 따라서 ‘permanent’라는 명칭이 붙는다. 두 번째는 ‘채널‑맥스풀링’이다. 고정된 매핑에 따라 각 풀링 유닛은 사전에 정의된 크기 CMP만큼의 채널 집합을 선택해 최대값을 취한다. 이 풀링 지원은 무작위로 선택되지만 한 번 정해지면 변하지 않는다.

이 설계는 변환에 대한 불변성을 어떻게 제공하는가에 대한 이론적 설명을 제공한다. 기존의 그룹 이론 기반 접근은 변환 집합 G가 유니터리 연산으로 구성된 그룹이어야 한다는 전제가 필요했다. 저자들은 Lemma 2.1을 통해, 변환 g가 유니터리 연산이고, dot‑product 결과가 균등분포를 따른다면, max‑pooling은 변환에 대한 분산을 감소시켜 불변성을 제공한다는 일반적인 결과를 증명한다. 이는 변환이 그룹을 이루지 않아도 max‑pooling 자체가 불변성을 유도할 수 있음을 의미한다.

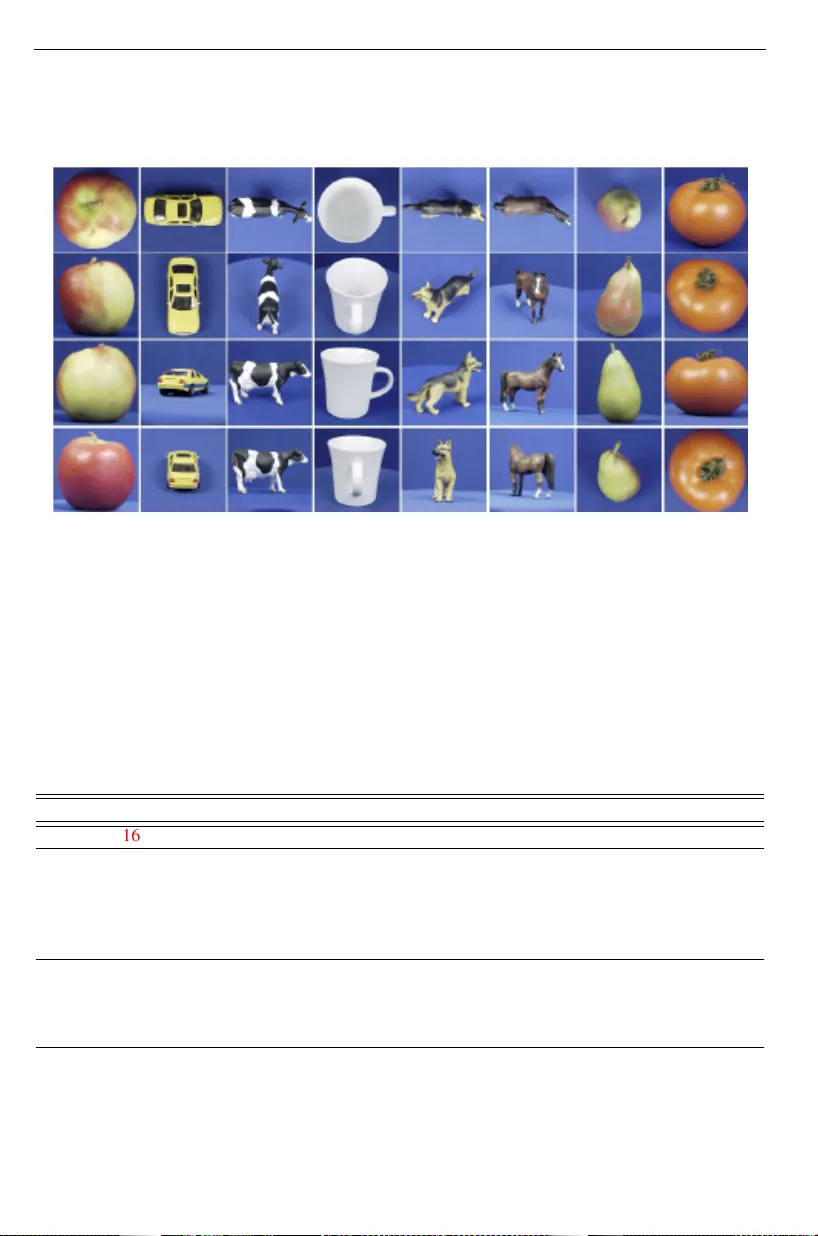

실험에서는 PRC‑NPTN을 기존 ConvNet, NPTN, 그리고 DenseNet에 적용하여 비교한다. MNIST에 무작위 회전·이동 변환을 가중시킨 ‘Extreme MNIST’에서는 PRC‑NPTN이 평균 오류를 크게 낮추었으며, 변환 강도가 증가할수록 그 차이가 두드러졌다. ETH‑80(물체 인식)과 CIFAR‑10(일반 이미지 분류)에서도 PRC‑NPTN을 레이어 단위로 교체함으로써 정확도가 향상되고, 특히 데이터에 내재된 복합 변환에 대한 일반화 능력이 강화되었다.

구현 측면에서는 CUDA 기반의 맞춤형 커널을 개발해 랜덤 채널 풀링 연산을 효율화했으며, 이는 기존 PyTorch 구현 대비 메모리 사용량과 연산 속도에서 유리함을 보였다. 또한, 뇌皮質에서 관찰되는 무작위 로컬 연결이 기능적 선택성을 제공한다는 생물학적 영감을 차용해, 영구적 랜덤 연결망이 일반화 성능을 높일 수 있다는 가설을 제시한다.

결론적으로, PRC‑NPTN은 (1) 영구적인 랜덤 연결을 통해 다중 비파라메트릭 변환에 대한 불변성을 학습하고, (2) 기존 네트워크 구조를 크게 변경하지 않으며, (3) 이론적 근거와 실험적 증명을 동시에 제공한다는 점에서 중요한 기여를 한다. 향후 연구에서는 변환 집합의 비균등 분포, 동적 연결망 업데이트, 시계열·3D 데이터에 대한 확장, 그리고 생물학적 연결망 모델링과의 연계가 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기