세분화 영역 맞춤 스타일 전이와 이미지 합성

SEAN은 의미 영역별로 독립적인 스타일 코드를 입력받아, 세분화 마스크와 결합한 공간적 정규화 파라미터를 생성하는 새로운 정규화 블록이다. 이를 통해 기존 SP‑ADE·Pix2PixHD 대비 높은 재구성 품질(FID, PSNR 등)과 지역별 스타일 제어·편집 기능을 제공한다.

저자: Peihao Zhu, Rameen Abdal, Yipeng Qin

본 논문은 의미 영역(semantic region)별 스타일을 독립적으로 제어할 수 있는 새로운 정규화 기법인 **Semantic Region‑Adaptive Normalization (SEAN)**을 제안한다. 기존의 조건부 GAN, 특히 SP‑ADE(GauGAN)와 같은 모델은 전체 이미지에 하나의 스타일 코드를 적용해 전체적인 색감·조명을 조절한다. 그러나 실제 이미지 합성·편집에서는 서로 다른 의미 영역에 서로 다른 스타일을 적용하고 싶어하는 경우가 빈번하다. 예를 들어 얼굴 합성에서는 머리카락은 파란색, 눈은 녹색, 배경은 회색 등으로 각각 다른 스타일을 부여하고 싶다. 이러한 요구를 충족시키기 위해 저자는 두 가지 핵심 모듈을 설계하였다.

첫 번째는 **Per‑Region Style Encoder**이다. 입력 이미지와 해당 이미지의 세분화 마스크를 동시에 입력받아, 각 의미 레이블에 대응하는 512‑차원 스타일 벡터를 추출한다. 인코더는 일반적인 다운샘플링 CNN이 아니라, 중간 피처맵을 **region‑wise average pooling**하여 각 레이블별 평균 피처를 구하고, 이를 512‑차원 벡터로 압축한다. 이렇게 하면 스타일이 영역의 형태와 무관하게 추출되며, 레이블이 존재하지 않을 경우 해당 컬럼을 0으로 채워 입력 차원을 고정한다. 또한 인스턴스 레이블이 있는 데이터셋(Cityscapes 등)에서는 인스턴스 단위 스타일 추출도 가능하도록 설계되었다.

두 번째는 **SEAN 블록**이다. SEAN은 기존의 AdaIN, SPADE와 유사하게 정규화 후 스케일·바이어스(γ, β)를 조절하지만, 조절 파라미터가 **스타일 매트릭스 ST와 세분화 마스크 M 모두에 의존**한다는 점에서 차별화된다. 구체적으로, 스타일 매트릭스 ST는 1×1 컨볼루션을 통해 각 레이블에 맞는 스타일 맵으로 변환되고, 마스크에 따라 해당 영역에 브로드캐스트된다. 이렇게 만든 스타일 맵과 마스크는 각각 별도의 컨볼루션 네트워크에 입력되어 γ_s, β_s(스타일 기반)와 γ_o, β_o(마스크 기반) 파라미터를 생성한다. 최종 파라미터는 학습 가능한 가중치 α_γ, α_β에 의해 두 파라미터의 가중합으로 결합된다. 수식으로는

γ = α_γ·γ_s(ST) + (1−α_γ)·γ_o(M)

β = α_β·β_s(ST) + (1−α_β)·β_o(M)

이다. 이 구조는 **공간적으로 변하는 정규화 파라미터**를 제공함으로써, 같은 레이어 안에서도 서로 다른 의미 영역에 서로 다른 스타일 변형을 적용할 수 있게 만든다.

아키텍처는 SPADE 기반의 생성기 구조에 **SEAN ResBlk**을 삽입한 형태다. 각 ResBlk은 3개의 컨볼루션 레이어와 그에 대응하는 SEAN 블록을 포함한다. 레이어마다 스타일 매트릭스는 1×1 컨볼루션 A_ij를 통해 레이어 특성에 맞게 변환되며, 추가적으로 노이즈를 삽입하고 채널별 스케일링 B를 학습한다. 이는 StyleGAN에서 차용한 기법으로, 노이즈가 이미지에 미세한 디테일을 부여하도록 돕는다.

학습은 **이미지 재구성** 방식으로 진행된다. 스타일 인코더는 입력 이미지와 마스크를 이용해 per‑region 스타일 코드를 추출하고, 생성기는 이 스타일 코드와 마스크를 입력받아 원본 이미지를 재구성한다. 손실 함수는 (1) 조건부 판별자 손실, (2) 피처 매칭 손실, (3) 퍼셉추얼 손실을 결합한다. 이 세 가지 손실은 이미지의 전반적인 사실성, 저수준 피처 일관성, 고수준 의미적 유사성을 동시에 최적화한다.

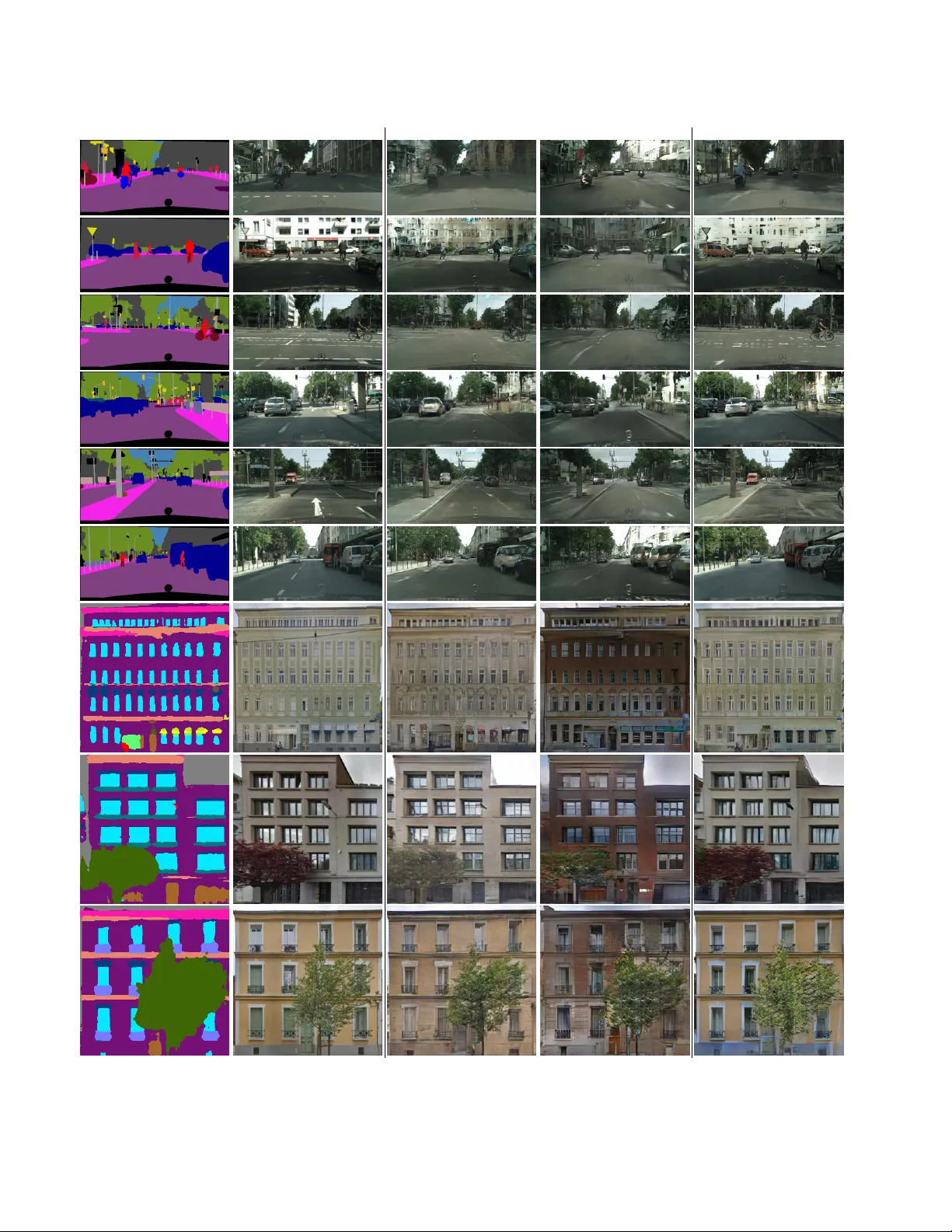

실험에서는 네 가지 데이터셋(CelebAMask‑HQ, Cityscapes, ADE20K, Façades)에서 정량적·정성적 평가를 수행했다. 정량 지표로는 SSIM, RMSE, PSNR, FID, mIoU, segmentation accuracy 등을 사용했으며, 모든 데이터셋에서 기존 SP‑ADE와 Pix2PixHD를 크게 앞섰다. 특히 SSIM·PSNR에서 평균 5~10% 향상을 보였고, FID에서도 30~50% 감소를 기록했다. 정성 평가에서는 **per‑region 스타일 전이**와 **스타일 보간**을 시연했다. 예를 들어, 얼굴 이미지에서 머리카락 스타일만을 다른 이미지의 머리카락 스타일로 교체하거나, 두 스타일 이미지 사이를 선형 보간해 자연스러운 스타일 변화를 구현했다. 또한 마스크를 직접 편집해 배경을 바꾸거나, 눈·입·코와 같은 세부 영역을 독립적으로 수정하는 인터랙티브 편집 시연도 제공했다.

논문의 주요 기여는 다음과 같다.

1. **SEAN 정규화 블록**: 스타일과 마스크를 동시에 고려한 공간적 정규화 파라미터를 제공, 기존 정규화 기반 조건부 GAN의 한계를 극복.

2. **Per‑Region Style Encoder**: 의미 레이블별 독립적인 스타일 코드를 실시간으로 추출, 다중 스타일 입력을 가능하게 함.

3. **고품질 이미지 재구성**: 다양한 데이터셋에서 기존 최첨단 모델 대비 정량 지표와 시각적 품질 모두에서 우수한 성능을 입증.

4. **인터랙티브 편집 가능성**: 마스크와 스타일을 자유롭게 교체·보간함으로써 실시간 이미지 편집 도구로 활용 가능.

결론적으로 SEAN은 **스타일과 구조를 완전히 분리하면서도 정규화 레이어를 통해 효율적으로 결합**하는 새로운 패러다임을 제시한다. 이는 고해상도 이미지 합성, AR/VR 콘텐츠 제작, 이미지‑to‑image 변환 등 다양한 응용 분야에서 보다 정밀하고 직관적인 사용자 제어를 가능하게 할 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기