고차원 벡터 분해에서 레조네이터 네트워크가 최적화 방법을 능가한다

레조네이터 네트워크는 고차원 벡터 심볼릭 아키텍처(VSA)에서 발생하는 Hadamard 곱 기반 복합 벡터를 효율적으로 분해한다. 비선형 동역학과 “중첩 탐색”을 결합해, 기존의 교대 최소제곱(ALS) 및 다양한 그래디언트 기반 최적화 기법보다 높은 운영 용량과 빠른 수렴을 보인다. 수렴 보장은 없지만 특정 파라미터 영역에서는 거의 항상 수렴한다는 실험적 증거가 제시된다.

저자: Spencer J. Kent, E. Paxon Frady, Friedrich T. Sommer

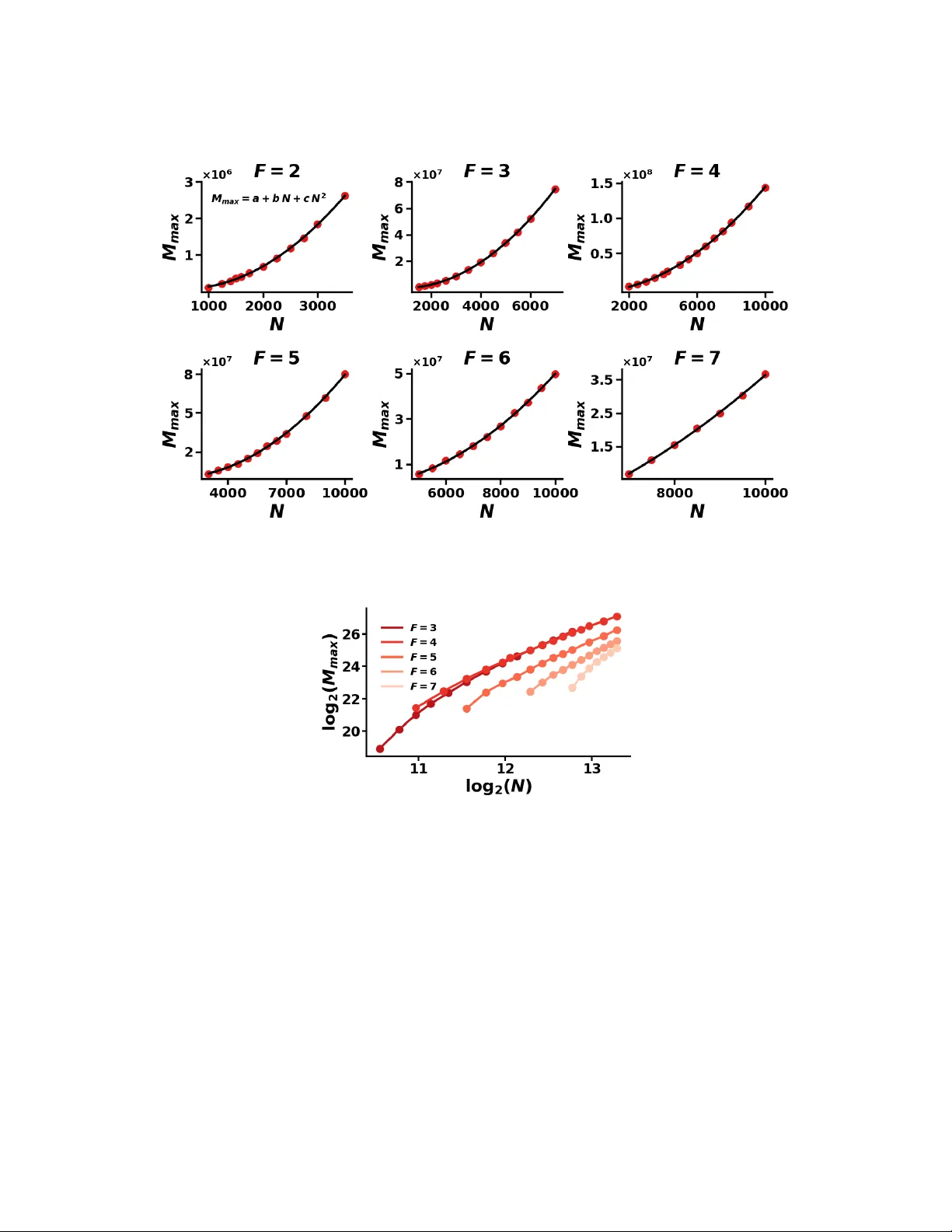

이 논문은 고차원 벡터 심볼릭 아키텍처(VSA)에서 발생하는 복합 벡터 분해 문제를 해결하기 위한 레조네이터 네트워크(Resonator Network, RN)의 이론적 기반과 실험적 성능을 종합적으로 제시한다. 먼저 문제 정의를 명확히 한다. 각 인자 f 에 대해 코드북 X_f 는 D_f 개의 ±1 벡터로 구성되고, 복합 벡터 c 는 각 코드북에서 하나씩 선택된 벡터들의 Hadamard 곱으로 생성된다. 목표는 주어진 c 와 코드북 집합으로부터 원래 선택된 벡터들을 정확히 복원하는 것이다. 가능한 조합 수 M=∏_f D_f 는 인자 수 F 와 각 코드북 크기 D_f 에 대해 지수적으로 증가하므로, 전통적인 완전 탐색은 메모리·시간 요구량이 비현실적이다.

RN은 “중첩 탐색(searching in superposition)”이라는 핵심 아이디어를 도입한다. 각 인자 f 에 대해 추정 벡터 \hat{x}^{(f)} 는 코드북 행렬 X_f 와 가중치 벡터 a_f 의 선형 결합 g(X_f a_f) 으로 표현된다. 여기서 g 는 항등 함수 혹은 부호 함수이며, 부호 함수는 이진 출력(±1)으로 강제한다. 전체 추정 복합 벡터 \hat{c}=∏_f \hat{x}^{(f)} 는 가능한 모든 조합의 가중합 형태가 되며, 각 조합에 대한 가중치는 a_f 들의 곱으로 결정된다. 고차원·무상관 조건 하에서는 이 중첩이 거의 잡음이 없으며, 부호 함수를 적용해도 각 조합과의 코사인 유사도가 보존된다.

동역학적으로 RN은 두 가지 가중치 방식을 제시한다. 첫 번째는 외적(Outer‑Product, OP) 가중치 W_f = X_f X_fᵀ 를 이용한 형태이다. 이는 고전적인 Hopfield 네트워크의 Hebbian 학습 규칙과 동일하며, 정수 가중치만 필요해 하드웨어 구현이 간단하다. 두 번째는 최소제곱(Ordinary Least Squares, OLS) 가중치 W_f = X_f X_f⁺ (의사역) 를 이용한다. OLS는 코드북 열 간 상관관계가 존재할 때 더 정확한 투영을 제공한다. 두 방식 모두 업데이트 식 \hat{x}^{(f)}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기