뇌종양 진행 구분을 위한 DCGAN‑AlexNet 융합 모델

초록

본 논문은 DCGAN과 AlexNet을 결합한 DC‑AL GAN 모델을 제안하여, 방사선 치료 후 MRI에서 나타나는 교모세포성 뇌종양(GBM)의 가성진행(PsP)과 진성진행(TTP)을 자동으로 구분한다. 생성‑판별 적대 학습을 통해 고차원 특징을 추출하고, 저층과 고층 특징을 융합함으로써 기존 방법보다 높은 분류 정확도를 달성하였다.

상세 분석

DC‑AL GAN은 두 개의 핵심 모듈, 즉 이미지 합성을 담당하는 DCGAN 기반 생성기와 특징 추출·분류를 담당하는 AlexNet 기반 판별기로 구성된다. 생성기는 무작위 잡음 벡터를 입력받아 실제 MRI와 구분이 어려운 합성 영상을 생성함으로써, 판별기가 제한된 학습 데이터(84명, PsP 23명·TTP 61명)에서도 과적합을 피하고 일반화 능력을 강화한다. 판별기인 AlexNet은 전통적인 비중첩 풀링 대신 겹침 풀링(overlapping pooling)을 적용해 공간 정보를 보다 풍부히 보존하고, 이는 작은 데이터셋에서 흔히 발생하는 정보 손실을 최소화한다.

특징 융합 단계에서는 AlexNet의 중간 계층(Conv3, Conv4 등)에서 추출한 저차원 텍스처·형태 정보를 최상위 계층(FC)에서 얻은 고차원 의미적 특징과 결합한다. 이 다중 스케일 결합은 PsP와 TTP 사이의 미세한 강도·모양 차이를 포착하는 데 효과적이며, 최종 SVM 분류기에 입력될 때 차원 축소와 정규화를 거쳐 높은 판별력을 제공한다.

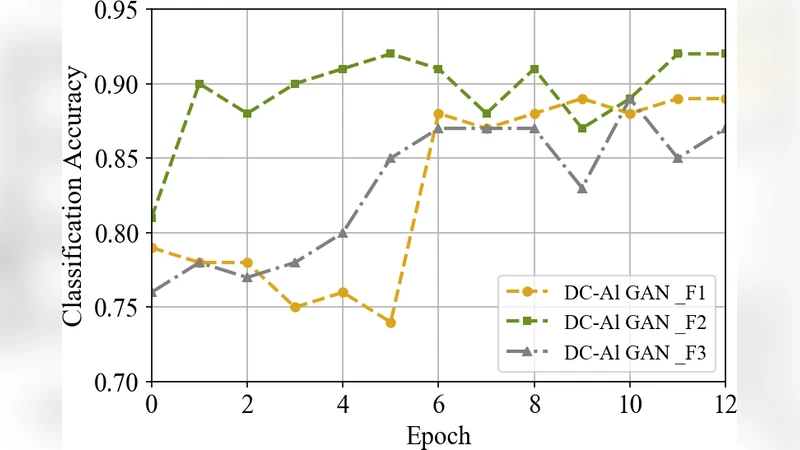

학습 과정에서는 GAN 특유의 미니맥스 게임을 이용해 생성기와 판별기를 교대로 최적화한다. 판별기의 손실 함수는 실제·합성 이미지에 대한 로그 손실과 SVM 기반 분류 손실을 동시에 최소화하도록 설계되어, 이미지 진위 판단과 임상 라벨 구분을 동시에 학습한다. 또한, 논문은 학습 안정성을 위해 레이어 정규화와 LeakyReLU 활성화를 적용했으며, 10‑fold 교차 검증을 통해 모델의 재현성을 검증하였다.

실험 결과, DC‑AL GAN은 정확도, 민감도, 특이도 모두 기존 CNN 기반 방법(예: VGG, ResNet) 및 전통적인 머신러닝(예: RF, SVM)보다 우수했으며, ROC 곡선 아래 면적(AUC)에서도 현저히 높은 값을 기록했다. 이는 제한된 임상 데이터에서도 GAN 기반 데이터 증강과 다중 스케일 특징 융합이 효과적임을 입증한다.

한계점으로는 데이터셋 규모가 여전히 작아 외부 검증이 부족하고, MRI 시퀀스(예: T1‑CE, FLAIR 등) 통합이 미흡하다는 점을 들 수 있다. 향후 연구에서는 다기관 데이터와 다양한 MR 모달리티를 포함한 멀티‑채널 GAN을 도입해 모델의 일반화와 임상 적용 가능성을 확대할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기