다중 턴 감정 대화 생성 모델 MEED

초록

본 논문은 대화의 흐름과 감정을 동시에 추적하는 계층적 인코더‑디코더 구조인 MEED를 제안한다. LIWC 기반 감정 임베딩을 활용해 다중 턴 대화에서 감정 변화를 학습하고, 기존 seq2seq 및 HRAN 대비 퍼플렉시티와 인간 평가에서 우수한 성능을 보인다.

상세 분석

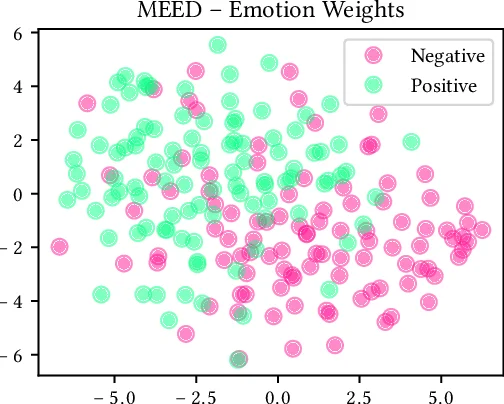

MEED 모델은 크게 세 부분으로 구성된다. 첫 번째는 기존 HRAN과 유사한 계층적 어텐션 메커니즘으로, 단어‑레벨 양방향 GRU 인코더와 발화‑레벨 단방향 GRU 인코더를 통해 대화 컨텍스트를 압축한다. 여기서 단어‑레벨 어텐션은 각 단어의 은닉 상태에 가중치를 부여해 발화 요약 벡터를 만들고, 발화‑레벨 어텐션은 이러한 요약 벡터들에 다시 가중치를 부여해 최종 컨텍스트 벡터 cₜ를 산출한다. 두 번째는 감정 인코더이다. LIWC2015를 이용해 각 발화를 6차원(긍정, 부정, 불안, 분노, 슬픔, 중립) 감정 지표 벡터로 변환하고, 이를 시그모이드 활성화와 전결합 층을 거쳐 연속형 감정 임베딩 aⱼ로 매핑한다. 이후 단방향 GRU가 발화 순서대로 aⱼ를 입력받아 감정 흐름을 모델링하고, 마지막 은닉 상태를 감정 컨텍스트 벡터 e로 사용한다. 디코더 단계에서는 기존 RNN 언어 모델에 cₜ와 e를 결합해 다음 토큰의 확률을 예측한다. 즉, 의미적 컨텍스트와 감정적 컨텍스트가 동시에 고려되는 구조다.

학습은 일반적인 교차 엔트로피 손실만 사용했으며, 감정 라벨을 별도로 요구하지 않는다. 이는 데이터‑드리븐 방식으로, 감정 라벨링 비용을 없애고 실제 대화에서 나타나는 미묘한 감정 상호작용을 학습할 수 있게 한다. 실험에서는 영화 자막 코퍼스를 사용했는데, 이는 소셜 미디어 데이터에 비해 품질이 높고 부적절한 표현이 적어 감정 모델링에 유리하다.

성능 평가에서는 두 가지 베이스라인, 즉 전통적인 seq2seq 모델과 HRAN을 대상으로 퍼플렉시티와 인간 평가를 수행했다. 퍼플렉시티 측면에서 MEED가 가장 낮은 값을 기록했으며, 인간 평가에서는 감정 적합성, 문법 정확성, 대화 흐름 유지 능력에서 모두 우수한 점수를 받았다. 특히 감정 적합성 점수가 두 베이스라인보다 현저히 높아, 감정 인코더가 실제 대화 상황에서 감정을 적절히 반영한다는 것을 입증한다.

한계점으로는 감정 사전(LIWC)의 범주가 제한적이며, 감정 표현이 다중 라벨(예: 슬픔과 분노가 동시에 나타나는 경우)으로 처리되지 못한다는 점이다. 또한, 감정 흐름을 단순히 마지막 은닉 상태 e에 압축함으로써 긴 대화에서 감정 변화를 충분히 보존하지 못할 가능성이 있다. 향후 연구에서는 VAD와 같은 연속형 감정 공간을 도입하거나, 감정 어텐션 메커니즘을 추가해 감정 정보의 선택적 강조를 시도할 수 있다.

전반적으로 MEED는 감정과 의미를 동시에 고려한 다중 턴 대화 생성 모델로, 기존 연구가 감정 라벨을 외부 입력으로 요구하거나 규칙 기반 접근에 의존하던 점을 데이터‑드리븐 방식으로 극복했다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기