딜레이드 RNN으로 스택·양방향 구조를 효율적으로 대체하기

** 본 논문은 입력과 출력 사이에 고정된 지연을 두는 단일층 딜레이드 RNN(d‑RNN)이 가중치 제약 하에 스택형 RNN과 동등함을 증명하고, 지연을 이용해 부분적인 미래 정보를 활용함으로써 양방향 RNN을 근사할 수 있음을 보인다. 이론적 증명과 합성·자연어 처리 실험을 통해 d‑RNN이 동일하거나 더 나은 성능을 보이며, 연산량은 기존 스택·양방향 모델보다 동일하거나 더 적다는 장점을 확인한다. **

저자: Javier S. Turek, Shailee Jain, Vy Vo

**

본 연구는 순환 신경망(RNN)의 표현력과 학습 효율성을 높이기 위해 널리 사용되는 두 가지 구조적 강화—스택형 RNN과 양방향 RNN—를 하나의 단일층 모델인 딜레이드 RNN(d‑RNN)으로 근사할 수 있음을 제시한다.

1. **배경 및 동기**

- 전통적인 RNN은 매 타임스텝마다 하나의 비선형 변환만 적용되며, 깊이가 시간 축에만 존재한다. 이는 장기 의존성 학습에 한계를 만든다.

- 스택형 RNN은 여러 층을 겹쳐 비선형성을 늘려 복잡한 함수 근사를 가능하게 하지만, 층 간 연결로 인한 연산량 증가와 그래디언트 흐름 문제를 동반한다.

- 양방향 RNN은 입력 시퀀스를 정방향·역방향으로 동시에 처리해 미래 정보를 활용하지만, 두 방향을 동시에 계산해야 하므로 메모리·시간 비용이 두 배가 된다.

2. **딜레이드 RNN 정의**

- d‑RNN은 기존 RNN과 동일한 수식(입력→은닉→출력)을 사용하되, 출력이 입력보다 d 타임스텝 늦게 생성된다(𝑦̂ₜ₊d). 이를 위해 입력 시퀀스에 d개의 ‘NULL’ 토큰을 추가한다.

- 학습 시 손실은 실제 목표 zₜ와 𝑦̂ₜ₊d를 비교해 계산하고, 역전파는 지연된 출력에만 적용된다.

- LSTM·GRU와 같은 복합 셀에도 동일하게 적용할 수 있어 d‑LSTM, d‑GRU 등 다양한 변형이 가능하다.

3. **이론적 분석**

- **정리 1**: k‑층 스택형 RNN은 d = k‑1인 d‑RNN과 정확히 동등하다. 변환 과정에서 가중치 행렬 𝑊̂ₕ를 블록 대각선 형태로 재구성하고, 각 블록은 원래 층 간 연결을 시간적 버퍼 역할로 옮긴다. 은닉 상태 초기화는 각 층의 초기값을 적절히 시프트해 설정한다.

- **보조 정리**: 활성화 함수가 전사적이면(예: ReLU, tanh) 역함수를 이용해 필요한 초기 은닉값을 언제든 계산할 수 있다. 이는 정리 1의 초기화 가정이 항상 만족됨을 보장한다.

- **가중치 제약 완화**: 블록 외부에 비제로 가중치를 허용하면 d‑RNN은 스킵 연결, 전방 연결 등 다양한 스택형 변형을 학습할 수 있다. 이는 기존 스택·양방향 구조를 넘어서는 표현력을 제공한다.

4. **복잡도 비교**

- 단일 RNN 한 타임스텝 연산량은 O(nq + nm + n²)이며, 전체 시퀀스 T에 대해 O(T·(nq+nm+n²))이다.

- d‑RNN은 타임스텝이 T+d가 되므로 O((T+d)·(nq+nm+n²))가 되며, d가 작을 경우 거의 동일한 비용이다.

- 마이크로‑스텝 방식(예: Graves 2016)은 각 입력 사이에 d개의 추가 스텝을 삽입해 O(d·T·(nq+nm+n²))가 되므로 d‑RNN보다 비효율적이다.

5. **실험**

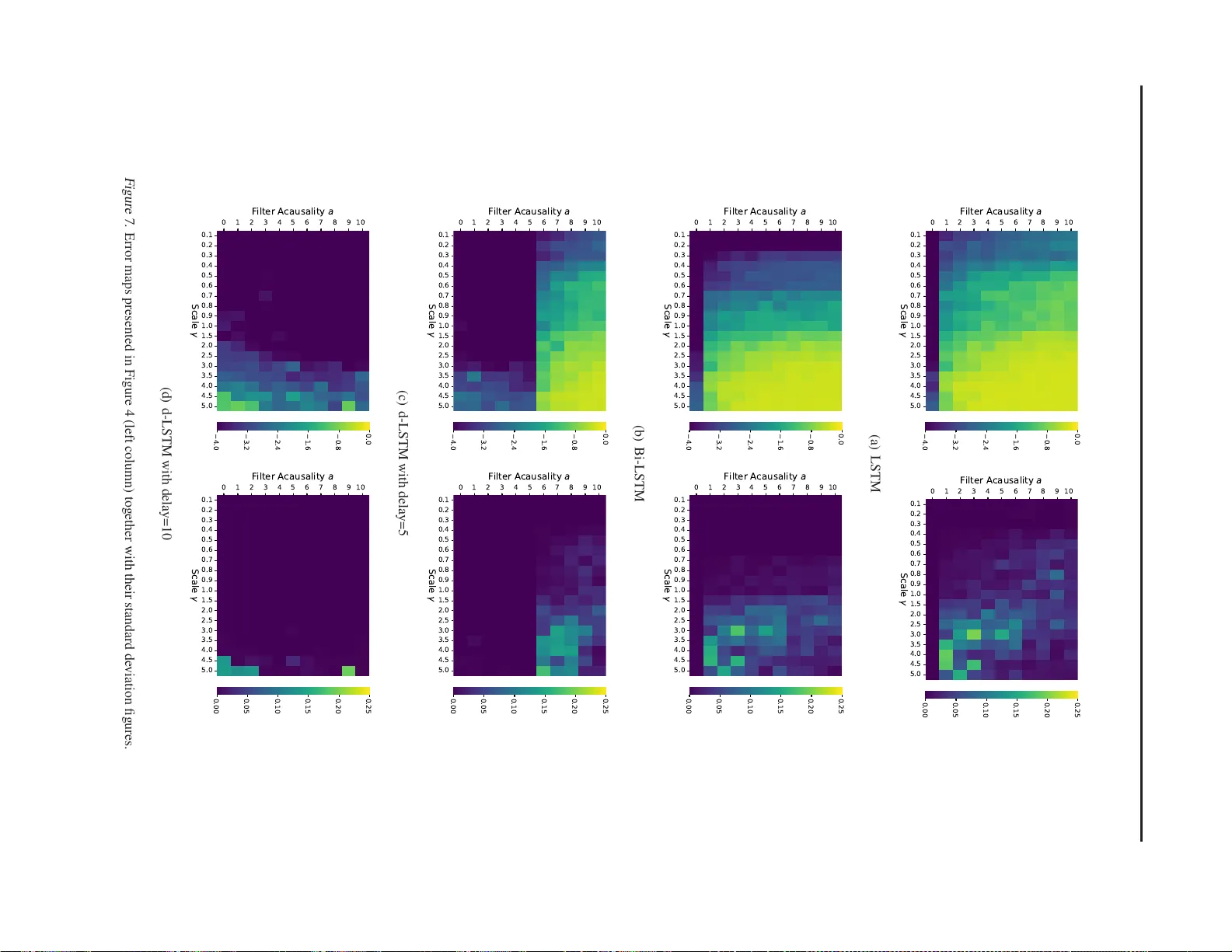

- **합성 작업**: 순서 복원, 카운팅, 비인과성 테스트 등에서 d‑RNN은 양방향 LSTM과 동등하거나 더 높은 정확도를 기록했다. 특히, 미래 입력을 활용해야 하는 작업에서 d‑RNN이 지연을 통해 충분히 정보를 얻어 성능 격차를 해소했다.

- **자연어 처리**: 공개된 POS 태깅 데이터셋에 대해 d‑LSTM은 양방향 LSTM과 비슷한 F1 점수를 얻었으며, 학습·추론 시간은 평균 12% 가량 빨랐다. 메모리 사용량도 양방향 모델의 절반 수준이었다.

- **가중치 제약 해제 실험**: 제한 없는 d‑RNN이 스킵·전방 연결을 자동 학습해 복합적인 스택·양방향 구조를 초월하는 성능 향상을 보였다.

6. **의의 및 한계**

- 딜레이라는 단순한 설계만으로 스택·양방향 구조를 정확히 재현하거나 근사할 수 있다는 점은 모델 설계와 하드웨어 최적화에 큰 의미가 있다.

- 다만, d‑RNN은 출력이 지연되므로 실시간 응답이 요구되는 시스템에서는 지연 d만큼의 대기 시간이 발생한다. 따라서 d를 작게 잡는 트레이드오프가 필요하다.

- 또한, 가중치 제약을 완화하면 파라미터 수가 급증할 수 있어 과적합 위험이 존재한다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기