교차 작업 일관성을 통한 강인 학습

초록

본 논문은 이미지 기반 여러 비전 작업 사이의 예측을 ‘일관성’이라는 제약으로 연결한다. 인퍼런스‑패스 불변성을 그래프 형태로 정의하고, 삼각형 손실을 분리 가능한 형태와 퍼셉추얼 손실로 변형해 효율적으로 학습한다. 또한 일관성 에너지라는 무지도 신뢰도 지표를 제안해 OOD 탐지에 활용한다. 다양한 데이터셋에서 기존 멀티태스크·사이클 일관성 방법들을 능가한다.

상세 분석

이 논문은 “Cross‑Task Consistency”(X‑TC)라는 개념을 도입해, 동일 이미지에서 추출되는 여러 비전 출력(예: 깊이, 표면 법선, 객체 마스크 등)이 서로 독립적이지 않다는 점을 명시적으로 학습에 반영한다. 핵심 아이디어는 inference‑path invariance이다. 즉, 같은 시작점과 끝점을 갖는 여러 경로를 통해 도출된 결과가 동일해야 한다는 제약을 그래프의 노드(예측 도메인)와 엣지(도메인 간 매핑 네트워크) 위에 정의한다.

이를 구현하기 위해 가장 작은 단위인 triangle loss를 제시한다. 삼각형은 입력 X→Y₁, X→Y₂, 그리고 Y₁→Y₂ 세 매핑을 포함하며, Y₁을 통해 Y₂를 재예측한 결과와 직접 X→Y₂로 얻은 결과를 일치시키는 손실을 추가한다. 이 손실은 기존의 독립 학습 손실에 일관성 항을 더함으로써 두 네트워크가 공동으로 최적화되도록 만든다.

하지만 삼각형 손실은 두 네트워크를 동시에 업데이트해야 하므로 계산 비용이 크게 증가한다. 저자들은 triangle inequality를 이용해 손실을 분리 가능한(separable) 형태로 변형한다. 구체적으로, |f_{Y₁→Y₂}∘f_{X→Y₁}−f_{X→Y₂}| ≤ |f_{Y₁→Y₂}∘f_{X→Y₁}−y₂| + |f_{X→Y₂}−y₂| 로 상한을 잡고, 이를 최소화하면 각 네트워크를 독립적으로 학습할 수 있다.

또한 실제 데이터에서는 Y₁↔Y₂ 사이의 완전한 변환 함수가 존재하지 않을 수 있다. 이를 해결하기 위해 perceptual loss 개념을 차용한다. y₂ 대신 f_{Y₁→Y₂}(y₁)를 사용함으로써, “실제 y₂와의 차이”를 상수항으로 처리하고, 학습 대상이 되는 f_{X→Y₁}는 오직 y₁과 f_{Y₁→Y₂}∘f_{X→Y₁} 사이의 차이만 최소화한다. 이렇게 하면 Y₁과 Y₂ 사이의 매핑이 불완전하거나 일대다 관계일 때도 안정적인 학습이 가능해진다.

다중 도메인 확장도 자연스럽게 이루어진다. 하나의 입력 X에 대해 여러 Yᵢ를 예측하고, 각 Yᵢ에 대해 다른 모든 Yⱼ와의 퍼셉추얼 일관성 손실을 동시에 적용한다. 이는 그래프 전체에 걸친 global cross‑task agreement를 강제한다.

학습 과정에서 얻어지는 Consistency Energy는 각 삼각형(또는 일반 경로)에서 발생하는 손실값의 합으로 정의된다. 실험적으로 이 값은 실제 supervised error와 높은 상관관계(r≈0.67)를 보이며, 따라서 라벨이 없는 상황에서도 모델의 신뢰도를 추정하거나 OOD 입력을 탐지하는 unsupervised confidence metric으로 활용될 수 있다(ROC‑AUC≈0.95).

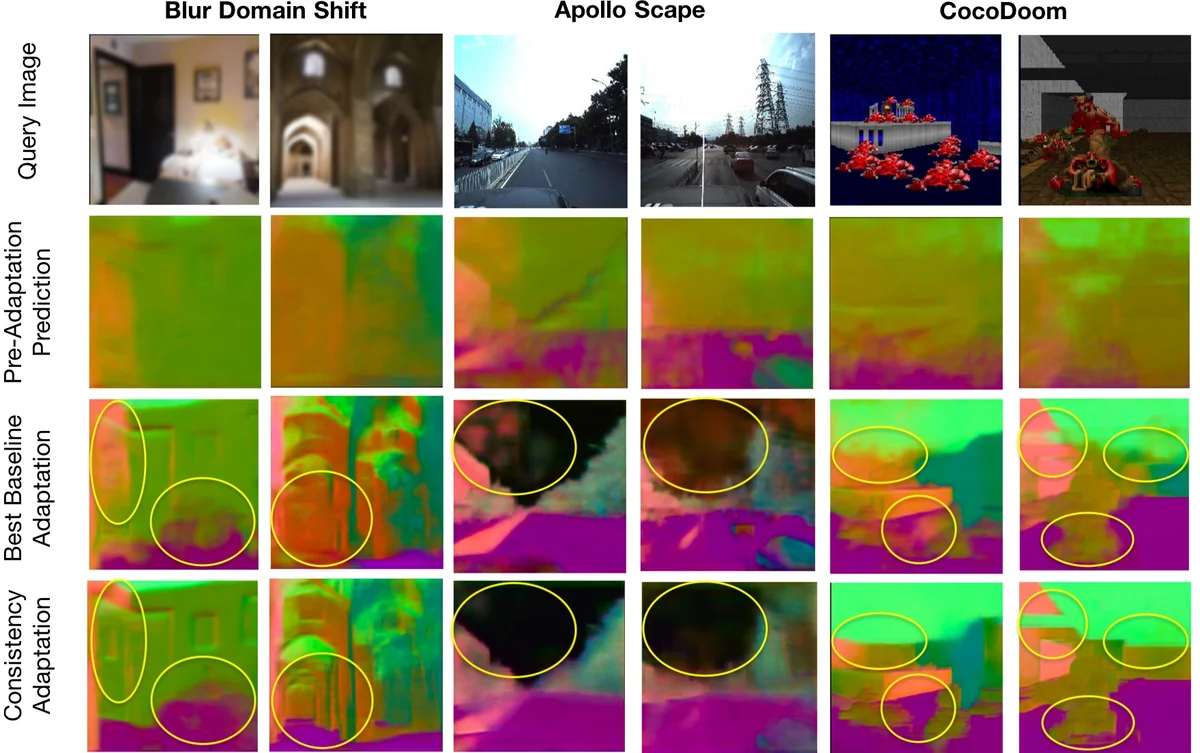

다양한 데이터셋(Taskonomy, Replica, COCO‑Doom, ApolloScape)에서 기존 멀티태스크 학습, 사이클 일관성, 분석적 일관성 등과 비교했을 때, X‑TC는 전반적인 정확도 향상과 더 나은 일반화(특히 도메인 이동 상황) 를 입증한다. 시각적 결과에서도, 일관성을 강제한 모델은 더 정교하고 잡음이 적은 출력(예: 표면 법선, 깊이, 재조명 등)을 제공한다.

결론적으로, 이 논문은 데이터‑주도형으로 복잡한 작업 관계를 학습하고, 효율적인 최적화 기법과 퍼셉추얼 손실을 결합함으로써, 기존 방법들이 갖는 “작업 간 독립성 가정”을 깨고 보다 견고한 멀티‑태스크 비전 시스템을 구현한다는 점에서 큰 의의를 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기