CPU 핀ning을 활용한 가상화·컨테이너 성능 최적화 가이드

초록

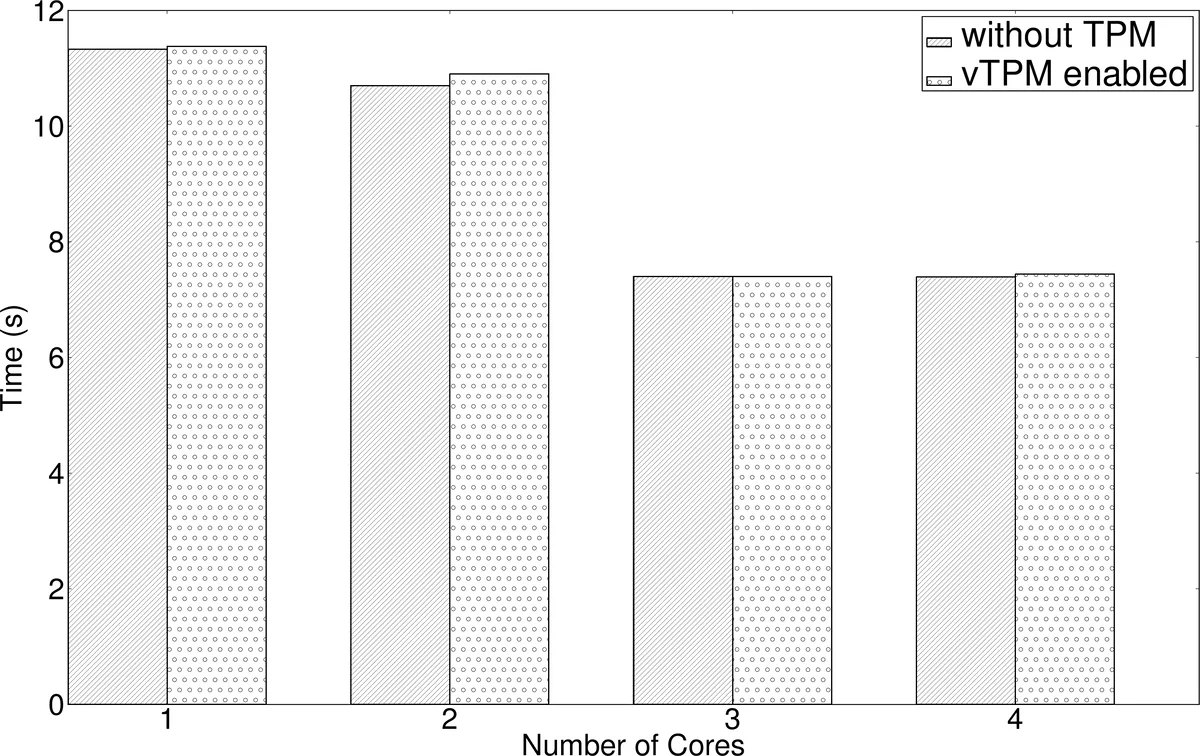

본 논문은 베어메탈, 가상 머신(VM), 컨테이너, 그리고 VM 위 컨테이너 네 가지 실행 플랫폼의 성능 오버헤드를 실제 클라우드 워크로드(영상 변환, MPI 병렬 처리, 워드프레스 웹, Cassandra NoSQL)와 다양한 CPU 코어 수, CPU‑pinning 적용 여부에 따라 정량적으로 평가한다. 실험 결과, 특정 상황에서는 컨테이너가 VM보다 높은 오버헤드를 보이며, 컨테이너를 VM 안에 배치하면 일부 워크로드에서 오버헤드가 감소한다. 또한 코어 수가 많을수록 오버헤드 비율이 낮아지는 경향이 관찰되었다. CPU‑pinning은 프로세스 이동을 제한해 오버헤드를 줄이지만, 비핀된 코어는 활용되지 않아 전체 CPU 활용률이 떨어질 수 있다. 논문은 이러한 결과를 바탕으로 워크로드 특성에 맞는 실행 플랫폼 선택 및 CPU‑pinning 설정 가이드를 제시한다.

상세 분석

이 연구는 클라우드 환경에서 흔히 선택되는 네 가지 실행 모델—베어메탈(BM), KVM 기반 가상 머신(VM), Docker 컨테이너(CN), 그리고 VM 내부 Docker 컨테이너(VMCN)—에 대해 동일한 하드웨어(112코어, 384 GB 메모리) 위에서 일관된 실험을 수행하였다. 각 모델은 “vanilla”(CPU‑quota)와 “pinning”(CPU‑set) 두 가지 CPU 할당 방식을 비교했으며, 오버헤드 비율은 베어메탈 대비 실행 시간으로 정의하였다.

-

워크로드별 특성

- FFmpeg: 멀티스레드 CPU‑집약형이며 16코어까지 스케일링 가능. 실험에서는 2, 4, 8, 16코어 인스턴스를 사용하였다.

- MPI (OpenMPI): 고성능 병렬 처리 워크로드로, 프로세스 간 통신 비용이 핵심 변수이다.

- WordPress: 짧은 HTTP 요청이 빈번히 발생하는 I/O‑집약형 웹 서버이며, 디스크·네트워크 대기 시간이 주요 병목이다.

- Cassandra: 대용량 NoSQL 데이터베이스로, 싱글 프로세스 내에서 대량의 디스크·메모리 I/O가 발생한다.

-

CPU‑pinning 효과

- 프로세스 마이그레이션 감소: CFS 스케줄러가 코어를 자유롭게 할당할 때 발생하는 캐시 미스·컨텍스트 스위치 비용이 감소한다. 특히 VM과 컨테이너 모두 “프로세스”로 인식되므로, 핀ning을 적용하면 호스트 레벨에서의 마이그레이션이 크게 억제된다.

- 오버헤드 감소량: FFmpeg와 MPI 같은 CPU‑집중 워크로드에서는 평균 8 %~12 %의 오버헤드 감소가 관찰되었으며, I/O‑중심 WordPress와 Cassandra에서는 4 %~7 % 정도로 제한적이었다. 이는 I/O 경로가 이미 커널 수준에서 공유되기 때문에 CPU‑pinning의 이점이 상대적으로 작다는 것을 의미한다.

-

컨테이너 vs. VM

- 일반적인 기대와 달리, 일부 실험에서는 CN이 VM보다 높은 오버헤드를 보였다. 이는 Docker가 cgroups와 namespace를 통해 리소스를 제한하지만, 내부 스케줄러가 여전히 호스트 CFS에 의존하기 때문이다. 특히 작은 코어 수(2~4코어)에서 컨테이너가 할당받은 CPU 자원을 과도하게 공유하면서 스케줄링 경쟁이 발생, 결과적으로 VM보다 높은 지연이 나타났다.

- 반면, VMCN 구조는 VM의 격리 장점과 컨테이너의 경량성을 결합한다. VM 내부에서 컨테이너가 실행될 때, VM에 할당된 코어가 고정(pinned)되면 컨테이너는 추가적인 스케줄링 레이어 없이 바로 실행된다. 실험에서는 특히 MPI와 Cassandra에서 VMCN이 VM 단독보다 5 %~9 % 낮은 오버헤드를 기록하였다.

-

코어 수와 오버헤드 비율

- 코어 수가 증가할수록 오버헤드 비율은 감소하는 경향을 보였다. 2코어 환경에서는 평균 15 % 이상의 오버헤드가 측정됐지만, 64코어 이상에서는 3 % 이하로 축소되었다. 이는 다수의 코어가 존재하면 스케줄러가 각 워크로드에 충분한 전용 코어를 할당할 수 있어 마이그레이션과 컨텍스트 스위치가 자연히 감소하기 때문이다.

- 특히 대규모 병렬 처리(MPI)와 대용량 데이터베이스(Cassandra)에서는 코어 수가 32 이상일 때 거의 베어메탈 수준의 성능에 근접했다.

-

베어메탈 대비 상대적 효율

- 베어메탈은 모든 실험에서 가장 낮은 절대 실행 시간을 보였으며, 오버헤드 비율은 0 %에 가장 가깝다. 그러나 관리·배포 편의성, 자원 다중 활용 측면에서 비용 효율이 떨어진다.

- 실무에서는 베어메탈을 반드시 선택해야 하는 경우(예: 초고성능 컴퓨팅, 실시간 데이터 처리) 외에는 VM·컨테이너 조합을 통해 운영 효율성을 높이는 것이 바람직하다.

-

베스트 프랙티스 요약

- CPU‑집중 워크로드(FFmpeg, MPI): 코어 수 ≥ 16, CPU‑pinning 적용, 가능하면 VMCN 구조 사용.

- I/O‑집중 워크로드(WordPress, Cassandra): 코어 수 ≥ 8, pinning은 선택적(오버헤드 감소는 미미), 컨테이너 단독 사용이 관리 편의성 측면에서 유리.

- 소규모 인스턴스(2~4코어): VM보다 컨테이너가 오히려 불리할 수 있으므로, VM을 기본으로 두고 필요 시 컨테이너를 배치.

- 대규모 인스턴스(≥ 32코어): 모든 모델에서 오버헤드 차이가 미미하므로, 운영 정책·보안 요구사항에 따라 선택.

이러한 분석은 클라우드 솔루션 아키텍트가 워크로드 특성, 비용, 관리 복잡성, 그리고 하드웨어 구성에 따라 최적의 실행 플랫폼과 CPU‑pinning 전략을 결정하는 데 실질적인 지침을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기