협동 다중에이전트 Q‑학습의 가치 분해 이해를 위한 새로운 이론적 틀

초록

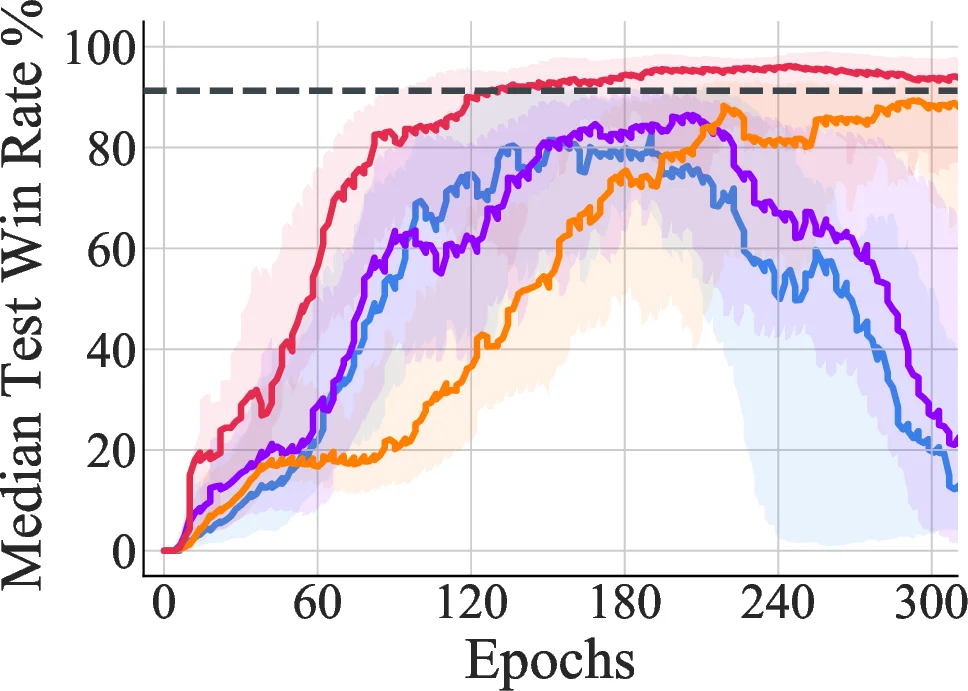

본 논문은 협동 MARL에서 널리 쓰이는 가치 분해 기법을 이론적으로 분석한다. 저자들은 다중에이전트 적합 Q‑반복(FMA‑FQI)이라는 일반 프레임워크를 제안하고, 선형 분해(VDN)와 IGM‑기반 분해(QPLEX·QTRAN)를 각각 연구한다. 선형 분해는 반사실적 신용 할당을 자동으로 수행하지만, 데이터가 오프‑폴리시일 경우 발산 위험이 있다. 반면 IGM 분해는 전역 수렴과 최적성을 보장한다. 마지막으로 이론적 결과를 검증하기 위해 StarCraft II 마이크로매니지먼트와 여러 교훈적 예제에서 최신 딥 MARL 알고리즘을 실험한다.

상세 분석

논문은 먼저 Dec‑ROMDP라는 풍부한 관측을 갖는 협동 마르코프 결정 과정을 정의하고, CTDE(중앙집중 훈련·분산 실행) 패러다임 하에서 가치 함수의 분해 구조를 수학적으로 형식화한다. 핵심 기여는 기존 단일 에이전트의 Fitted Q‑Iteration(FQI)을 다중 에이전트 환경에 확장한 FMA‑FQI 프레임워크이다. FMA‑FQI는 데이터셋 D와 지정된 함수 클래스 Q_FMA에 대해 매 반복마다 경험적 벨만 오차를 최소화함으로써 Q_tot과 개별 Q_i를 동시에 업데이트한다.

선형 가치 분해(VDN) 경우, Q_tot = ∑_i Q_i 로 정의되며, 이는 IGM 원칙의 충분조건이지만 필요조건은 아니다. 저자들은 FMA‑FQI에 선형 제약을 적용하면 업데이트 식이 닫힌 형태의 선형 최소제곱 문제로 변환됨을 증명한다. 이 과정에서 각 에이전트의 Q_i는 전체 보상에 대한 ‘반사실적’ 기여도를 추정하게 되며, 이는 기존 연구에서 별도로 설계된 counterfactual baseline과 동일한 효과를 가진다. 그러나 함수 클래스가 제한적이므로, 특히 오프‑폴리시 데이터(행동 정책과 목표 정책이 다름)에서는 고정점이 존재하지 않을 수 있고, 발산 현상이 관찰된다. 이를 해결하기 위해 저자는 온‑폴리시 데이터 수집이 고정점 존재와 지역 수렴을 보장한다는 정리를 제시한다.

IGM 기반 분해는 QPLEX·QTRAN이 구현한 형태로, Q_tot = f(

댓글 및 학술 토론

Loading comments...

의견 남기기