실험실과 현장을 아우르는 블라인드 이미지 품질 평가 모델

초록

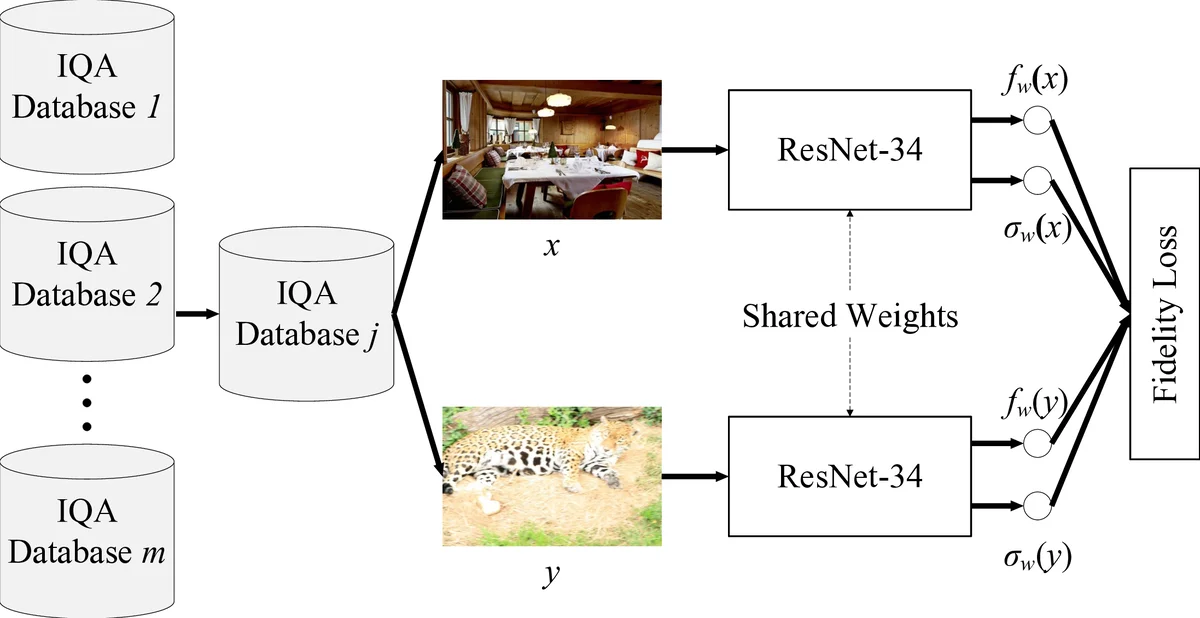

본 논문은 합성 왜곡과 실제 촬영 환경 모두에 강인한 블라인드 이미지 품질 평가(BIQA) 모델을 제안한다. 서로 다른 여섯 개 IQA 데이터베이스를 내부 이미지 쌍으로 구성해 연속적인 품질 확률 라벨을 생성하고, Thurstone 모델 기반의 확률을 활용한 피델리티 손실로 학습한다. ResNet‑34 기반의 시암쌍 네트워크와 2차 bilinear pooling을 결합해 높은 일반화 성능을 달성했으며, 6개 데이터베이스에서 기존 최첨단 모델들을 크게 앞섰다.

상세 분석

이 연구는 BIQA 분야에서 가장 큰 난제 중 하나인 “합성 왜곡 데이터와 현실 왜곡 데이터 간의 일반화 격차”를 근본적으로 해결하려는 시도이다. 기존 방법들은 하나의 데이터베이스에만 의존하거나, 서로 다른 데이터베이스를 결합하려면 MOS 스케일을 재정렬해야 하는 번거로움이 있었다. 저자들은 각 데이터베이스 내부에서 무작위로 이미지 쌍을 추출하고, 해당 쌍에 대해 인간 주관점수(MOS)와 표준편차를 이용해 Thurstone’s model을 적용, 두 이미지 중 어느 쪽이 더 높은 품질을 가질 확률 p(x,y)를 연속값으로 계산한다. 이 확률 라벨은 이진 라벨보다 풍부한 정보를 제공하며, 서로 다른 데이터베이스 간의 스케일 차이를 자연스럽게 해소한다는 점이 핵심이다.

학습 목표는 두 함수 f_w(x)와 σ_w(x)를 동시에 추정하는 것으로, 전자는 이미지의 평균 품질 점수, 후자는 불확실성을 나타낸다. 두 이미지의 품질 차이를 정규분포로 가정하고, 모델이 예측한 확률 p_w(x,y)와 실제 확률 p(x,y) 사이의 차이를 측정하기 위해 기존의 교차 엔트로피나 KL 발산 대신 물리학에서 차용한 피델리티 손실을 도입한다. 피델리티 손실은 0과 1 사이에 제한되며, hard example에 대한 과도한 패널티를 방지해 학습 안정성을 크게 향상시킨다.

네트워크 구조는 ResNet‑34를 백본으로 하는 시암쌍(Siamese) 아키텍처이며, 마지막 평균 풀링을 2차 bilinear pooling으로 교체해 고차원 공간에서의 통계적 특성을 효과적으로 포착한다. 두 스트림은 가중치를 공유하고, 풀링된 특징을 전결합층에 연결해 품질과 불확실성 두 스칼라를 동시에 출력한다.

데이터 측면에서 저자들은 LIVE, CSIQ, TID2013(합성), LIVE Challenge, BID, KonIQ‑10K(현실) 등 총 6개 데이터베이스를 활용해 24만 쌍 이상의 학습 샘플을 생성했다. 80%를 학습, 20%를 테스트에 사용했으며, 이미지 내용이 겹치지 않도록 레퍼런스 기반으로 분할했다. 학습은 Adam 옵티마이저와 12 epoch, 단계적 학습률 감소, 초기 3 epoch은 FC 레이어만 학습하는 워밍업 전략을 적용했다.

실험 결과는 SRCC 기준으로 모든 데이터베이스에서 기존 지식 기반 모델(NIQE, ILNIQE, dipIQ) 및 최신 DNN 기반 모델(MEON, deepIQA, PQR, DB‑CNN)을 크게 앞섰다. 특히 “All databases” 설정에서 연속 라벨링을 사용한 경우 SRCC가 0.961(LIVE), 0.907(CSIQ), 0.855(TID2013), 0.863(BID), 0.851(LIVE Challenge), 0.894(KonIQ‑10K)로, 전통적인 전참조 모델인 MS‑SSIM, NLPD와도 근접한 수준을 보였다. 교차 데이터베이스 실험에서도 TID2013와 LIVE Challenge만을 이용해 학습했음에도 불구하고, 다른 데이터베이스에서 일관된 성능 향상을 확인했다.

이러한 성과는 (1) 데이터베이스 간 스케일 정렬 없이도 연속 확률 라벨을 활용한 학습이 가능함, (2) 피델리티 손실이 확률 기반 순위 학습에 적합한 손실 함수임, (3) 사전 학습된 ResNet 가중치와 bilinear pooling이 다양한 왜곡 유형을 포괄하는 특징 표현을 학습하도록 돕는다는 점을 입증한다. 향후 연구에서는 인터‑데이터베이스 쌍을 포함한 학습, 더 다양한 왜곡 유형(예: 비디오, HDR) 확장, 그리고 불확실성 추정을 활용한 품질 예측 신뢰도 평가 등이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기