예측 코딩과 PredNet의 한계: 비판적 고찰

본 논문은 Lotter 등(2016)이 제안한 비디오 예측 네트워크 PredNet을 예측 코딩 이론의 구현체와 자기지도 학습 모델로서 재평가한다. Something‑Something 데이터셋을 이용해 예측 정확도와 특징 추출 능력을 검증하고, 상위 계층의 예측을 행동 라벨에 조건부로 연결하는 PredNet+ 확장을 제안한다. 실험 결과, PredNet은 계층적 오류 감소와 L‑all 손실 적용에서 기대와 다른 동작을 보이며, FPS와 동작 연속…

저자: Roshan Rane, Edit Sz"ugyi, Vageesh Saxena

본 연구는 Lotter 등(2016)이 제안한 PredNet을 예측 코딩 이론의 구현체이자 자기지도 영상 예측 모델로서 비판적으로 검토한다. 먼저 예측 코딩 이론을 간략히 소개하고, 기존 연구에서 PredNet이 어떻게 뇌의 계층적 구조와 오류 전파 메커니즘을 모방했는지를 정리한다. 이후 실험 설계 단계에서 두 가지 주요 목표를 설정한다. 첫 번째는 PredNet을 Something‑Something V2 데이터셋(220 000개 영상, 174개의 미세 행동 라벨)에 적용해 비디오 예측 정확도와 특징 추출 능력을 평가하는 것이며, 두 번째는 상위 계층의 예측을 행동 라벨에 조건부로 연결하는 PredNet+ 확장을 설계해 성능 향상을 검증하는 것이다.

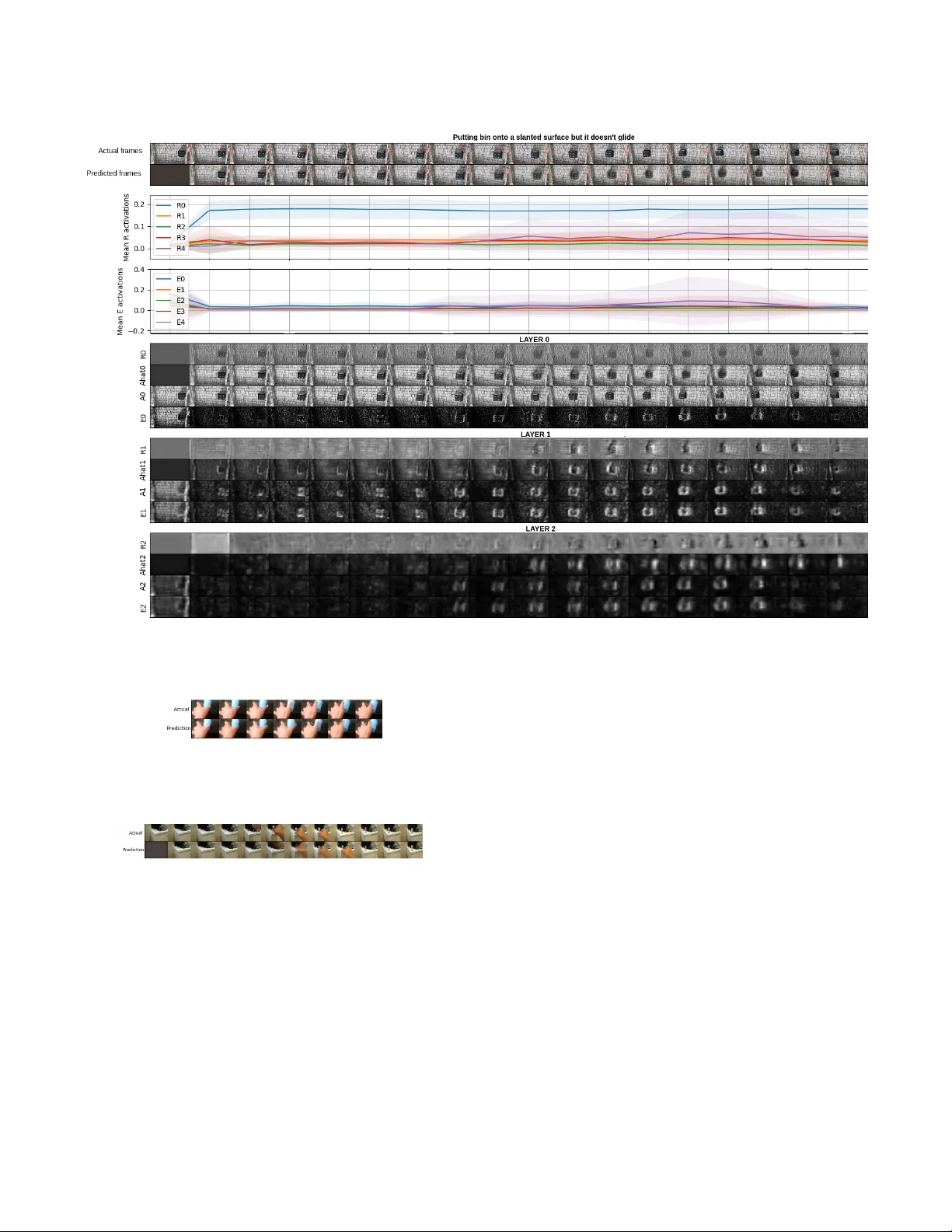

예측 실험에서는 10가지 하이퍼파라미터 조합(계층 수, 채널 수, 입력 해상도, FPS)을 변형해 모델을 학습시켰다. 평가 지표는 움직임이 있는 프레임에 한정한 PSNR·SSIM, 그리고 ‘conditioned SSIM’(예측이 단순 마지막 프레임 복제보다 얼마나 위험한지를 측정)이다. 시각화 결과는 PredNet이 움직임이 명확히 존재하고 연속적인 경우에는 물체를 일정 방향으로 보간해 예측하지만, 움직임이 불연속적이거나 다중 가능한 경우에는 블러링된 평균 예측을 만든다는 점을 보여준다. 특히 FPS가 높을수록 프레임 간 차이가 작아 모델이 거의 변화를 감지하지 못하고, FPS가 낮을수록 급격한 움직임으로 인해 오류가 급증해 결국 마지막 프레임 복제 전략으로 전락한다.

예측 코딩 관점에서 두 가지 중요한 불일치를 발견했다. 첫째, 계층이 올라갈수록 평균 오류(E)의 크기가 증가했으며, 이는 전통적인 예측 코딩이 기대하는 ‘오류 감소’를 반박한다. 둘째, L₀ 손실(오직 최하위 계층 오류만 최소화)으로 학습한 모델이 L_all 손실(모든 계층 오류 최소화)보다 일관되게 높은 성능을 보였다. 예측 코딩 이론에 따르면 모든 계층이 자체 오류를 최소화해야 하므로, 현재 PredNet 구현이 이론적 요구사항을 충족하지 못함을 의미한다.

다음으로 PredNet+ 실험을 진행했다. 합성 데이터(단순 회전 얼굴)에서는 행동 라벨을 상위 계층에 주입함으로써 예측 오류가 크게 감소하고, PSNR·SSIM이 현저히 개선되었다. 그러나 실제 Something‑Something 데이터에서는 라벨 조건화가 오히려 성능 향상에 기여하지 못했고, 일부 설정에서는 과적합 현상이 나타났다. 이는 복잡하고 잡음이 많은 실제 영상에서 라벨 정보가 충분히 정교한 상위 예측을 유도하기엔 현재 구조가 제한적임을 보여준다.

결론적으로, PredNet은 예측 코딩의 형태적 영감을 받았지만, 오류 전파 역학, 다중 모드 미래 예측, 그리고 고차원 의미 정보의 통합 측면에서 아직 미흡하다. 논문은 이러한 한계를 명확히 제시하고, 향후 연구 방향으로는 (1) 계층별 오류 감소 메커니즘을 재설계하고, (2) 확률적 생성 모델(VAE, 흐름 기반 네트워크)과 결합해 다중 모드 예측을 구현하며, (3) 보다 풍부한 상위‑하위 피드백 루프를 설계해 행동 라벨과 같은 의미 정보를 효과적으로 전달하는 방안을 제시한다. 이러한 개선이 이루어질 경우, PredNet과 유사한 구조가 자기지도 학습에서 강력한 특징 추출기 및 장기 예측 모델로 자리매김할 가능성이 높다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기