시뮬레이션과 데이터의 협력: 새로운 입자 탐지를 위한 혁신적 접근법

초록

LHC에서 새로운 입자 발견 증거가 부족한 가운데, 모델 독립적 검색의 중요성이 커지고 있습니다. 본 논문은 시뮬레이션에 크게 의존하는 방법과 순수 데이터 기반 방법의 장점을 결합한 하이브리드 방법인 SALAD(Simulation Assisted Likelihood-free Anomaly Detection)를 제안합니다. 이 방법은 하나의 알려진 특징(예: 불변 질량)에서 공명하는 신호를 대상으로, 사이드밴드 데이터에 맞춰 시뮬레이션을 재가중하는 함수를 학습한 후, 이를 신호 영역으로 보간하여 적용합니다. 재가중된 시뮬레이션은 지도 학습을 통한 신호 향상과 배경 추정에 모두 사용될 수 있으며, 디제트 검색 사례를 통해 그 유효성을 입증합니다.

상세 분석

본 논문이 제안하는 SALAD 방법의 기술적 핵심은 “모델 의존성을 최소화하면서 시뮬레이션의 정보를 최대한 활용"하는 것에 있습니다. 기존 모델 독립적 검색은 시뮬레이션에 전적으로 의존해 배경 모델의 부정확성이 검색 감도와 특이성 모두에 치명적이거나, 완전한 데이터 기반 방식으로는 배경 추정 자체가 추가적인 제약(예: 분류 특징과 공명 특징 간의 상관관계 제거)을 요구하는 딜레마가 있었습니다.

SALAD는 이러한 문제를 DCTR(Deep neural networks using Classification for Tuning and Reweighting) 기법을 활용해 우아하게 해결합니다. 구체적인 절차는 다음과 같습니다. 먼저, 신호가 존재하지 않는 것으로 예상되는 영역(사이드밴드)에서 ‘데이터’(실험 데이터)와 ‘시뮬레이션’(배경 전용)을 구분하는 분류기 f(x, m)을 학습합니다. 여기서 m은 신호가 국소화되는 공명 특징(예: 디제트 불변 질량)이고, x는 다른 분류 특징(예: 제트 질량, N-subjettiness)입니다. 이진 교차 엔트로피 손실 함수를 사용해 학습된 신경망은 점근적으로 우도 비(likelihood ratio)를 학습하게 되며, 이는 시뮬레이션을 데이터에 맞게 재가중하는 가중치 함수 w(x|m)로 사용됩니다.

핵심 혁신은 이 가중치 함수의 “보간(interpolation)” 능력에 있습니다. 신경망은 특징 m에 대해 매개변수화되어 학습되므로, 학습에 사용되지 않은 신호 영역의 m 값에 대해서도 가중치 w(x|m)를 자연스럽게 추정(보간)할 수 있습니다. 이를 통해 신호 영역에서도 재가중된 시뮬레이션을 생성할 수 있게 됩니다. 이 재가중된 시뮬레이션은 두 가지 목적으로 사용됩니다. 첫째, 데이터와 재가중된 시뮬레이션을 구분하는 두 번째 분류기 g(x)를 학습시켜 최적의 신호 대 배경 분류기를 근사합니다. 둘째, 동일한 재가중된 시뮬레이션을 통해 Eq. (2.4)와 같이 분류기 출력값에 대한 임계값을 넘는 배경 사건수를 직접 추정할 수 있습니다. 이는 g(x)와 m 사이의 비자명한 상관관계를 허용한다는 점에서 기존의 ABCD 방법 등과 차별화됩니다.

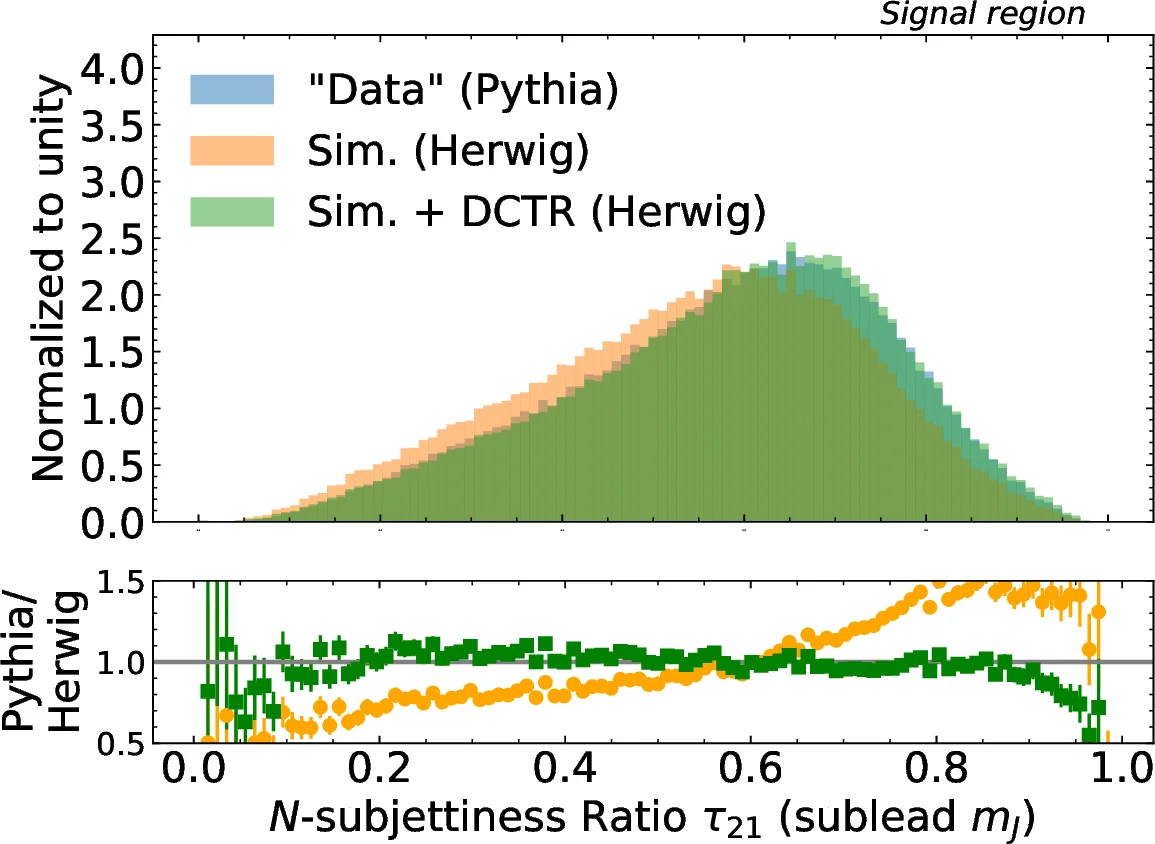

논문의 실험에서는 Pythia 생성 데이터를 ‘데이터’, Herwig 생성 데이터를 ‘시뮬레이션’으로 가정하여 방법을 검증합니다. 사이드밴드에서 학습된 DCTR 모델이 두 생성기의 차이를 매우 잘 보정하며(Fig. 4, 5), 이 보정 함수가 신호 영역으로 보간되어도 마찬가지로 우수한 폐쇄성(closure)을 보이는 것(Fig. 6, 7)이 확인됩니다. 이는 방법의 견고성을 시사합니다. 또한, SALAD 방식으로 훈련된 분류기의 성능은 이상적인 지도 학습 분류기의 성능에 근접하며(Fig. 3 참조), 배경 추정 정확도 또한 높을 것으로 기대됩니다. 이 접근법의 가장 큰 강점은 시뮬레이션의 체계적인 오차를 데이터 기반으로 보정하면서도, 시뮬레이션이 제공하는 풍부한 물리 정보(매트릭스 요소, 파손 효과 등)와 고차원 특징 공간 탐색 능력을 잃지 않는다는 점입니다.

댓글 및 학술 토론

Loading comments...

의견 남기기