실제 보이스를 속이는 가짜 보브 공격

본 논문은 실용적인 블랙박스 환경에서 화자 인식 시스템을 목표로 하는 적대적 공격 기법 FAKEBOB을 제안한다. 최적화 기반으로 신뢰도와 L∞ 제한 왜곡을 동시에 고려하고, 스코어 임계값을 추정하는 새로운 알고리즘을 도입한다. 실험 결과, 오픈소스와 상용 시스템 모두에서 99% 이상의 목표 공격 성공률을 달성했으며, 공기 중 재생(over‑the‑air) 공격과 인간 청취자 감별 실험에서도 높은 효율성을 보였다. 기존 음성 인식 방어 기법 4…

저자: Guangke Chen, Sen Chen, Lingling Fan

본 논문은 화자 인식 시스템(SRS)이 일상 생활에서 인증·식별 메커니즘으로 널리 사용됨에 따라, 악의적인 적대적 공격에 취약할 수 있음을 지적한다. 기존 연구들은 대부분 화자 인식이 아닌 음성 인식에 초점을 맞추었으며, 화자 인식에 특화된 공격은 백색 상자(white‑box) 환경에 국한돼 있었다. 따라서 실제 서비스에서 가장 흔히 마주치는 블랙박스(black‑box) 상황—시스템 내부 구조와 파라미터를 알 수 없고, 오직 입력에 대한 스코어와 결정 결과만 얻을 수 있는 경우—에 대한 체계적인 분석이 필요했다.

이를 위해 저자들은 FAKEBOB(Fake Bob)이라는 새로운 적대적 공격 프레임워크를 설계했다. 핵심 아이디어는 적대적 샘플을 “최소 왜곡 + 높은 신뢰도”라는 두 목표를 동시에 만족하도록 최적화 문제로 정의하는 것이다. 구체적으로, 입력 음성 x에 작은 잡음 δ를 더해 x′=x+δ를 만들고, L∞ 노름으로 δ의 최대 진폭을 제한한다. 동시에, 목표 스피커 i에 대한 스코어 S_i(x′)가 사전에 정의된 임계값 θ 이상이면서, 목표 신뢰도 γ를 만족하도록 하는 것이 목표 함수에 포함된다.

블랙박스 환경에서 그래디언트를 직접 계산할 수 없기 때문에, 저자들은 자연 진화 전략(NES)을 이용해 그래디언트를 추정한다. 그러나 SRS는 스코어가 임계값 θ 미만이면 바로 거부(reject)하기 때문에, 단순히 스코어를 높이는 것만으로는 충분하지 않다. 이를 해결하기 위해 논문은 “임계값 추정 알고리즘”을 제안한다. 다수의 쿼리를 통해 스코어가 변하는 패턴을 관찰하고, 이진 탐색 방식으로 θ를 근사한다. 이렇게 얻은 θ와 NES‑추정 그래디언트를 기반으로 기본 반복 방법(BIM)을 적용해 δ를 점진적으로 업데이트한다.

실험은 크게 두 파트로 나뉜다. 첫 번째는 API 기반 공격으로, 3가지 오픈소스 모델(i‑vector‑PLDA, GMM‑UBM, x‑vector‑PLDA)과 2개의 상용 서비스(Talentedsoft, Microsoft Azure)를 대상으로 했다. 40가지 시나리오(목표/비목표, 성별, 과제 종류 등) 중 16가지를 선택해 평가했으며, 평균 2,500번 이하의 쿼리로 99% 이상의 목표 성공률을 달성했다. 특히 Talentedsoft에서는 100% 성공률을 기록했다.

두 번째는 물리적 환경에서의 over‑the‑air 공격이다. 실험실 내에서 스피커를 통해 재생된 적대적 음성을 마이크가 수집하도록 하였고, 동일한 모델에 대해 API와 동일한 성공률을 보였다. 인간 청취자 실험을 위해 Amazon Mechanical Turk에 200개의 원본·적대적 음성을 제시했으며, 참가자들의 70% 이상이 두 음성을 구분하지 못했다. 이는 FAKEBOB이 인간 인지 수준에서도 거의 무시할 수 없는 수준의 은폐성을 갖는다는 것을 의미한다.

전이성(transferability) 측면에서도 FAKEBOB은 강력했다. 동일 아키텍처가 아닌 모델 간, 다른 훈련 데이터셋을 사용한 모델 간, 그리고 상용 Azure 서비스에 대한 전이 공격에서도 34%~68%의 성공률을 보였다. 이는 목표 신뢰도 γ를 높게 설정하면 왜곡이 증가하지만 전이 성공률이 상승한다는 트레이드오프를 보여준다.

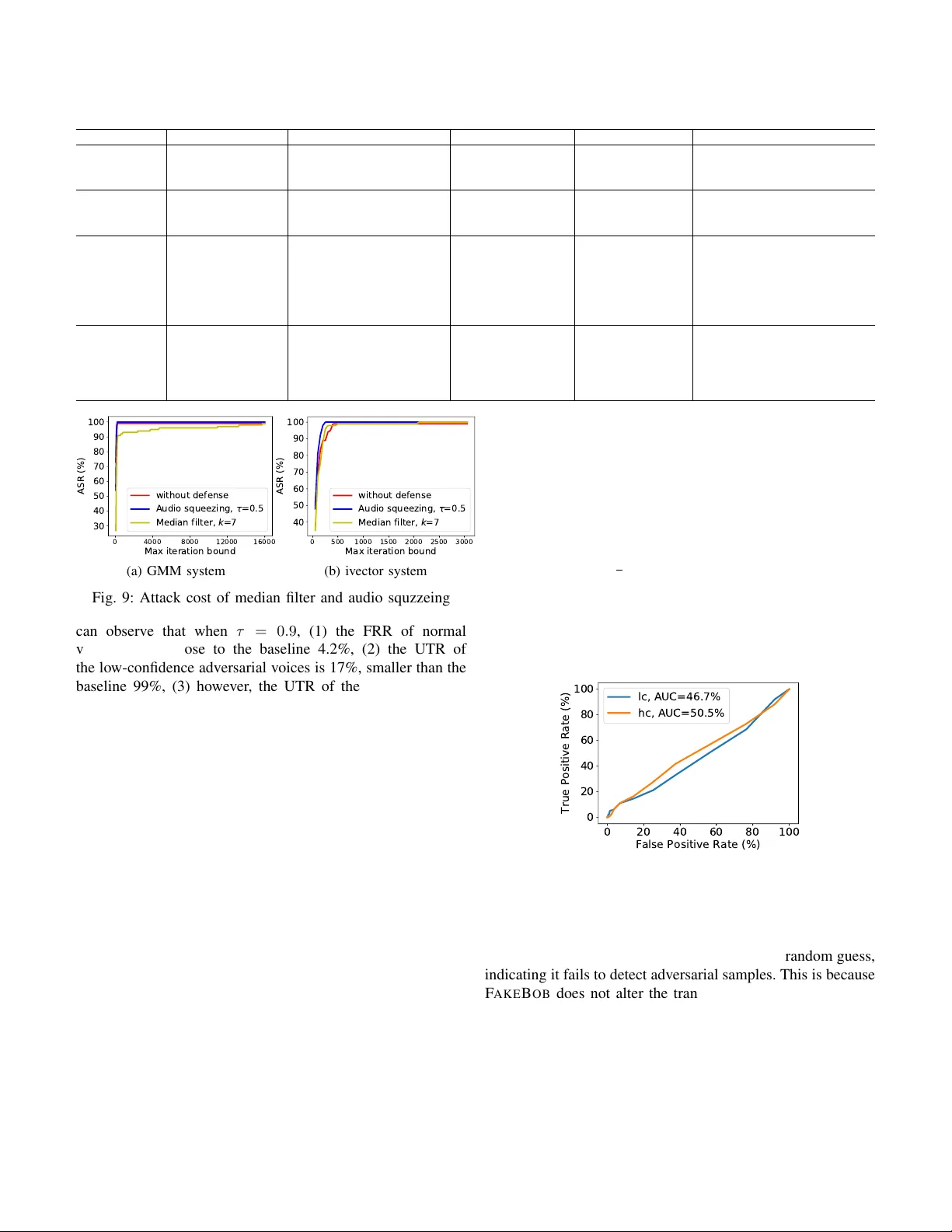

마지막으로, 기존 음성 인식 분야에서 제안된 방어 기법 4가지(오디오 스퀴징, 로컬 스무딩, 양자화, 시간 의존성 기반 탐지)를 적용했을 때, FAKEBOB의 성공률은 크게 감소하지 않았다. 이는 화자 인식 시스템이 스코어 임계값이라는 고유 메커니즘을 사용하기 때문에, 기존 방어가 구조적으로 무력화된다는 점을 시사한다.

결론적으로, FAKEBOB은 블랙박스 화자 인식 시스템에 대한 최초의 포괄적, 실용적 적대적 공격을 제시한다. 높은 성공률, 물리적 환경에서의 실현 가능성, 인간 인지에 대한 은폐성, 그리고 기존 방어 기법에 대한 무력화는 현재 상용 SRS가 직면한 심각한 보안 취약점을 명확히 드러낸다. 향후 연구는 화자 인식 전용 방어 메커니즘(예: 임계값 기반 탐지, 강인한 특징 추출, 다중 모달 인증) 개발과, 공격자와 방어자 간의 ‘무기 경쟁’ 구도를 지속적으로 탐구해야 할 필요성을 강조한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기