깊게 희소한 신호 표현

** 본 논문은 ReLU 비선형성을 갖는 심층 신경망을 연속적인 희소 코딩 모델의 연쇄로 해석하고, 각 층의 변환 행렬이 RIP을 만족하고 열이 희소할 경우 샘플 복잡도와 학습 알고리즘을 이론적으로 분석한다. 전방 및 후방 순차 학습 알고리즘을 제시하고, 샘플 복잡도 상한과 하한을 도출함으로써 깊은 네트워크가 얕은 네트워크보다 더 많은 데이터가 필요함을 설명한다. **

저자: Demba Ba

**

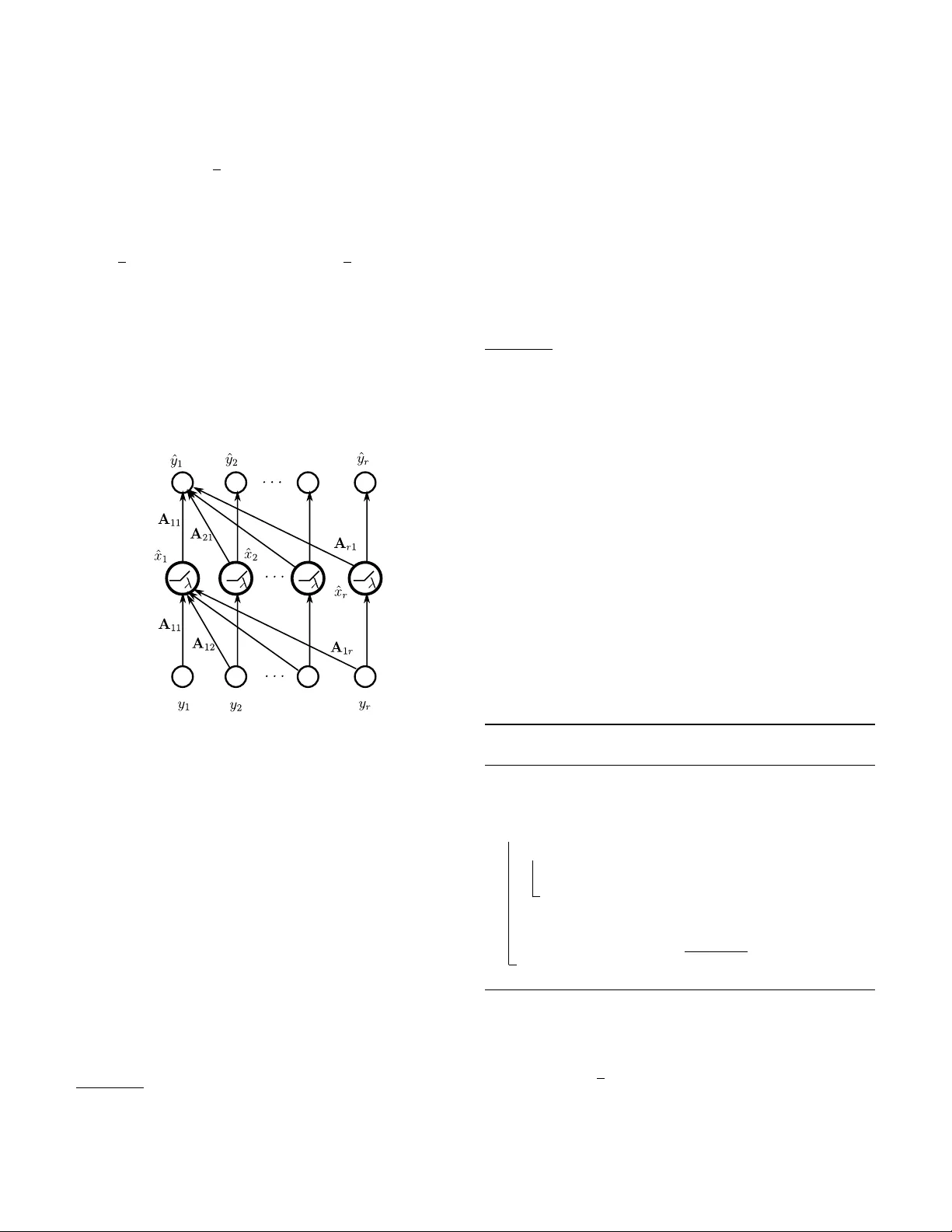

본 논문은 ReLU 비선형성을 갖는 심층 신경망을 연속적인 희소 코딩 모델의 연쇄(cascade)로 해석하고, 이러한 모델에서 각 층의 변환 행렬을 학습하기 위한 두 가지 순차 알고리즘을 제안한다.

1. **배경 및 동기**

- 최근 연구들은 딥 컨볼루션 신경망이 다층 희소 코딩(ML‑CSC) 모델과 동등함을 보였으며, 특히 ReLU가 \(\ell_1\) 정규화와 비음수 제약을 결합한 최적화 문제의 해임을 이용해 해석될 수 있음을 제시했다.

- 그러나 기존 작업은 **학습 단계**에 대한 이론적 보장을 제공하지 못했고, 특히 **샘플 복잡도**에 대한 정량적 분석이 부족했다.

2. **딥 사전학습 모델 정의**

- 입력 신호 \(x^{(L)}\)는 \(L\)개의 선형 변환 \(W^{(\ell)}\)와 ReLU 비선형성의 교대로 생성된다:

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기