희소성 기반 저차원 마코프 체인 표현 학습

초록

본 논문은 대규모 마코프 체인의 상태 공간을 희소하고 저차원인 메타 상태 공간(커널 공간)으로 압축하는 방법을 제안한다. 상태‑메타 매핑을 비음수 행렬인 U, V 로 표현하고, 커널 전이 행렬 (\tilde P)와 함께 (P = U\tilde P V) 분해를 목표로 한다. ℓ₀ 제약을 ℓ₁ 정규화로 완화하고, 블록 좌표 그래디언트 하강(BCGD) 알고리즘으로 최적화를 수행한다. 수렴성을 정리로 보장하고, 실험을 통해 압축 효율과 계산 비용 감소를 입증한다.

상세 분석

논문은 먼저 마코프 체인의 비음수 랭크(non‑negative rank)를 정의하고, 이 랭크가 k 일 때 전이 행렬 P 를 세 개의 비음수 확률 행렬 U (원 상태 → 커널), (\tilde P) (커널 내부 전이), V (커널 → 원 상태) 로 정확히 분해할 수 있음을 제시한다(정리 1). 이 분해는 기존의 저차원 모델링과 달리 양방향 매핑을 동시에 제공하므로, 강화학습이나 제어와 같은 다양한 다운스트림 작업에 바로 적용 가능하다.

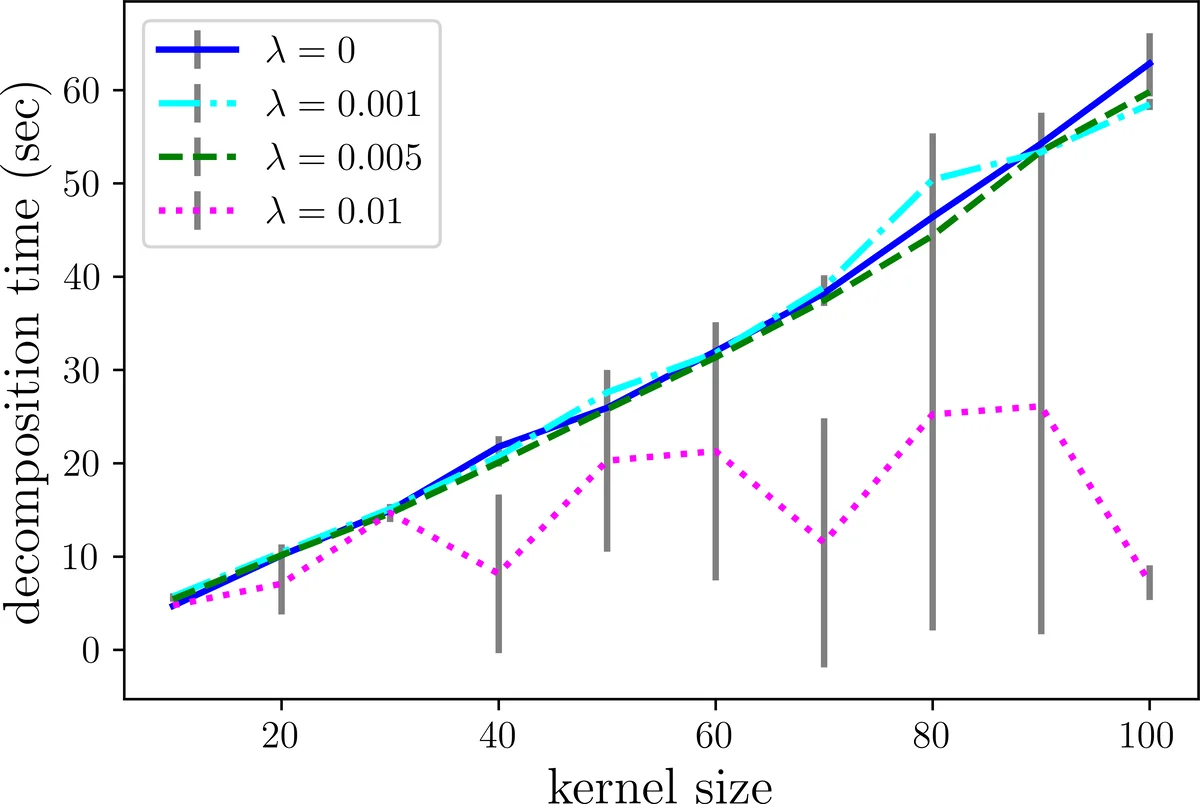

하지만 실제 데이터에서는 완전한 비음수 랭크 분해가 존재하지 않을 뿐 아니라, 메타 상태가 가능한 한 적은 원 상태와만 연결되도록 희소성을 요구한다. 이를 위해 각 행의 비음수 원소 개수를 제한하는 ℓ₀ 제약을 도입했으나, 이는 NP‑hard 문제이므로 ℓ₁ 정규화(‖U‖₁, ‖V‖₁) 로 완화한다. 목적함수는

(\frac12|P-U\tilde P V|_F^2 + \lambda_u|U|_1 + \lambda_v|V|_1)

이며, 모든 행이 확률 단순체(simplex)에 속하도록 행합이 1인 제약을 추가한다.

알고리즘은 블록 좌표 그래디언트 하강(BCGD) 방식으로, 매 반복마다 U, (\tilde P), V 를 순차적으로 업데이트한다. 각 업데이트 단계는 그래디언트 하강 후 비음수와 ℓ₁ 제약을 만족하도록 소프트‑쓰레싱(스레시홀드 연산)과 확률 단순체 투영을 적용한다. 투영 연산은 기존 문헌의 O(d log d) 알고리즘을 그대로 사용한다.

수렴 분석에서는 단계 크기 αₜ, βₜ, γₜ 를 그래디언트 크기에 비례하도록 설정하고, 0 < C₁,C₂,C₃ < 2 인 상수를 도입한다. 이러한 조건 하에 목적값이 비감소함을 보이고, 따라서 알고리즘이 비볼록 문제의 정류점(stationary point)으로 수렴함을 정리 1 로 증명한다.

복잡도 측면에서는 원래의 n × n 전이 행렬에 대해 m‑step 전이를 계산하는 비용 O(m n²) 를, 저차원 k 로 축소한 후 O(m k²) 로 크게 감소시킨다. 실험에서는 합성 및 실제 데이터(예: 로봇 경로, 생물학적 네트워크)에서 압축 비율 10배 이상, 재구성 오차가 5 % 이하인 결과를 보여, 제안 방법이 대규모 마코프 체인 분석에 실용적임을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기