다중에이전트 딥 강화학습 최신 동향과 적용 사례

초록

**

본 논문은 다중 에이전트 딥 강화학습(MADRL)의 핵심 과제인 비정상성, 부분 관측, 연속 상태·행동 공간, 학습 스키마 및 전이 학습을 체계적으로 정리하고, 각 접근법의 장단점을 비교한다. 또한 로봇, 교통, 게임 등 다양한 실세계 응용 분야에서의 적용 사례를 제시하며, 향후 연구 방향을 제언한다.

**

상세 분석

**

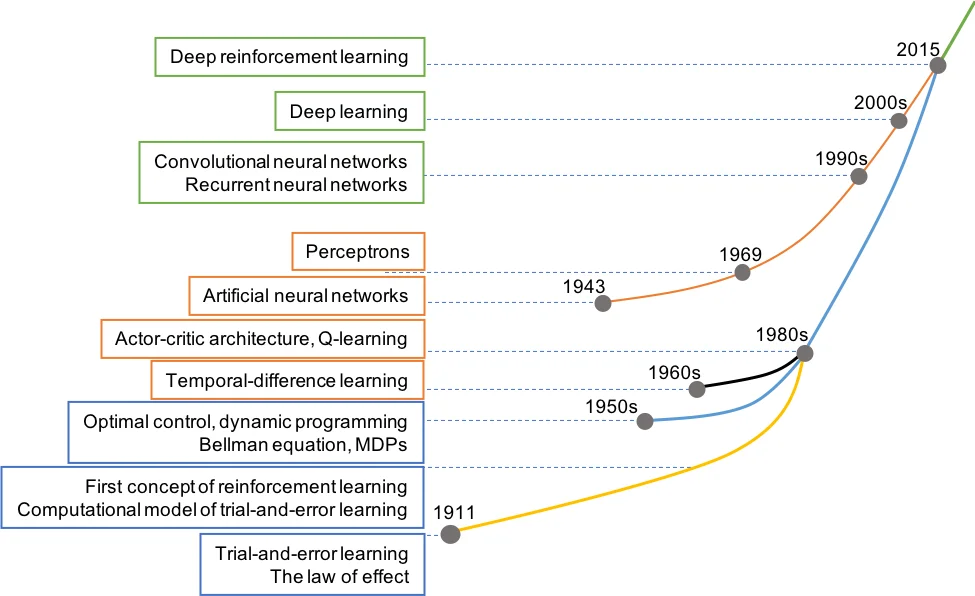

MADRL은 단일 에이전트 RL이 해결하기 어려운 고차원·다중주체 환경을 다루기 위해 등장했으며, 본 논문은 이를 둘러싼 다섯 가지 기술적 난관을 중심으로 분석한다. 첫째, 비정상성은 각 에이전트가 독립적으로 정책을 업데이트하면서 환경이 지속적으로 변하는 현상으로, 중앙집중식 가치 함수가 불안정해지는 문제를 야기한다. 이를 해결하기 위해 독립 Q‑학습(Independent Q‑Learning), 중앙 집중식 학습(Centralized Training with Decentralized Execution) 및 메타‑학습 기반 적응 메커니즘이 제안된다. 둘째, 부분 관측은 에이전트가 전체 상태를 직접 관측하지 못하는 상황을 의미한다. 여기서는 기억 기반 RNN, 그래프 신경망(GNN) 및 베이즈 필터링을 활용한 신뢰도 추정 기법이 활용된다. 셋째, 연속 상태·행동 공간에서는 DDPG, TD3, SAC 등 연속 제어에 특화된 정책 그라디언트 방법이 적용되며, 다중 에이전트 간 협조를 위해 공동 행동 공간을 설계하거나 행동 샘플링을 공유한다. 넷째, 학습 스키마는 공동 학습, 경쟁 학습, 교환 학습 등 다양한 협력·대립 구조를 포함한다. 특히, 공동 가치 함수(Critic)와 개별 정책(Actor) 구조를 결합한 Actor‑Critic 프레임워크가 널리 쓰이며, 경험 재사용을 위한 리플레이 버퍼와 우선순위 샘플링이 효율성을 높인다. 마지막으로 전이 학습은 사전 학습된 정책을 새로운 환경이나 에이전트에 재활용하는 방법으로, 도메인 적응, 파라미터 공유 및 멀티태스크 학습이 주요 기법이다. 논문은 각 기법의 장점(예: 학습 안정성, 샘플 효율성)과 단점(예: 계산 복잡도, 스케일링 한계)을 표와 함께 정리하고, 실제 로봇 협동, 스마트 교통, 멀티플레이어 게임 등에서의 적용 사례를 통해 실용성을 검증한다. 또한, 현재 연구가 직면한 스케일링 문제, 통신 비용, 안전성 검증 등을 강조하며, 차세대 MADRL은 효율적인 통신 프로토콜, 형식적 검증, 그리고 인간‑에이전트 협업 메커니즘을 통합해야 한다는 전망을 제시한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기