음식 이미지와 레시피를 잇는 적대적 교차모달 임베딩

초록

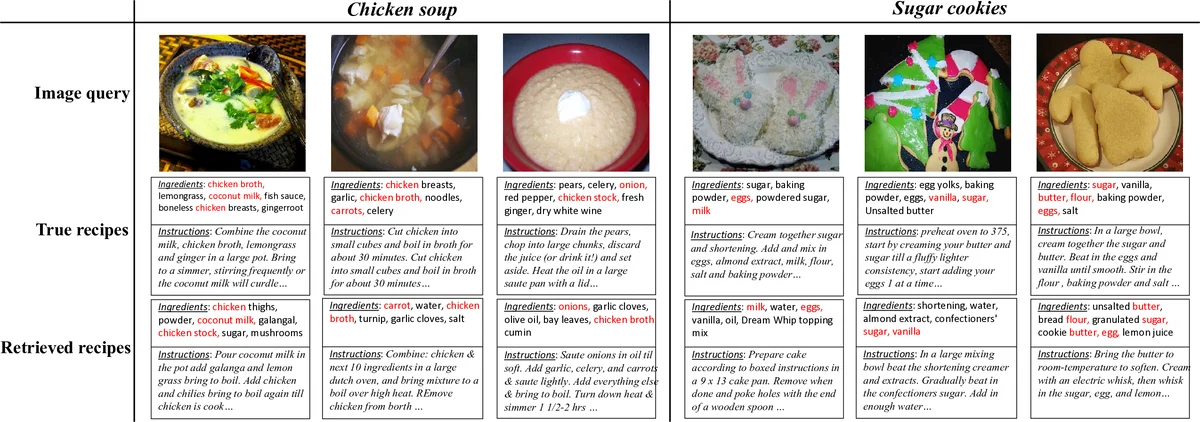

본 논문은 요리 레시피와 음식 이미지 사이의 교차모달 검색을 위해, 새로운 트리플렛 손실과 하드 샘플 마이닝, 적대적 분포 정렬, 그리고 교차모달 번역 일관성(레시피→이미지, 이미지→재료 예측)을 결합한 ACME(Adversarial Cross‑Modal Embedding) 프레임워크를 제안한다. Recipe1M 데이터셋에서 기존 최첨단 방법들을 크게 능가하는 성능을 기록하였다.

상세 분석

ACME는 세 가지 핵심 모듈로 구성된다. 첫째, 기존 트리플렛 손실에 하드 샘플 마이닝을 도입해, 앵커와 가장 먼 양성 샘플·가장 가까운 음성 샘플을 선택함으로써 학습 효율과 수렴 속도를 크게 향상시킨다. 이는 레시피당 다수의 이미지가 존재하는 상황에서 이미지 간 변동성을 효과적으로 반영한다. 둘째, 이미지와 레시피의 피처 분포 차이를 줄이기 위해 WGAN‑GP 기반의 적대적 정렬 손실(L_MA)을 적용한다. 이미지 인코더(E_V)와 레시피 인코더(E_R)의 중간 피처(V_m, R_m)를 판별기(D_M)가 구분하지 못하도록 학습함으로써, 두 모달리티가 동일한 잠재 공간에 매핑된다. 셋째, 교차모달 번역 일관성(L_Trans)을 도입한다. 레시피 임베딩(R)을 이용해 GAN‑형식의 이미지 생성기(recipe2image)를 학습하고, 이미지 임베딩(V)으로부터 재료 라벨을 예측하는 이미지2레시피(i2r) 분류기를 동시에 훈련한다. 이 두 서브태스크는 각각 적대적 손실과 다중 라벨 분류 손실을 사용해, 임베딩이 상대 모달리티의 의미 정보를 보존하도록 강제한다. 전체 손실은 L = L_Ret + λ₁L_MA + λ₂L_Trans 형태로 결합되며, λ₁, λ₂는 경험적으로 설정한다.

구조적으로는 CNN 기반 이미지 인코더와 LSTM 기반 레시피 인코더 뒤에 가중치를 공유하는 완전 연결 층(F_C)을 두어, 최종 임베딩(V, R)이 동일 차원(d)으로 정렬된다. 이 설계는 파라미터 효율성을 높이고, 두 모달리티 간의 직접적인 비교를 가능하게 한다.

실험에서는 대규모 Recipe1M 데이터셋을 사용해 이미지→레시피, 레시피→이미지 두 방향의 Recall@1, @5, @10을 측정했으며, 기존 JE, AdaMine, ACME‑Hierarchical 등과 비교해 평균 35%p 이상의 개선을 보였다. 특히 하드 샘플 마이닝 없이 단순 트리플렛을 사용할 경우 성능 격차가 크게 나타나, 제안된 샘플링 전략의 중요성을 입증한다.3%p 감소한다.

Ablation study에서는 (1) 적대적 정렬 제거, (2) 번역 일관성 제거, (3) 하드 마이닝 비활성화 각각이 성능 저하를 초래함을 확인했다. 특히 정렬 손실을 제외하면 분포 차이로 인한 불일치가 커져 Recall이 2

강점으로는 (i) 다양한 모달리티 간 분포 정렬을 명시적으로 다루어 일반화 능력이 높다, (ii) 번역 일관성을 통해 임베딩이 의미적 풍부함을 유지한다, (iii) 하드 마이닝 기반 트리플렛이 대규모 데이터에서 효율적인 학습을 가능하게 한다. 한계점은 (i) 이미지 생성기가 아직 저해상도 수준에 머물러, 시각적 품질 평가가 제한적이다, (ii) 레시피 텍스트를 LSTM으로 단순 인코딩해 문맥적 nuance를 완전히 포착하지 못한다는 점이다. 향후에는 Transformer 기반 텍스트 인코더와 고해상도 이미지 생성 모델을 결합해 성능을 더욱 끌어올릴 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기